BYOA(Bring Your Own Agent)正在成為 2026 年企業 IT 治理的新課題。 根據 Gartner 對資安主管的調查,69% 的企業已掌握或懷疑員工在使用未經核准的公開 GenAI 工具;McKinsey 2026 年組織現況報告指出,88% 的企業正在部署 AI,但只有 25% 的領導者預期短期內會讓 AI Agent 以自主角色加入團隊。這個落差背後藏著一個很現實的問題:多數 CIO 和 CTO 根本不知道自家組織裡跑了多少 AI agent,也不清楚這些 agent 在做什麼。

這篇文章會拆解 BYOA 的概念、Shadow Agent 帶來的具體風險、為什麼 AI agent 已經是你的「數位勞動力」的一部分,以及 CIO 和 CTO 現在就能採取的治理框架。

Shadow Agent:比 Shadow IT 更難追蹤的風險

2010 年代的 Shadow IT 教訓還記得吧?員工偷偷用 Dropbox、Slack,IT 部門後知後覺。現在同樣的劇本在 AI 領域重演,但風險更大。

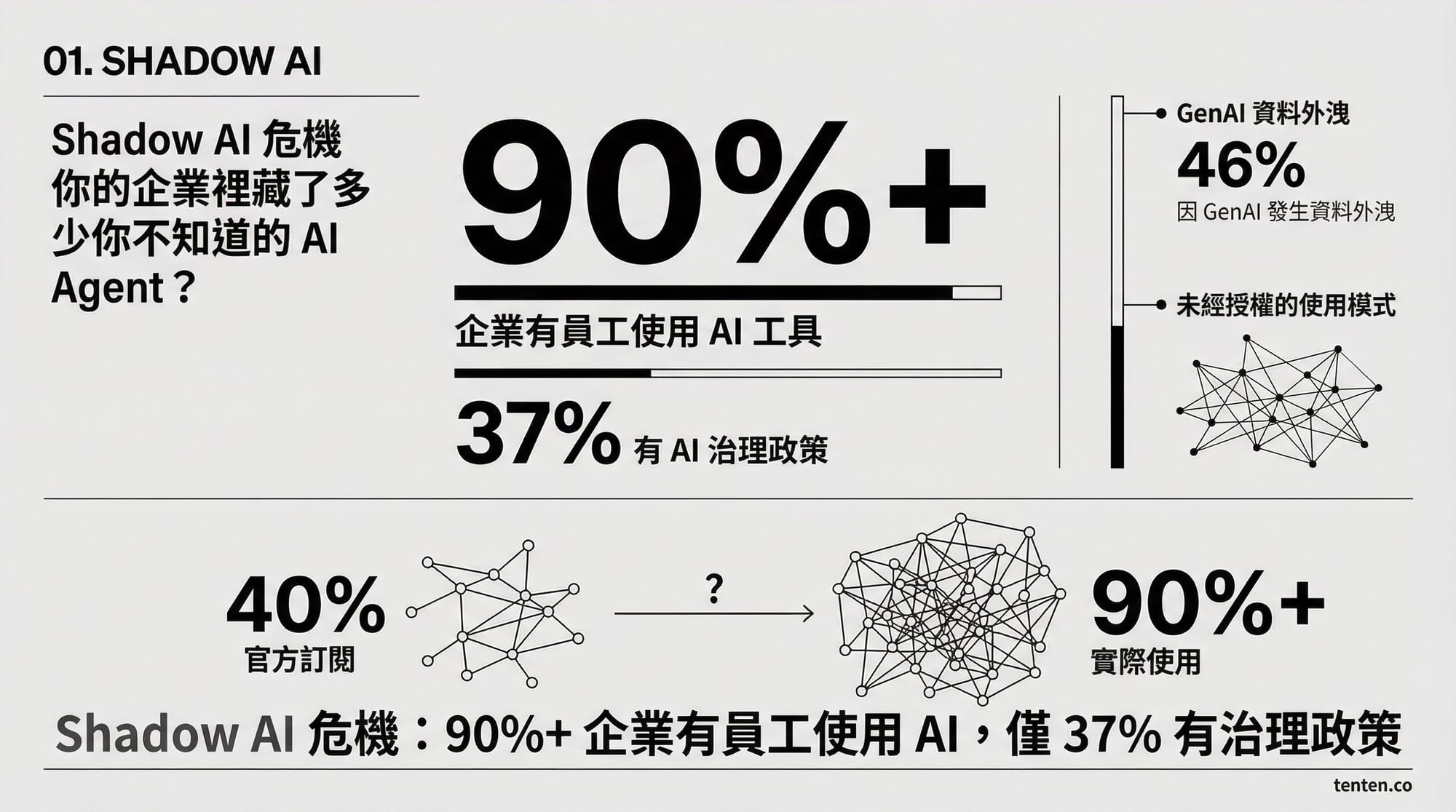

根據 Harmonic Security 分析 2,245 萬筆企業 GenAI prompt 的研究,只有 40% 的企業購買了正式的 AI 訂閱,但超過 90% 的企業裡有員工在使用 AI 工具,多數透過個人帳號登入,IT 部門完全看不見。Cisco 的 2025 年調查也發現,46% 的企業因為員工使用 GenAI 而發生內部資料外洩。

Shadow Agent 跟傳統 Shadow IT 有個根本差異:過去員工用未授權的 Dropbox,頂多是把公司檔案存到外部——風險有邊界。AI agent 則是主動把敏感資料送進第三方模型,而且 agent 會自主行動、24 小時不間斷運行,甚至能寄信、修改記錄、觸發工作流程。員工在 ChatGPT 裡貼了一份合約要求「找出對我們不利的條款」,那個 prompt 本身就是一份商業情報。

各部門自行建 GPT、部署 Copilot、跑工作流程 bot 的情況越來越普遍。這些 agent 可能在局部產生價值,但 IT 領導層對它們的存在一無所知。結果是能力重疊、安全盲區、治理真空。

數字會說話:Shadow AI 的規模

| 指標 | 數據 | 來源 |

|---|---|---|

| 企業中有員工使用 AI 工具的比例 | 超過 90% | Harmonic Security, 2025 |

| 企業實際購買 AI 訂閱的比例 | 40% | Harmonic Security, 2025 |

| 員工透過個人帳號使用 GenAI 的比例 | 47% | Netskope, 2026 |

| 企業因 GenAI 發生資料外洩的比例 | 46% | Cisco, 2025 |

| 有 AI 治理政策的企業比例 | 37% | IBM, 2025 |

| 員工在禁令後仍繼續使用個人 AI 帳號的比例 | 接近 50% | Healthcare Brew, 2026 |

| 提供企業級 AI 替代方案後,未授權使用下降幅度 | 89% | Healthcare Brew, 2026 |

一組數據特別值得注意:只有 37% 的企業有 AI 治理政策,等於 63% 的企業在零規範下運作。同時,研究一再顯示,禁令幾乎無效——將近一半的員工就算公司明令禁止,還是會繼續用個人 AI 帳號。

AI Agent 已經是你的勞動力——只是沒人在管

AI agent 早就不是工具了。它們是數位工作者——有些負責輔助,有些自主行動——參與工作流程、產出內容、影響決策。

McKinsey 在 2025 年 9 月發表的〈The Agentic Organization〉報告裡提出一組讓人停下來想的數字:89% 的組織仍然停在工業時代的運作模式,9% 採用敏捷或產品平台模式,只有 1% 以去中心化網路方式運作。但 AI agent 的發展速度不等人,Gartner 預測到 2026 年底,40% 的企業應用程式將內建任務型 AI agent——2025 年這個數字還不到 5%。

Databricks 的 2026 年 AI Agent 報告也印證了這個趨勢:企業正從單一聊天機器人轉向多 agent 系統,後者在不到四個月內成長了 327%。使用 AI 治理工具的企業,將 AI 專案推入正式上線的數量是沒有治理的 12 倍以上。

把這些數據拼在一起,結論很直接:AI agent 已經是勞動力的一部分,CIO 和 CTO 必須用管理員工和外包商一樣的方式來管理它們——盤點能力、理解角色、有計畫地部署。

BYOA 治理框架:四個必做的維度

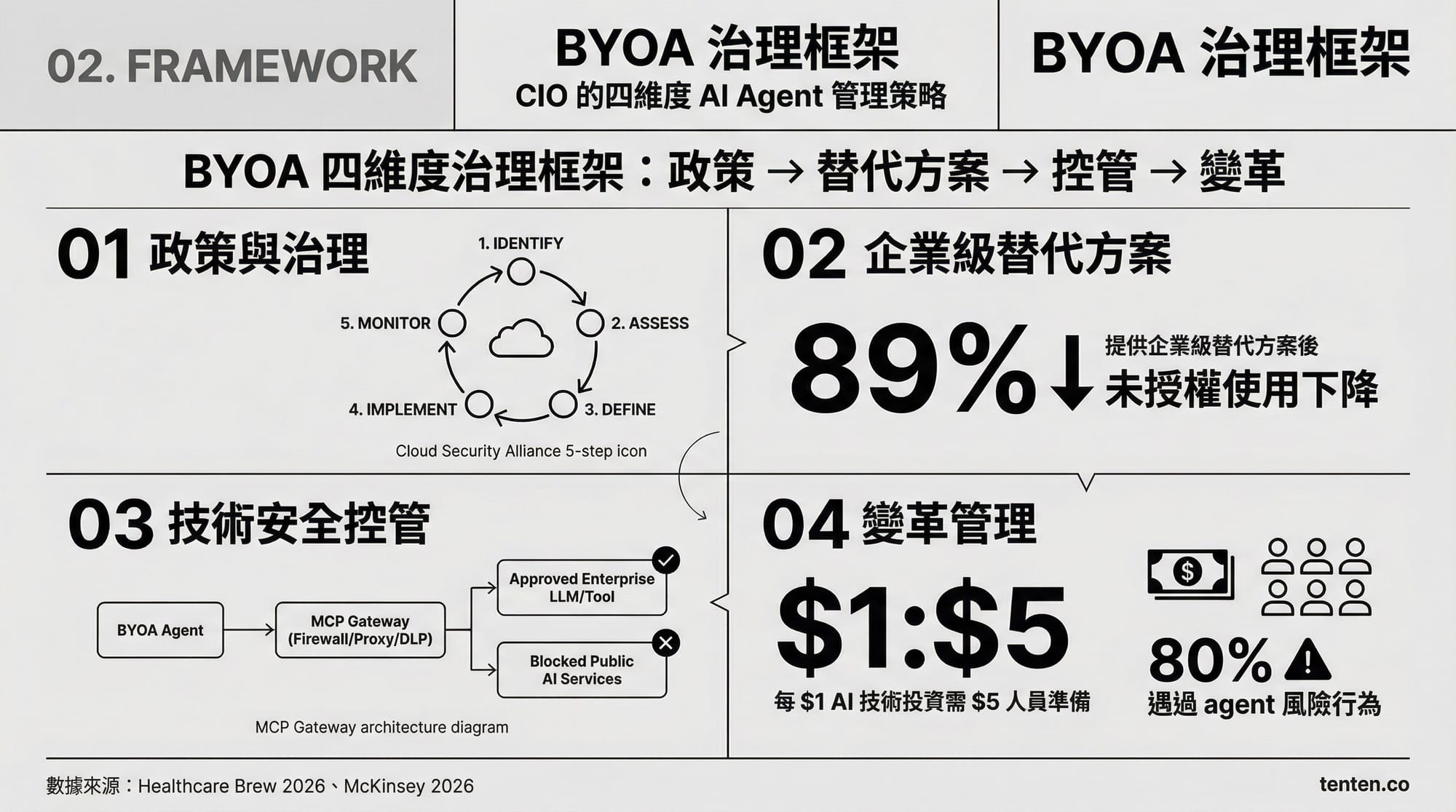

既然禁令不管用,CIO 需要的是一套主動的治理框架。綜合 McKinsey 2026 AI Trust Maturity Survey、Forrester 2026 企業軟體預測、以及 Red Hat 的 BYOA 實踐,可以歸納成四個維度:

1. 政策與治理

定義什麼 AI agent 使用是可接受的、agent 能存取什麼資料、能採取什麼行動。Cloud Security Alliance 推薦五步框架:發現、分類、風險評估、實施控管、持續監控。關鍵是政策要務實可執行,員工因為不切實際而無視的政策比沒有政策更糟。

2. 提供企業級 AI 替代方案

這是四個維度裡最關鍵的一個。數據很清楚:當企業提供正式的 AI 工具時,未授權使用下降 89%。沒有替代方案,光靠政策擋不住員工的需求。替代方案要能真正滿足員工用 ChatGPT 或個人 agent 解決的那些問題,不能只是一個功能閹割版的「企業核准工具」。

3. 技術安全控管

McKinsey 的研究指出,80% 的企業遇過 AI agent 的風險行為。技術層面需要:身分綁定(每個 agent 都有可追蹤的身分)、最小權限原則、即時監控 agent 的行為和資料流、稽核軌跡。

Red Hat 在 OpenShift AI 上的 BYOA 實作提供了一個參考架構:透過 MCP Gateway(基於 Envoy 的代理閘道)統一管控所有 MCP 伺服器,agent 只看得到被授權的工具,OAuth2 token 控制每個後端的存取範圍。平台負責安全和治理,agent 程式碼不需要改寫。

4. 變革管理

告訴員工什麼工具是核准的、什麼不是、為什麼。建立一個安全的提問管道,讓員工不用偷偷摸摸地使用 AI。McKinsey 的報告反覆強調一個比例原則:每花一塊錢在 AI 技術上,應該花五塊錢在人員的準備和轉型上。

Agent 分級管理:三層分類

有效的 Shadow AI 治理政策應該把 AI 工具分成三級:

| 級別 | 定義 | 舉例 |

|---|---|---|

| 完全核准 | 無額外限制,遵守標準資料處理規範即可 | 企業部署的 Claude Agent / Copilot |

| 有條件使用 | 核准但有特定資料處理規則 | 部門自建的 GPT,須遵守 DLP 政策 |

| 禁止 | 高風險或不合規 | 未經稽核的第三方 agent、在外部平台處理 PII |

這個分類要搭配持續更新的 AI 系統清冊。Forrester 預測,2026 年下半年將有一半的企業 ERP 供應商推出自主治理模組,結合可解釋 AI、自動稽核軌跡、即時合規監控。等不及供應商的企業,現在就可以先從盤點和分類做起。

混合勞動力策略:人 + 數位 Agent

未來的勞動力是混合的。你有正職員工、約聘、自由工作者,現在還有 AI agent。BYOA 治理不只是資安議題,更是勞動力規劃的議題。

當 agent 可被看見、可被管理時,它們可以:擴展團隊能量而非取代人、降低外包支出、縮短 AI 投資的回收時間、透過補強團隊能力來支援內部人才流動。McKinsey 在 2026 年組織現況報告中發現,超過 70% 的雇主徵才所需技能同時出現在可自動化和不可自動化的工作中——多數技能依然有用,只是應用方式會改變。AI 流暢度(使用和管理 AI 工具的能力)的需求在兩年內成長了七倍。

這裡的思維轉換是:不要問「哪些工作會被 AI 取代」,要問「哪些能力缺口可以用 agent 來補,怎麼部署最有效」。

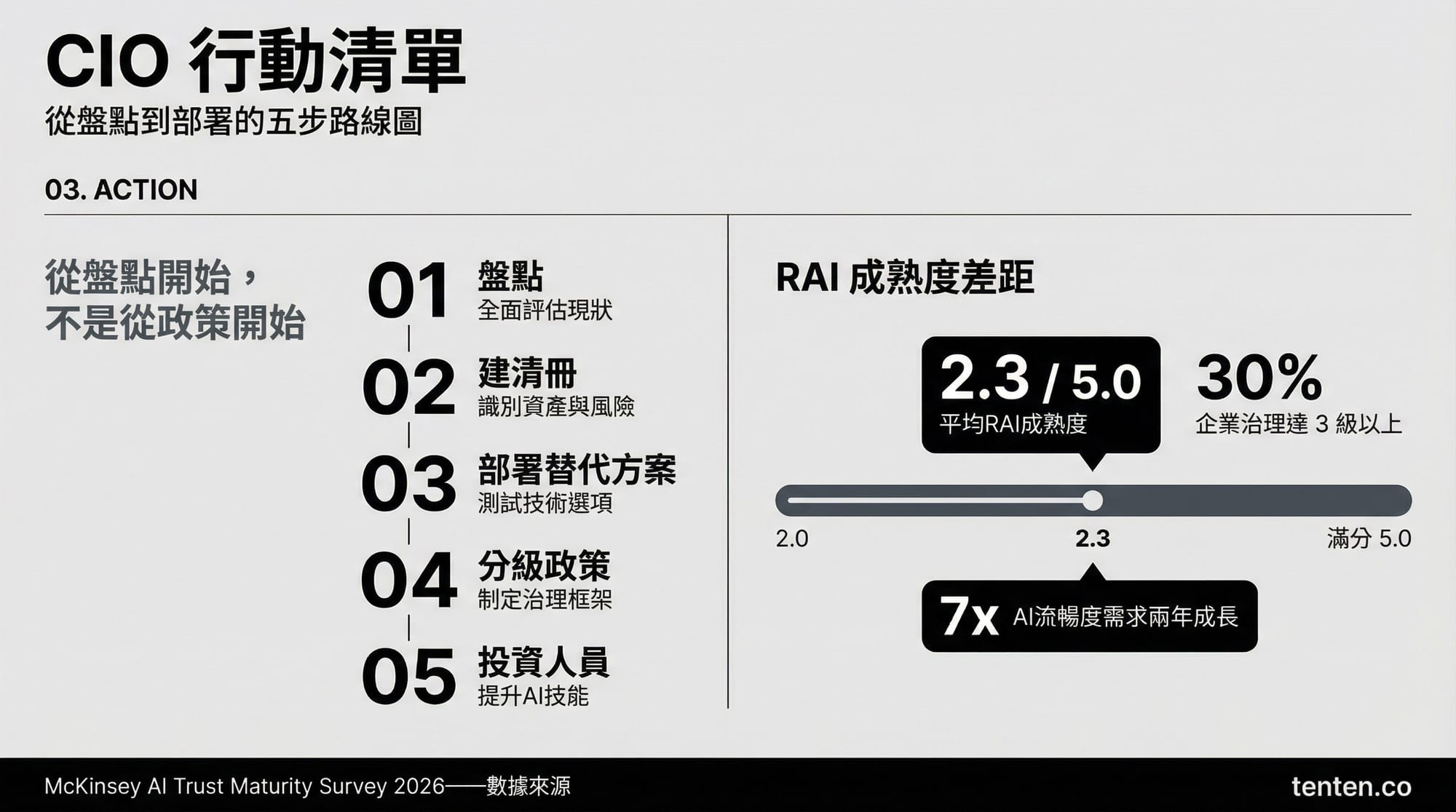

CIO 和 CTO 的下一步

如果你的團隊已經在用 GenAI——統計上來看,這幾乎是確定的——第一步是可見性。

具體來說:

- 盤點現有 agent:你的組織裡有哪些 AI agent?它們是誰建的、在做什麼、存取了什麼資料?

- 建立 agent 清冊:把每個 agent 標記技能、類別、供應商,讓它們從分散在各部門的隱形工具變成可搜尋、可治理、可跨部門復用的資產。

- 部署企業級替代方案:在員工自己找到工具之前,先提供滿足需求的正式方案。

- 設定三級分類政策:完全核准、有條件使用、禁止——搭配對應的資料處理和監控規則。

- 投資人員轉型:技術預算的五倍花在人的準備上。培訓 AI 流暢度、建立跨功能團隊、重新設計含有 agent 角色的工作流程。

McKinsey 的 AI Trust Maturity Survey(2026 年 1 月執行、約 500 家企業參與)有一個不太舒服的發現:平均 RAI(Responsible AI)成熟度分數從 2025 年的 2.0 進步到 2026 年的 2.3(滿分 5),但在策略、治理、agentic AI 控管三個維度,只有大約 30% 的企業達到 3 級以上。技術能力在進步,治理能力沒跟上。

什麼是 BYOA(Bring Your Own Agent)?

BYOA 指的是員工在沒有組織核准的情況下,把個人 AI agent 平台帶進工作場域使用。這個模式跟 2010 年代的 BYOD(Bring Your Own Device)類似,但風險更大——因為 AI agent 具備自主行動能力,不只是存取資料,還會發送郵件、修改記錄、觸發工作流程。

Shadow Agent 跟 Shadow IT 差在哪裡?

Shadow IT 的風險是「資料被存到外部」,Shadow Agent 的風險是「資料被主動送進第三方模型,而且 agent 會持續自主行動」。傳統的資料外洩防護(DLP)工具很難偵測 AI 推論行為,因為它不像傳統的檔案傳輸那樣有明確的流量特徵。

企業禁止 AI 工具有用嗎?

幾乎沒用。多項研究顯示接近一半的員工在禁令後仍繼續使用個人 AI 帳號。反而當企業提供功能足夠的官方 AI 工具後,未授權使用下降 89%。禁令只會把 Shadow AI 推到更深的地下。

CIO 應該優先做什麼?

第一步是可見性——盤點組織裡所有已知和未知的 AI agent,包含它們的技能、資料存取權限、行為模式。第二步是提供企業級替代方案。第三步是建立三級分類的治理政策。

AI Agent 治理跟 AI 模型治理有什麼不同?

模型治理關心的是模型的準確性、偏差、公平性。Agent 治理除了這些,還要管「agent 做了什麼」——它觸發了哪些動作、存取了哪些系統、做了哪些決策。McKinsey 的 Rich Isenberg 說得精準:「Agency 不是一個功能,是決策權的轉移。」問題從「模型準不準」變成「當系統自己行動時,誰負責」。

引用來源

- McKinsey — The Agentic Organization: Contours of the Next Paradigm for the AI Era

- McKinsey — State of AI Trust in 2026: Shifting to the Agentic Era

- Gartner — 40% of Firms to Be Hit By Shadow AI Security Incidents(Infosecurity Magazine 報導)

- Harmonic Security — What 22 Million Enterprise AI Prompts Reveal About Shadow AI in 2025

- Forrester — Predictions 2026: AI Agents, Changing Business Models, and Workplace Culture Impact Enterprise Software

Insights

我們協助多家金融、製造和專業服務客戶建立 AI agent 的治理框架,從盤點現有的 Shadow AI 使用狀況、設計分級政策、到評估企業級 AI 平台的導入。經驗上,最常見的阻力不是技術,而是組織慣性——很多 CIO 知道問題存在,但不確定從哪裡切入。我的觀察是:先做盤點、再提供替代方案、最後才談政策,這個順序比反過來有效得多。先理解員工為什麼偷偷用 AI,才能設計出他們願意遵守的規範。

如果你正在思考企業內 AI agent 的治理策略,或者想評估現有的 Shadow AI 風險,歡迎跟 Tenten 團隊預約諮詢。我們可以從一次盤點工作坊開始。