DeepSeek 於 2026 年 1 月 27 日正式開源 DeepSeek-OCR 2 模型,這款僅 30 億參數的視覺語言模型在文件理解基準測試 OmniDocBench v1.5 上取得 91.09% 的綜合得分,較前代提升 3.73%。核心創新在於採用阿里巴巴的開源 Qwen2-0.5B 模型取代傳統 CLIP 編碼器,實現從「固定掃描」到「語義推理」的架構轉型。

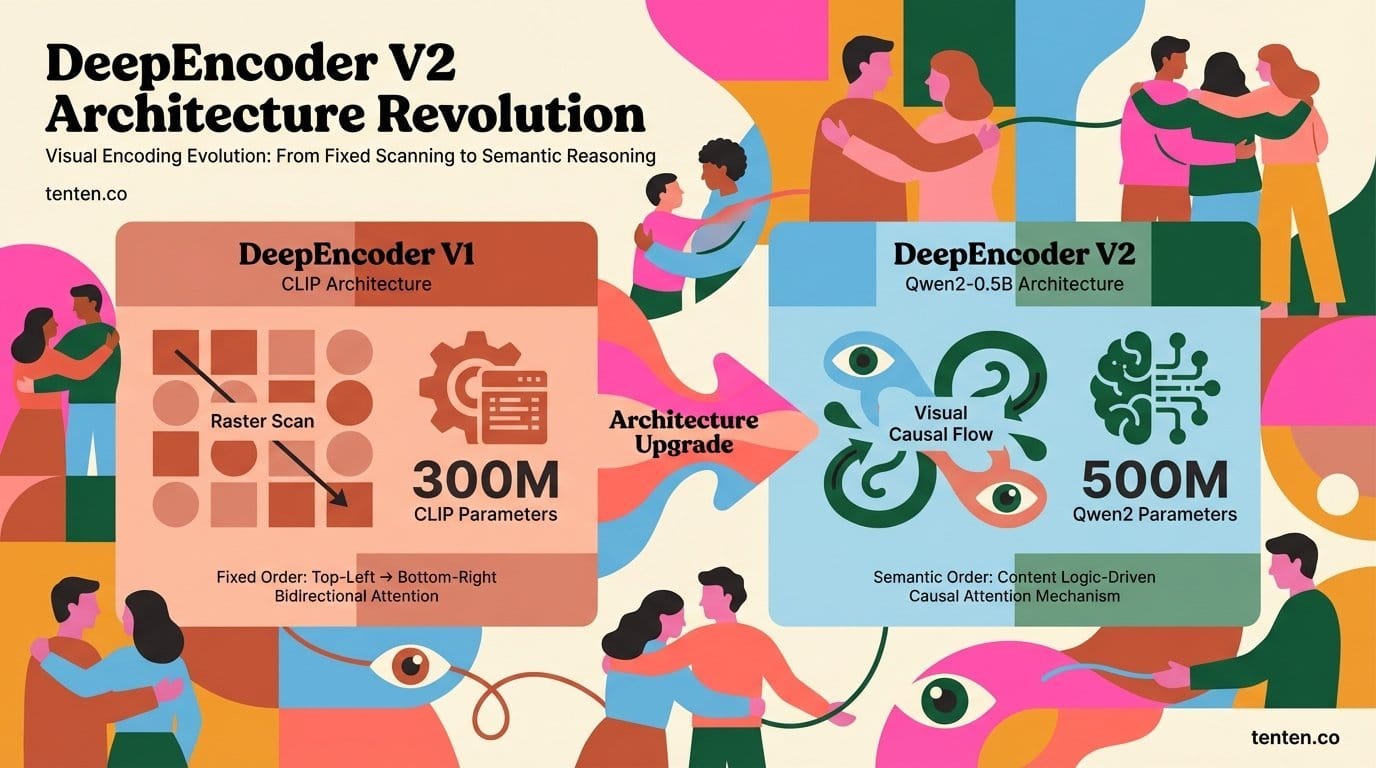

技術架構解析:DeepEncoder V2 的三大突破

DeepSeek-OCR 2 的核心在於全新設計的 DeepEncoder V2 視覺編碼器。與前代採用 CLIP 架構不同,V2 版本引入 LLM 風格的編碼器,透過「視覺因果流」(Visual Causal Flow) 機制重新定義 AI 處理圖像的方式。

傳統視覺語言模型採用柵格掃描 (Raster-Scan) 順序處理圖像,從左上角固定掃描至右下角。這種方式在處理自然圖像時尚可接受,但面對表格、多欄版面、公式等複雜文件時,線性順序往往與真實語義組織嚴重錯位。

DeepEncoder V2 由三個主要組件構成。視覺分詞器沿用 SAM-base 架構(8,000 萬參數)搭配卷積層,將圖像壓縮為視覺 token,實現 16 倍的壓縮率。LLM 風格編碼器採用 Qwen2-0.5B 模型處理視覺 token,並引入可學習的「查詢 token」(Query Tokens)。關鍵創新在於注意力遮罩設計:視覺 token 之間使用雙向注意力維持全局感知能力,而查詢 token 則採用因果注意力,每個查詢 token 僅能看到前面的 token。多解析度裁切策略則透過全局視圖(1024×1024 解析度,對應 256 個因果查詢 token)與局部裁切(768×768 解析度,0 至 6 個視圖共享 144 個查詢 token)的組合,將視覺 token 總數控制在 256 至 1120 之間。

這種架構設計讓模型在編碼階段就「整理」好圖像資訊,依據語義邏輯重新排列視覺 token,而非將所有資訊一次性丟給解碼器處理。

效能實測:超越 Gemini-3 Pro 的閱讀順序理解

在 OmniDocBench v1.5 基準測試中,DeepSeek-OCR 2 展現出多項顯著優勢。

| 模型 | 視覺 Token 數 | 綜合得分 | 閱讀順序編輯距離 |

|---|---|---|---|

| DeepSeek-OCR (前代) | 256-1120 | 87.36% | 0.085 |

| DeepSeek-OCR 2 | 256-1120 | 91.09% | 0.057 |

| Gemini-3 Pro | ~1120 | - | 0.115 |

| Seed-1.8 | 5120 | - | 0.106 |

閱讀順序編輯距離 (R-order Edit Distance) 從前代的 0.085 大幅降至 0.057,直接證明新模型在處理複雜版面時更能理解文件的邏輯閱讀順序。在相近的視覺 token 預算下(約 1120 個),DeepSeek-OCR 2 的文件解析編輯距離(0.100)優於 Gemini-3 Pro(0.115),顯示該模型在維持高壓縮率的同時確保了卓越效能。

實際生產環境數據同樣令人印象深刻。處理線上用戶日誌圖像時,OCR 結果重複率從 6.25% 降至 4.17%;PDF 資料生產場景中,重複率從 3.69% 降至 2.88%。這意味著模型產出的文字更乾淨準確,對 LLM 訓練資料清洗流程具有實質價值。

為何選擇阿里巴巴的 Qwen2 取代 OpenAI 的 CLIP?

這項架構決策反映了開源 AI 生態系統的演進趨勢。CLIP 由 OpenAI 於 2021 年發布,是連結圖像與文字描述的神經網路框架,在 OCR 應用中協助系統識別並解讀圖像中的文字。然而,CLIP 採用雙向注意力機制,所有 token 都能看到全局資訊,這在需要理解閱讀順序的文件處理場景中形成限制。

DeepSeek 選用 Qwen2-0.5B 取代 CLIP 並非單純的「換殼」操作。Qwen2 作為 LLM 架構,天然支援因果注意力機制,能夠實現「視覺 token 的語義重排」——讓編碼器依據圖像內容的邏輯結構決定處理順序,而非固定的空間座標。

這項更動讓 DeepSeek-OCR 2 能夠模擬人類閱讀習慣:先看標題、再看正文,遇到表格時依欄或列瀏覽,碰到多欄版面時自動跳轉。南華早報報導指出,此舉凸顯中國開源生態系統在推進國內 AI 發展中日益重要的角色。

實際應用場景與部署指南

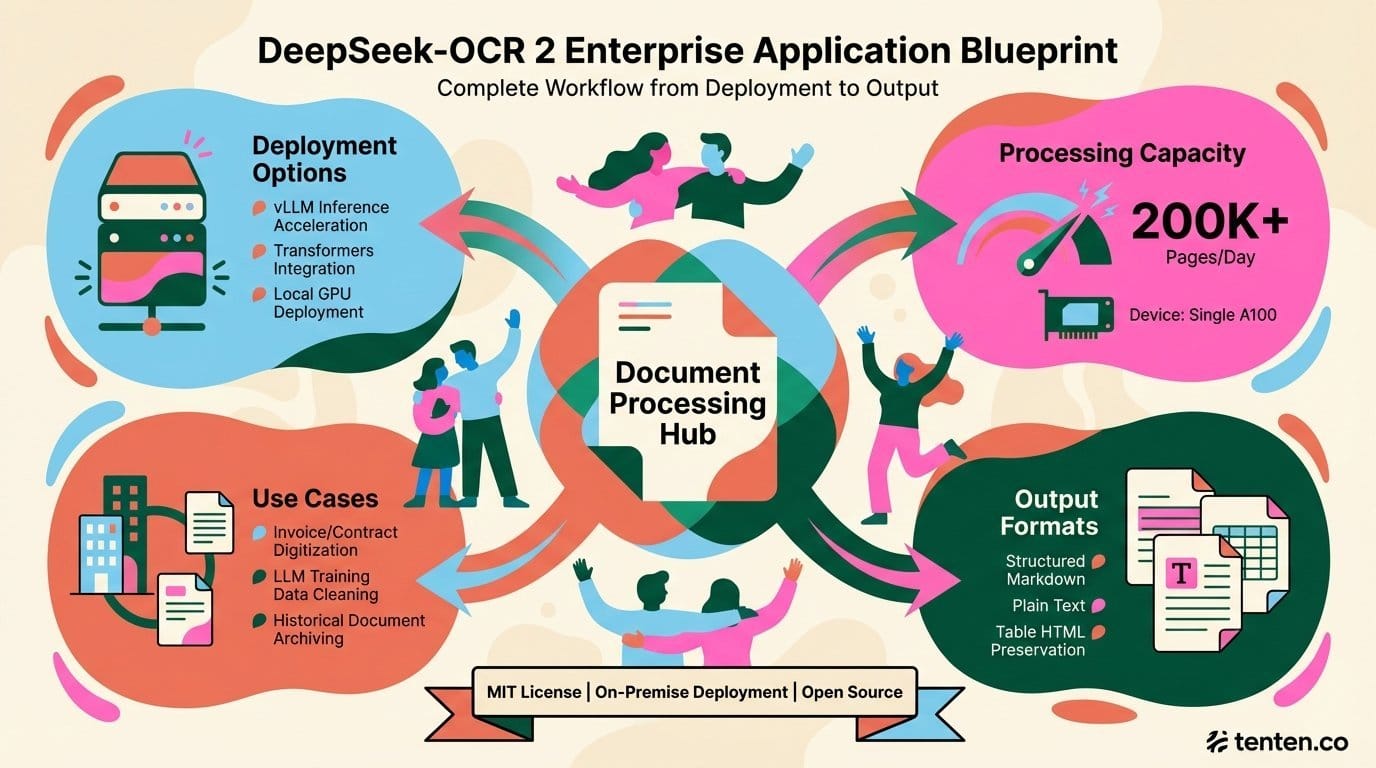

DeepSeek-OCR 2 已在 Hugging Face 開源,支援多種部署方式。

透過 vLLM 進行高效推論時,建議使用 CUDA 11.8 搭配 PyTorch 2.6.0 環境。模型支援兩種主要提示模式:文件模式(<image>\n<|grounding|>Convert the document to markdown.)保留版面結構與表格格式,適合需要維持文件排版的場景;自由 OCR 模式(<image>\nFree OCR.)則適合純文字擷取,不保留版面資訊。

在硬體需求方面,基礎模式可在 8-10 GB 顯示記憶體的 GPU 上運行,而 Gundam 動態拼接模式則建議使用 40 GB 的 A100 以獲得最佳效能。根據效能測試,單張 A100-40G 每日可處理約 20 萬頁文件,H100 和 H200 則分別可達到約 1.5 倍和 1.7 倍的吞吐量。

技術限制與發展方向

DeepSeek 在技術報告中坦承模型並非萬能。在文字密度極高的報紙版面上,DeepSeek-OCR 2 的識別效果不如其他類型文件。團隊指出,這個問題可透過增加局部裁切數量或在訓練過程中提供更多相關樣本來改善。

從更宏觀的視角來看,DeepSeek-OCR 2 驗證了「將 LLM 作為視覺編碼器」的可行性。研究團隊認為這種架構有潛力演進為統一的全模態編碼器,未來只要為同一編碼器配置不同模態的查詢嵌入 (Query Embeddings),就能處理文字、圖像、音訊等多種模態資料,真正實現「萬物皆可 token 化、萬物皆可因果推理」的願景。

對企業文件處理的實際意義

對於需要大規模處理文件的企業而言,DeepSeek-OCR 2 提供了一個成本效益顯著的選項。相較於使用 6,000 個以上視覺 token 的競爭模型,DeepSeek-OCR 2 僅需 256 至 1120 個 token 就能達到同等甚至更優的效能,這意味著更低的運算成本與更快的處理速度。

在資料隱私方面,開源模型允許企業在本地部署,避免將敏感文件上傳至第三方雲端服務。MIT 授權條款也為商業應用提供了法律保障。

然而,企業在評估導入時仍需考量幾個面向:模型對中文文件的支援程度、與現有文件處理流程的整合難度,以及 GPU 基礎設施的投資成本。建議先以小規模概念驗證 (POC) 測試模型在特定文件類型上的表現,再決定是否全面導入。

引用來源

- DeepSeek-OCR 2 Hugging Face 模型頁面

- DeepSeek GitHub 官方倉庫

- South China Morning Post - DeepSeek taps Alibaba open-source AI technology

- OmniDocBench: CVPR 2025 Document Parsing Benchmark

作者觀點

OCR 技術發展至今,早已不只是「把圖像中的文字讀出來」這麼簡單。DeepSeek-OCR 2 真正有意思的地方在於它嘗試解決一個更根本的問題:如何讓機器理解文件的「閱讀邏輯」。

從我們協助企業導入 AI 解決方案的經驗來看,文件處理往往是數位轉型中最容易被低估的環節。許多企業花費大量資源建置先進的 AI 應用,卻在「把紙本資料數位化」這個基礎步驟上卡關。DeepSeek-OCR 2 的出現,讓中小企業也能以合理成本取得企業級的文件處理能力。

— Tenten.co 研究團隊

若您希望進一步了解如何將 AI 文件處理技術整合至企業工作流程,或評估 DeepSeek 系列模型在您業務場景中的適用性,歡迎與 Tenten 團隊預約諮詢,我們將協助您制定最適切的 AI 導入策略。