TL;DR (文章總結)

Google 最新推出的 TurboQuant 演算法震撼了整個 AI 業界。這項純軟體技術能在不犧牲任何準確度的前提下,將 AI 模型的 KV Cache 記憶體需求大幅降低 6 倍,並提升特定處理速度達 8 倍。這不僅讓企業運行大型語言模型 (LLM) 的成本瞬間砍半,更引發了記憶體晶片市場的劇烈波動。透過 PolarQuant 與 QJL 演算法的完美結合,TurboQuant 證明了軟體優化的力量絲毫不亞於硬體升級。

TurboQuant 橫空出世:零成本的效能升級

近期,Google 發布了一項名為 TurboQuant 的突破性 AI 壓縮演算法。與過往需要投入大量資金購買新硬體或重新訓練模型不同,這項技術完全建立在軟體層面。根據在 Nvidia H100 GPU 上針對 Gemma、Mistral 與 Llama 等開源模型的實測數據顯示,導入該演算法後,系統的記憶體消耗銳減,處理速度飆升。最令人驚豔的是:這一切的效能躍升伴隨著「零準確度損失」。

對於依賴 API 呼叫、AI 代理工作流 (Agentic Workflows) 或長文本處理的企業而言,這意味著推論成本 (Inference Cost) 將直接減半。無需微調模型,即可享受上下文窗口擴展與處理速度翻倍的紅利。

揭開 KV Cache 與大語言模型的神秘面紗

要理解這項技術的偉大之處,我們必須先探討大型語言模型背後的運作機制。自從 Google 發表了著名的《Attention Is All You Need》論文後,Transformer 架構便成為了現代 AI 的基石。

模型在閱讀文本時,會不斷計算字詞之間的關聯性。為了避免每次遇到相同詞彙都要重新計算,模型會將這些「記憶」儲存在一個名為 KV Cache(鍵值快取)的空間中。您可以將其想像成一個虛擬檔案夾:標籤(Key)用來快速尋找,裡面的文件(Value)則包含了該詞彙在特定上下文中的深層語義。然而,隨著對話歷史與上下文的增加,KV Cache 會佔用極其龐大的記憶體資源,這也是為何過往 AI 運算如此昂貴的原因。

突破性雙核心:PolarQuant 與 QJL 演算法

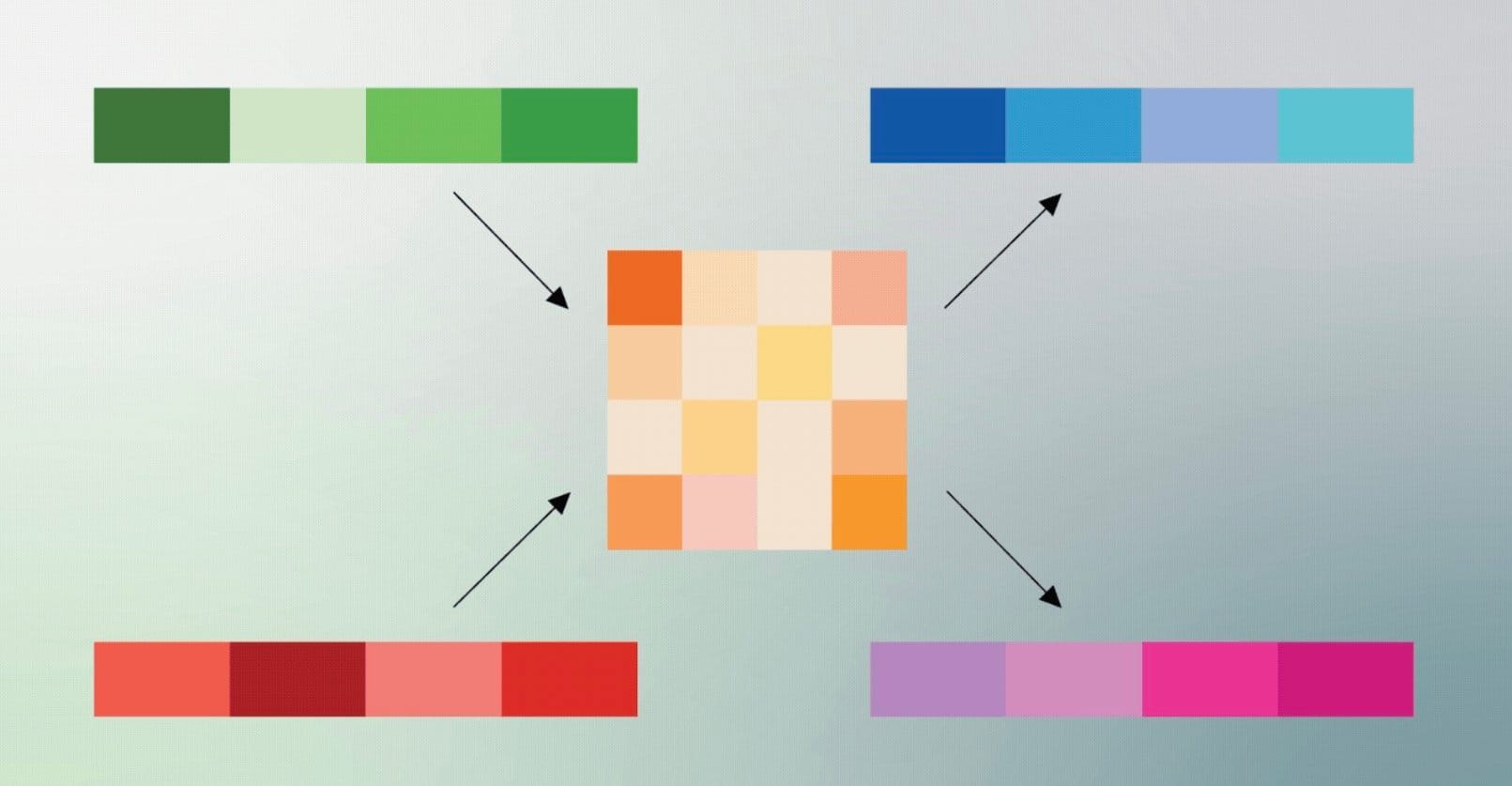

TurboQuant 之所以能達成這項奇蹟,歸功於其旗下的兩大技術支柱:

- PolarQuant(極座標量化):傳統模型在向量空間中尋找詞彙關聯時,就像是給予「往東走三條街、往北走四條街」的網格座標指令。PolarQuant 則將其轉換為極座標系統,直接「指向」目標並計算距離與角度。這種方法將資料映射到固定的圓形網格上,徹底消除了傳統方法中昂貴的資料正規化記憶體開銷。

- Quantized Johnson-Lindenstrauss (QJL) 演算法:這是確保「零誤差」的秘密武器。極少量的壓縮誤差會由這個極度輕量、高速的 QJL 演算法進行檢測與校正,從而完美補足了 PolarQuant 在壓縮過程中的微小偏差。

記憶體晶片市場的震盪與 Jevons 悖論

由於 TurboQuant 大幅降低了硬體記憶體的需求,市場投資人產生了「未來將不再需要這麼多晶片」的恐慌心理,導致多家記憶體大廠股價重挫。以下為受影響的企業數據概覽:

| 企業名稱 (Company) | 股價跌幅 (Stock Drop) | 官方連結 (Reference) |

|---|---|---|

| SK Hynix | -6.0% | SK Hynix 官網 |

| Samsung | -5.0% | Samsung 官網 |

| SanDisk | -5.7% | SanDisk 官網 |

| Western Digital | -4.7% | WD 官網 |

| Micron | -3.0% | Micron 官網 |

然而,熟悉經濟學的專家很快指出了 Jevons 悖論 (Jevons Paradox) 的存在。當一項資源的使用效率提升、成本下降時,往往會激發出更多過去未曾想像的新應用場景。隨著運算力變得廉價,像 Anthropic 的 Claude Code 或即將推出的 Mythos 模型,以及各類複雜的 AI 代理都將迎來爆發性成長。需求不但不會減少,反而可能倍數增加。

觀點

我認為 Google 這次開源 TurboQuant 的舉動,其歷史意義不亞於當年發表 Transformer 論文。在各大科技巨頭試圖透過「囤積晶片」建立算力護城河的今天,Google 選擇用純粹的數學與軟體工程來打破硬體瓶頸。這再次證明了:演算法的優雅往往能戰勝暴力的硬體堆疊。我們正站在 AI 普及化的新轉捩點,軟體驅動的效能革命才剛拉開序幕!