Multica 自託管 是目前最快速竄起的開源 AI Agent 管理平台解決方案——專案於 2026 年 1 月 13 日在 GitHub 開源,截至 2026 年 4 月 17 日累積超過 15,400 顆星、1,900 個 Fork,僅花三個月就擠進 GitHub Global Rank 前 3,300 名。它解決的問題很具體:開發者同時使用 Claude Code、Codex、OpenClaw、OpenCode、Hermes、Gemini、Pi 和 Cursor Agent 時,缺一個能把這些 CLI 工具當「虛擬團隊成員」統一管理的協作平台。Multica 就是這個管理層——任務指派、技能累積、執行環境監控通通整合在一個儀表板上,而且可以完全跑在自己的伺服器裡。

這篇文章會拆解 Multica 的架構、部署流程、授權條款的灰色地帶,以及在 Anthropic 自己於 2026 年 4 月 8 日推出 Claude Managed Agents 之後,自託管路線還剩多少空間。

Multica 在解決什麼問題:AI 生產力悖論的管理層缺口

工程團隊導入 AI Coding Agent 已經三年,但組織層級的交付速度並沒有跟著變快。Faros AI 在 2025 年分析了 1,255 個團隊、超過 10,000 名開發者的遙測數據後發現:高度使用 AI 的團隊,個人任務完成數增加 21%、合併的 PR 數量暴增 98%,但 PR 審查時間也拉長了 91%,Context Switching 多了 47%。METR 的隨機對照試驗更進一步——實際上,資深工程師使用 AI 後平均慢了 19%,但他們主觀上以為自己快了 20%。

這就是 Faros 定義的 AI 生產力悖論(AI Productivity Paradox):個人產出提升,組織交付卻沒動靜。瓶頸從「寫程式」移到「審查程式」和「協調多個平行任務」上,而大多數團隊缺一個能讓人類和 Agent 共用的工作檢視層。

| 指標(Faros AI 2025 報告) | 變化幅度 | 意義 |

|---|---|---|

| 個人任務完成數 | +21% | 寫得更快 |

| 每日合併 PR 數 | +98% | 產出幾乎翻倍 |

| PR 平均審查時間 | +91% | 新瓶頸出現 |

| 每日接觸 PR 數 | +47% | Context Switching 爆增 |

| 組織層級交付速度 | 幾乎無改善 | Amdahl's Law 實證 |

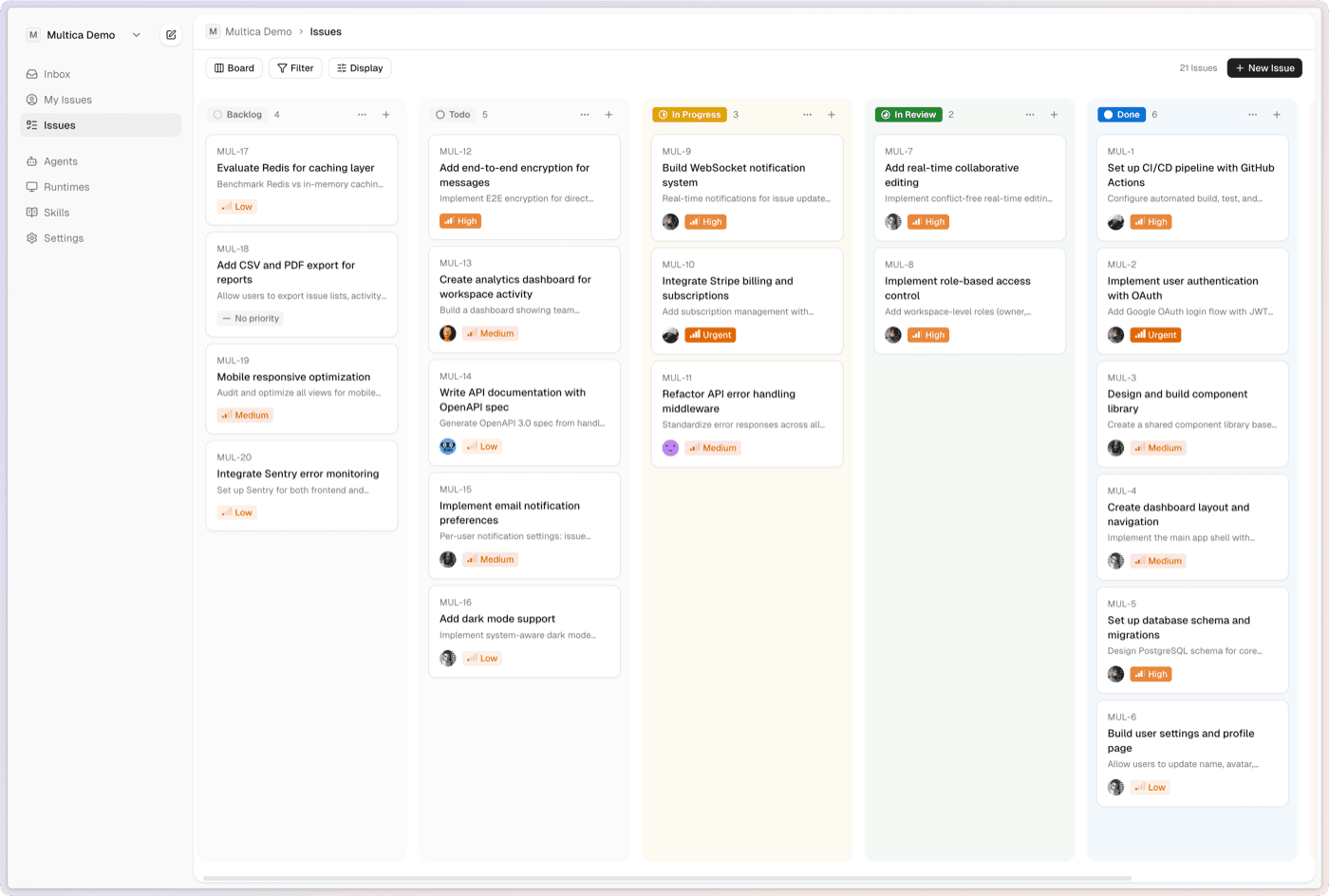

Multica 切入的就是這個缺口——它不是另一個 Agent 框架,而是一個管理 Agent 的平台。CrewAI 和 LangGraph 幫你把多個 Agent 用程式碼串接起來;Multica 把 Agent 當作可以被指派任務、會在 Kanban 板上有頭像、會主動回報 Blocker 的「團隊成員」。

Multica 架構解析:管理層與執行層解耦

Multica 的技術堆疊走前後端分離路線,核心區分是「管理看板」和「Agent 實際執行 Code 的地方」要徹底分開。

| 元件層級 | 技術選型 | 職責 |

|---|---|---|

| 前端儀表板 | Next.js(TypeScript) | 任務看板、Workspace 管理、即時活動流、Agent Profile 設定 |

| 後端 API 服務 | Go 1.26+ | Task Lifecycle 管理、WebSocket 即時推送、資料存取層 |

| 資料庫 | PostgreSQL 17 + pgvector 擴充 | 任務狀態、Agent 技能向量儲存、Transcript 紀錄 |

| 本地執行層 | multica CLI + Daemon | 偵測 PATH 上的 Agent CLI、領取任務、回報進度 |

| 通訊協定 | WebSocket(支援 /ws 端點) | 即時同步任務狀態與 Agent 輸出 |

這種架構有個重要的實務意義:Agent 實際執行程式碼的動作發生在你的機器上,Multica 伺服器只負責協調任務狀態和廣播事件。你的程式碼不會流經 Multica 的伺服器(官方原話:「Code never passes through Multica servers」),這對資料主權要求高的團隊很關鍵。

Multica 目前支援八個 Agent CLI:Claude Code、Codex、OpenClaw、OpenCode、Hermes、Gemini、Pi 和 Cursor Agent。Daemon 啟動時會掃描 PATH,有什麼就用什麼,不需要寫 Adapter。

完整自託管部署流程:從零到生產環境

Multica 的自託管有三種路徑:Docker Compose 一鍵啟動、單一 Binary,以及 Kubernetes 部署。對絕大多數團隊來說,Docker Compose 路線最快。

本地開發部署(5 分鐘搞定)

官方提供一行指令安裝 CLI 並啟動自託管伺服器:

# 安裝 CLI + 自架伺服器

curl -fsSL https://raw.githubusercontent.com/multica-ai/multica/main/scripts/install.sh | bash -s -- --with-server

# 設定 CLI、授權、啟動 Daemon

multica setup self-host

這段腳本會自動 clone repository、跑 Docker Compose 拉起所有服務、安裝 multica CLI,然後把 CLI 設定指向 localhost。成功後前端在 http://localhost:3000、後端 API 在 http://localhost:8080。

若要手動執行,流程是:

git clone https://github.com/multica-ai/multica.git

cd multica

make selfhost

make selfhost 會自動從 .env.example 建立 .env、生成隨機 JWT_SECRET、啟動所有 Docker Compose 服務。

本地登入:驗證碼 888888 的陷阱

官方文件提供一個方便的開發驗證碼「888888」,任何 email 搭配這組碼都能登入——但這只在 APP_ENV=development 時有效。Docker Compose 自託管設定的預設值是 APP_ENV=production(寫在 docker-compose.selfhost.yml 裡),所以安全預設是關閉這個後門。要用 888888,得手動把 .env 的 APP_ENV 改成 development 再重啟後端。

多數團隊正式上線時不會這樣做。建議串接 Resend 的 API,設定 RESEND_API_KEY,系統會寄送真實驗證碼到輸入的信箱。

生產環境必備的額外設定

本地開發跑得動不代表能上生產環境。以下是幾個實務重點:

反向代理與 TLS:前端 3000、後端 8080 要用 Nginx 或 Caddy 接 TLS 憑證。特別注意後端有 WebSocket 端點(/ws),反向代理得設定 proxy_http_version 1.1、Upgrade header 和 proxy_read_timeout 86400,不然長時間任務會斷線。

資料庫配置:PostgreSQL 17 必須要有 pgvector 擴充套件——Multica 的 Skills 功能用向量儲存語意搜尋。如果用既有的 PostgreSQL 實例,記得 CREATE EXTENSION IF NOT EXISTS vector; 並把 DATABASE_URL 寫入 .env。

認證機制:Resend 目前是官方建議的 Magic Link 方案。想換成 OAuth 或 SSO 得改 server/auth 模組。

JWT_SECRET:make selfhost 會自動產生一個隨機字串,但如果你手動部署多台機器,要用同一組 JWT_SECRET,不然 Session 會互相拒絕。

檔案儲存:小規模用本地檔案系統就好,規模大可接 AWS S3 + CloudFront CDN。

遷移資料庫

所有 Schema 遷移會在後端啟動時自動執行。手動觸發的指令:

./server/bin/migrate up

# 或從源碼

cd server && go run ./cmd/migrate up

Apache 2.0 授權的灰色地帶:不是你想的那個 Apache 2.0

Multica 在 GitHub 上標示「Apache-2.0 license」,但實際的 LICENSE 檔案是修改版的 Apache 2.0,加了兩條關鍵限制:

第一條限制 Hosted Service。未經 Multica 書面授權,不能用 Multica 原始碼對第三方提供 Hosted 服務,也不能把 Multica 當成商業產品的核心元件銷售。這一條直接排除了 SaaS 業者拿 Multica 改造後賣授權的可能。

第二條限制 Logo 與版權資訊。你不能移除或修改 Multica 前端介面(apps/web/ 目錄下的所有元件)的 Logo 和版權資訊。Docker 部署時這也包含「web」映像。

但有個重要例外:單一組織內部使用(包含多個 Workspace)不需要商業授權。所以企業內部 IT 團隊、顧問公司替自家客戶部署都沒問題。

這種授權模式叫 Source-Available with Commercial Restrictions,跟 Dify.AI、Appsmith、Taiga 等專案用的模式雷同。嚴格來講這已經不是純粹的 Apache 2.0,所以 OpenHub 等追蹤工具會把它標成 NOASSERTION。如果你團隊的法務對「Open Source」的定義有明確要求(如符合 OSI 認定),這一點要事先釐清。

Multica vs Claude Managed Agents vs 其他平台

Anthropic 在 2026 年 4 月 8 日推出 Claude Managed Agents 公開 Beta,價格是標準 Claude API Token 費率加每小時 0.08 美元(約 NTD 2)的 Session 費。這直接踩到 Multica 的市場。

| 平台 | 定位 | 模型鎖定 | 自託管 | 計費模式 | 適合的團隊 |

|---|---|---|---|---|---|

| Multica | 管理平台(開源) | 無(支援 8 種 CLI) | Docker / K8s / Binary | 免費(自己付基礎設施) | 要資料主權、多模型靈活度 |

| Claude Managed Agents | 基礎設施託管(Anthropic) | 僅 Claude 模型 | 否 | API Token + $0.08/小時 | 想快速上線、不想管 ops |

| CrewAI | Agent 框架(開源) | 無 | 自己寫 code | 免費 | 需要程式化編排 Agent 互動 |

| LangGraph | Agent 框架(開源) | 無 | 自己寫 code | 免費(或雲服務) | 複雜狀態機、自訂 Workflow |

| Cabinet | 持久記憶 Agent(開源) | 無 | 是 | 免費 | 需要排程任務和記憶累積 |

如果團隊每天跑 24 個 Agent、每個每天運作 8 小時,光是 Claude Managed Agents 的 Session 費用就是 15.36 美元/天(約 NTD 492/天),還沒算 Token 費——規模一大,自託管 Multica 的 ROI 就浮現了。

框架 vs 平台的差別也很重要:CrewAI 和 LangGraph 是開發者工具,你要寫程式碼定義 Agent 之間怎麼互動。Multica 是管理產品,你在 UI 上指派任務,Agent 自己領。兩種邏輯不衝突,甚至可以組合——Multica 底下跑 CrewAI 寫的 Agent 完全可行。

GitHub 社群的質疑:Multica 把 AI 當人管,對嗎?

2026 年 4 月 13 日,使用者 ImGoodBai 在 GitHub Issue #815 提出一個尖銳的觀察:Multica 現在仍然是用管理「人」的邏輯在管理 AI。看一下 server/cmd/multica/cmd_issue.go 的 Issue 狀態機,可用狀態是 backlog / todo / in_progress / in_review / done / blocked / cancelled——這是人類工程團隊的 Kanban 狀態。

他認為真正的 Agent-First 系統應該有受控的階段狀態機:需求核准 → 方案核准 → 實作 → 測試 → 驗收 → 提交 → 合併。每個階段有自動的 Gate Check,不是 Kanban 卡片上的人工拖拉。

這個討論目前還開著,官方沒回應。對想跳下來自己自託管的團隊來說,這是個要評估的前瞻性風險——今天夠用,未來 Agent 自主性提高後,Multica 的管理模型可能要換一代。

不過對 2026 年當下的多數場景,Kanban + Task 指派的邏輯就是夠用的,因為現實就是 Agent 還需要人監督。DX Q4 2025 Impact Report 的數據顯示,266 家工程組織裡 AI 編寫的程式碼佔合併量的 22%——不是主流,是補強。Claude Code 在工作場合的採用率也才 18%(Pragmatic Engineer 2026 開發者工具調查),滿意度雖然高達 91% CSAT,但規模還沒到取代人的程度。

誰該用 Multica?誰不該?

適合的團隊

中小型工程團隊(5–50 名開發者):已經在用 Claude Code 或 Cursor,想要統一的看板和技能共享。

數位代理商和顧問公司:多個客戶、多個 Codebase、多套 Access Control——Multica 的多 Workspace 隔離可以讓每個客戶有自己的邊界。

金融、醫療、製造業等受監管產業:台灣的個資法、GDPR、HIPAA 規範下,程式碼不能離開內網。Multica 的自託管路徑完全滿足資料主權要求。

Fortune 500 的內部 IT 部門:正在導入 BYOA(Bring Your Own Agent) 策略、需要可稽核的 AI 工作流。

不適合的團隊

個人開發者只為了單檔修改:殺雞用牛刀,用原生 Claude Code CLI 就夠。

純 SaaS 業者想轉賣 Multica:授權條款直接禁止。

只用一個 AI 模型且不在乎 Vendor Lock-in:直接上 Claude Managed Agents 比較省事,每小時 0.08 美元(約 NTD 2)就能跳過所有 ops 工作。

沒有 DevOps 能力的團隊:自託管要顧 PostgreSQL、Docker、TLS 憑證、Session、檔案儲存——沒這些知識硬上會踩雷。

常見問題(FAQ)

Multica 是 Agent 框架還是編排平台?

Multica 是編排與管理平台。它不取代 Claude Code、Codex 或 OpenClaw——它在這些 Agent CLI 之上,提供任務指派、生命週期管理、技能累積和統一儀表板。你帶自己的 Agent CLI 進來,Multica 負責協調。

自託管 Multica 的程式碼會外流嗎?

不會。根據官方說明,Agent 執行程式碼的動作只發生在你的本地 Daemon 或你自己的雲端 Runtime 上。Multica 伺服器只協調任務狀態和廣播事件,程式碼內容不經過 Multica 的伺服器。

自託管 Multica 等於自託管 LLM 嗎?

不等於。Multica 管的是任務編排層,LLM 推理仍然取決於你接的是 Anthropic API、OpenAI API,還是本地 Ollama 模型。要真正「100% 地端」,得同時自託管 Multica 和 LLM。

商業授權費用多少?

官方目前沒有公開定價,要直接聯絡 Multica 團隊報價。參考類似的 Source-Available 專案(如 Dify.AI),費用多半按部署規模、使用者數量和客製需求計算。

企業能支援多少並發 Agent?

開源版本沒有人為上限,取決於你連了幾台 Runtime 和每台機器的硬體配置。每個 Agent 可以設定並發限制。

參考資料與引用來源

- GitHub — multica-ai/multica 原始碼與 README

- Faros AI — The AI Productivity Paradox Report 2025

- Google DORA Report 2025 — AI Impact on Software Delivery

- Stack Overflow Developer Survey 2025

- Gartner — Enterprise AI Agent Adoption Forecast (August 2025)

- METR — Measuring the Impact of AI Tools on Developer Productivity (July 2025)

- Multica 官方自託管文件

Author Insight

作者:Erik(EKC),Tenten.co Digital Strategy Director

我們團隊在替客戶評估 AI Agent 平台時,Multica 是目前為數不多能同時滿足「開源」「支援多 Agent CLI」「真正 Kubernetes 可部署」三個條件的專案。但這不代表它適合每個場景。

實際部署時遇到的幾個痛點值得先提醒:第一,pgvector 擴充在某些雲端託管 PostgreSQL(特別是 GCP Cloud SQL 較舊版本)不是預設啟用的,規劃時要先確認。第二,Resend 在台灣寄送到 Gmail 有時會進垃圾信,早期用戶註冊流程要搭配白名單機制。第三,ImGoodBai 在 Issue #815 提的批評我同意——Multica 目前的 Issue 狀態機確實是人類工作流的翻版,2026 年底 Agent 自主性越來越強之後,這個模型可能不夠用。但 2026 上半年的現實是,大多數團隊連「把 Agent 的進度看清楚」都還沒做到,Multica 解的剛好是這個當下的痛。

另一個觀察:Multica 的真正護城河不在技術,在於它早早決定支援 8 種 Agent CLI 而不是綁單一廠商。Anthropic 推出 Claude Managed Agents 把自家路徑鎖死了,Google 和 OpenAI 接下來也會推自己的託管服務,Multica 作為中立的管理層有獨特位置。問題是它能撐到什麼時候還不能綁單一模型——這要看社群和開發者的態度。