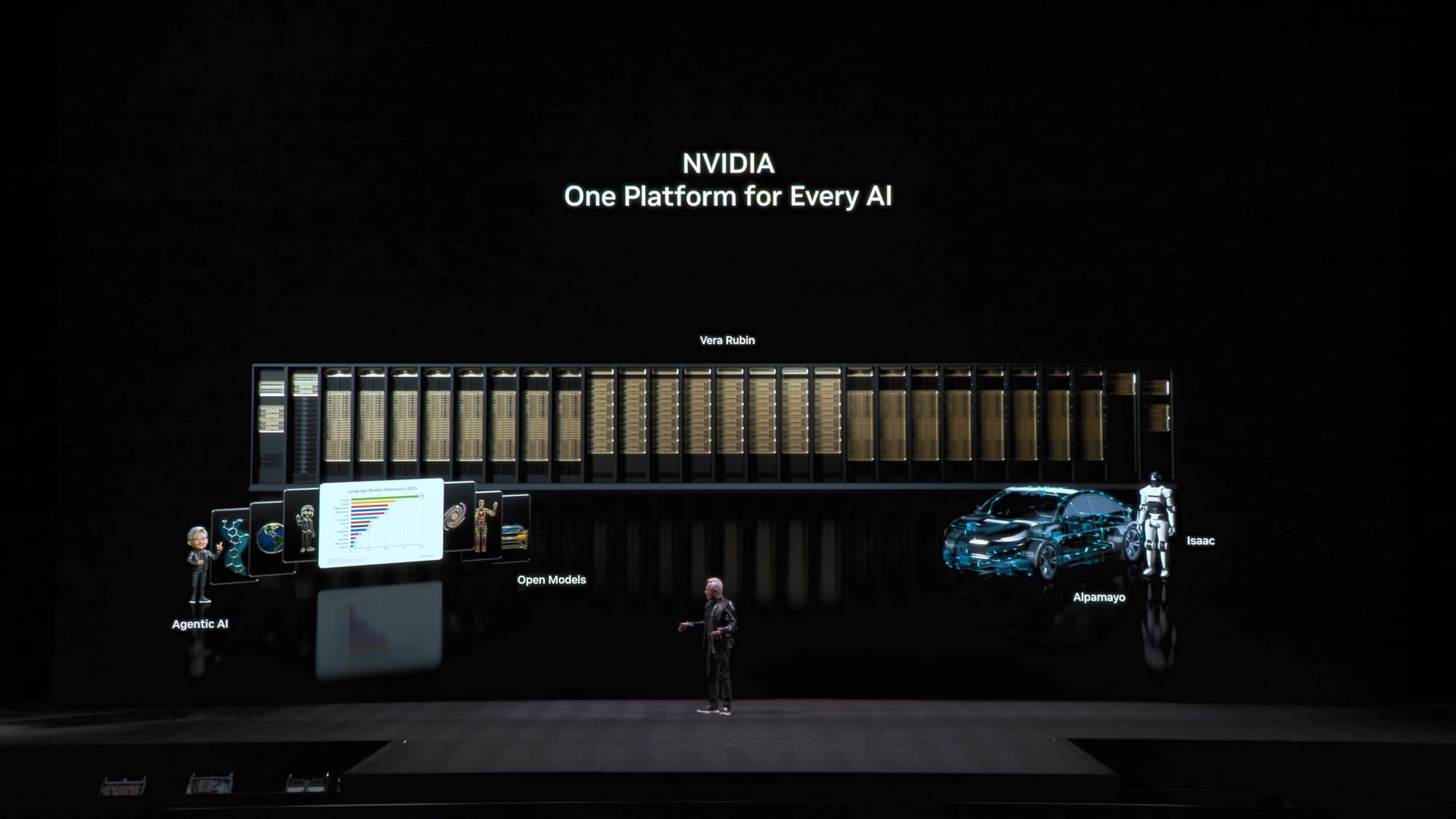

2026 年 CES 大會上,NVIDIA 執行長黃仁勳揭開了 Vera Rubin 平台的面紗。這不是單純的 GPU 升級,而是一套完整的 AI 運算基礎設施,標誌著算力發展進入新階段。

當摩爾定律放緩,晶體管微縮逼近物理極限,NVIDIA 選擇了不同的突破路徑:透過系統級協同設計,將六款核心元件整合為統一平台。Rubin GPU 的推理性能較前代提升 5 倍,訓練性能提升 3.5 倍,這些數字背後是對先進封裝技術的深度應用。

Vera Rubin 平台核心架構

Vera Rubin 採用黃仁勳所稱的「極端協同設計」(Extreme Co-design)策略。六款元件各司其職,又緊密整合:

| 元件 | 技術規格 | 產業影響 |

|---|---|---|

| Rubin GPU | 新一代 Tensor Core,晶體管數量增加 1.6 倍 | 推理成本降低約 10 倍 |

| Vera CPU | 88 個定製 Olympus Arm 核心,空間多線程技術 | 消除 CPU 瓶頸 |

| NVLink 6 Switch | 頻寬達 260TB/s | 144 塊 GPU 可作為單一運算單元運作 |

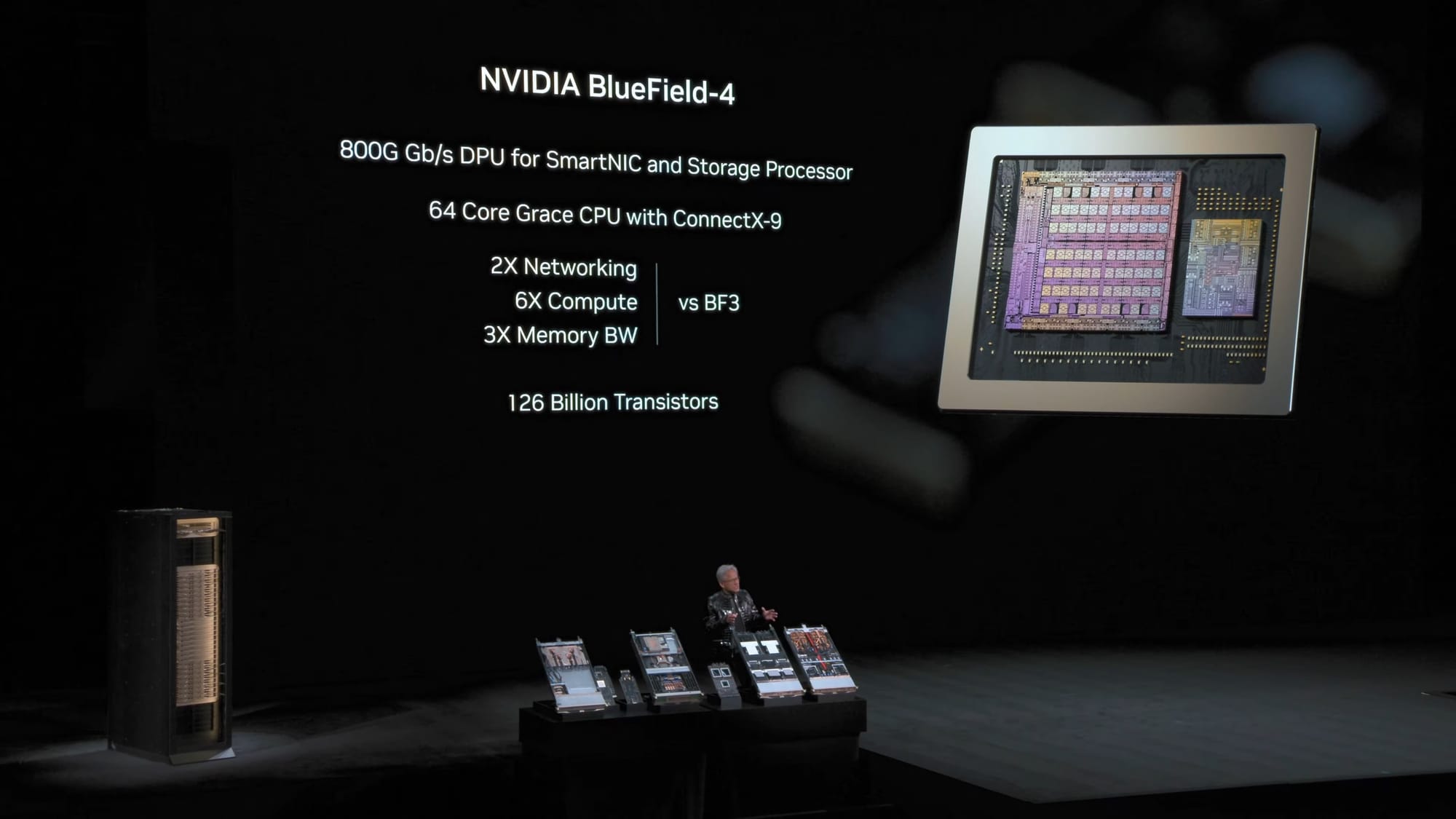

| BlueField-4 DPU | 16TB 級推理上下文記憶體 | 支援長期連續推理任務 |

| Co-packaged Optics | 光引擎直接整合於晶片封裝 | 降低能耗與延遲 |

| Spectrum-6 Switch | AI 流量優化乙太網交換機 | 確保大規模叢集資料流通暢 |

260TB/s 的 NVLink 6 頻寬數字驚人,約為全球網際網路總頻寬的兩倍。這使得機架內的 GPU 群組能以近乎零延遲的方式協同運作,對於訓練下一代基礎模型而言是關鍵突破。

BlueField-4 DPU 帶來的 16TB 共享高速記憶體,解決了長期困擾 AI 系統的「記憶斷層」問題。過去的推理系統在處理長對話或複雜任務時,常因上下文長度限制而失去連貫性。新架構讓 AI Agent 能維持更長的任務脈絡,這對企業級應用尤為重要。

技術規格與架構突破

Vera Rubin NVL72 核心配置

Vera Rubin 平台整合六款全新晶片:Vera CPU、Rubin GPU、ConnectX-9 SuperNIC、BlueField-4 DPU、NVLink 6 交換器與 Spectrum-6 乙太網路交換器。單一機架整合 72 顆 GPU,透過 NVLink 6 實現每秒 240 TB 的內部頻寬,約為當前全球網際網路流量的兩倍。

Vera CPU 採用 NVIDIA 自研 Olympus 核心,配置 88 核心並支援每核心雙執行緒。NVIDIA 稱此為「空間多執行緒」技術,每核心配備 2MB L2 快取(較 Grace 增加一倍),共享 L3 快取達 162MB。Rubin GPU 採用 台積電 3 奈米製程,整合 3360 億顆電晶體,較 Blackwell B200 的 2080 億顆增加 62%。

能源效率革新

Vera Rubin NVL72 採用全液冷設計,使用 45°C 溫水即可完成散熱,無需傳統冷卻機組。NVIDIA 估計此設計可降低全球資料中心約 6% 的能源消耗。單一機架功耗約 130kW,較 Grace Blackwell 平台功耗密度翻倍,但散熱效率大幅提升。

Test-time Scaling:AI 思維模式的轉變

Vera Rubin 的硬體革新為 Test-time scaling(測試時間擴展)技術提供了基礎設施支撐。這項技術讓 AI 在推理階段投入更多運算資源,進行多輪內部推理與驗證,再給出最終答案。

根據 Hugging Face 的研究,這種「慢思考」模式讓小型語言模型也能展現接近大型模型的推理能力。差異在於運算時間與成本的權衡。Vera Rubin 的性價比優勢,讓這種原本昂貴的推理策略變得實際可行。

NVIDIA 將這種能力首先應用於自動駕駛領域。搭載 Alpamayo 推理模型的賓士 CLA 車隊預計在 2026 年第一季上路測試。這款模型的特點在於可解釋性,它能說明決策邏輯,例如:「偵測到前方藍色 SUV 行駛軌跡異常,雖仍在車道內,但預判可能變換車道,因此降低車速。」

這種透明度對於監管合規與使用者信任至關重要。自動駕駛技術的發展長期受限於「黑盒子」問題,可解釋的推理模型是突破這一瓶頸的關鍵。

物理 AI 與工業元宇宙

NVIDIA 與西門子的合作展示了 Omniverse 平台在工業場景的應用深度。在建造實體工廠之前,企業可在數位孿生環境中進行完整模擬。

Cosmos 世界模型在此扮演核心角色。機器人在虛擬環境中完成數百萬次操作訓練,學習的經驗可直接遷移至真實世界。這種 Sim-to-Real(從模擬到現實)的技術路徑,大幅縮短了機器人從開發到部署的時間週期。

工業 4.0 的願景談了多年,阻礙落地的往往是驗證成本。在實體產線上測試新演算法的代價高昂,失敗的後果可能包括設備損壞與生產中斷。數位孿生環境提供了低成本的試錯空間,這對製造業的 AI 導入具有實質推動作用。

基礎設施投資的新維度

Vera Rubin 的發布也凸顯了 AI 基礎設施投資的規模升級。根據產業分析,支撐下一代 AI 系統的不僅是晶片效能,更包括電力供應、冷卻系統、高速網路等基礎設施。

Co-packaged Optics 技術的導入,某種程度上是對能源效率的回應。傳統銅線在高速傳輸時的熱損耗顯著,光學傳輸的能效優勢在大規模部署中格外明顯。資料中心的營運成本結構正在改變,能源效率成為競爭力的核心指標。

這也呼應了傑文斯悖論(Jevons Paradox)的觀察:當效率提升使單位成本下降,總體消耗往往反而增加。AI 運算效率的提升,可能刺激更大規模的模型訓練與更廣泛的推理應用,進而推動電力需求的持續成長。

產業競爭格局的影響

Vera Rubin 的技術規格設定了新的產業標竿。AMD 與其他競爭者需要回應的不僅是單一晶片的性能指標,而是整套系統架構的協同效率。

對於企業採購決策者而言,評估框架也隨之調整。過去以 GPU 規格為主的比較方式,需要擴展至網路頻寬、記憶體架構、軟體生態等多維度考量。NVIDIA 的 CUDA 生態系統多年積累的開發者資源,與硬體形成的綜合優勢,是後進者難以快速複製的。

台積電的先進製程在這波競爭中持續扮演關鍵角色。Vera Rubin 的晶片製造仰賴最先進的封裝與製程技術,這讓半導體供應鏈的戰略重要性進一步提升。

開源模型策略與生態布局

DeepSeek R1 效應

黃仁勳在演講中肯定 DeepSeek R1 對產業的影響:「DeepSeek R1 是首個開源推理模型,讓全世界驚艷。」他指出開源模型正在快速縮小與閉源前沿模型的效能差距,並展示一張追蹤曲線,其中列出 DeepSeek-V3.2、Kimi K2 與 Qwen 三款中國開發模型。

NVIDIA 的策略轉向「賣鏟子而非挖金」——開放 Alpamayo、Cosmos、GR00T、Nemotron、Clara 等模型系列,讓全球開發者免費取得。下載量在 2025 年爆發性成長,每一次模型訓練與推論都需要 NVIDIA 硬體支援。黃仁勳稱此為「開放模型啟動全世界」。

模型家族矩陣

NVIDIA 目前開放六大領域模型:Clara(醫療)、Earth-2(氣候科學)、Nemotron(推理與多模態)、Cosmos(機器人與模擬)、GR00T(具身智能)、Alpamayo(自駕車)。總計釋出 10 兆語言訓練 token、50 萬筆機器人軌跡資料、45.5 萬筆蛋白質結構與 100TB 車輛感測器資料。

市場競爭格局

NVIDIA 市佔率現況

根據 Mizuho Securities 與 Morgan Stanley 分析,NVIDIA 在 AI 加速器市場佔有率介於 80% 至 95%。2025 年資料中心業務單季營收達 512 億美元,年增 56%,毛利率維持 75% 以上。根據 Morgan Stanley 預測,NVIDIA 在 2025 年 AI 晶片製造所消耗的晶圓佔全球 77%,高於 2024 年的 51%。

競爭者動態

AMD MI300 系列持續爭取超大規模客戶,預計 2028 年資料中心營收可達 610 億美元。Google TPU v7 Ironwood 與 Amazon Trainium 則瞄準自家雲端服務的推論需求。但分析師指出,即使 NVIDIA 市佔率減半,其年營收仍可達 1 兆美元——這是 AMD 或 Broadcom 難以企及的規模。

競爭者面臨的核心挑戰在於 CUDA 生態系統。超過 400 萬開發者、3,000 款最佳化應用程式與主流 AI 框架的深度整合,構成難以逾越的轉換成本。黃仁勳在問答環節表示:「我們的晶片本質上就是 ASIC,只是由 NVIDIA 設計、在台積電代工。」

產業影響評估

資料中心投資趨勢

NVIDIA 估計全球資料中心資本支出將以年複合成長率 40% 成長,2030 年達到 3 至 4 兆美元規模。McKinsey 估計其中 60% 將投入晶片與運算硬體,意味著 AI 硬體市場規模約 2.1 兆美元。

超大規模雲端業者的 2025 年 AI 基礎建設支出已超過 3,800 億美元。Microsoft 單獨投入 800 億美元,Meta 投入 600 至 650 億美元。Vera Rubin 的推論成本降低十倍的承諾,將直接影響這些資本配置決策。

台灣供應鏈角色

NVIDIA 宣布與鴻海、台積電合作在台灣建立 AI 工廠,並在北投士林設立新辦公大樓。台積電的 CoWoS 先進封裝產能已被 NVIDIA 鎖定 60%,是 Vera Rubin 得以如期量產的關鍵。

權威來源引用

- 物理 AI:下一波人工智慧浪潮 - Physical AI: The Next Wave of Artificial Intelligence | IEEE Spectrum

- 台積電技術論壇:先進封裝與 AI 晶片 - TSMC Technology Symposium: Advanced Packaging and AI Chips | TSMC

- 數位孿生與工業元宇宙:NVIDIA Omniverse - Digital Twins and the Industrial Metaverse: NVIDIA Omniverse | NVIDIA Developer

- NVIDIA 的 AI 工廠願景 - NVIDIA's Vision for AI Factories | Reuters

- Vera Rubin:揭示暗物質的天文學家 - Vera Rubin: The Astronomer Who Revealed Dark Matter | Nature

Tenten 觀點

NVIDIA 的六晶片協同設計策略代表半導體產業的範式轉移。傳統分散式開發模式無法達成的系統層級最佳化,在極致整合架構下成為可能。Alpamayo 的開源策略則複製了 Android 在智慧型手機市場的成功路徑——當核心 AI 軟體成為公共財,硬體供應商的議價能力將大幅提升。

對於企業而言,Vera Rubin 的量產時程(2026 年下半年)意味著現有 Blackwell 部署的投資回收期將被壓縮。建議評估工作負載特性,針對推論密集型應用優先規劃 Rubin 遷移路徑。

Tenten Research Team

若您正在評估企業 AI 基礎設施佈局,或希望了解如何將新一代運算技術整合至業務流程,歡迎預約諮詢,與 Tenten 團隊探討最適合您組織的解決方案。