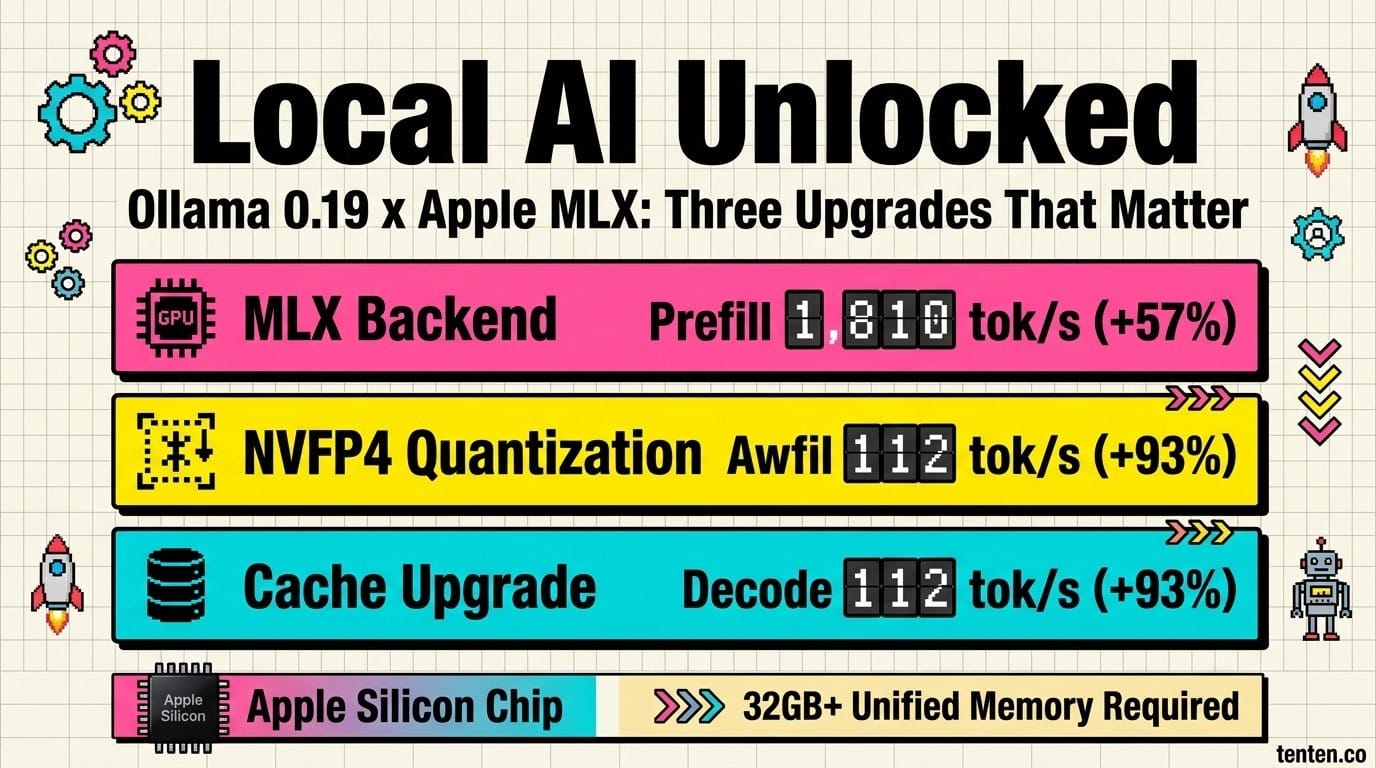

Ollama 0.19 預覽版於 2026 年 3 月 30 日發布,正式將 Apple 的 MLX 機器學習框架作為 Apple Silicon 上的推理後端。 根據官方基準測試,在 M5 Max 晶片上跑 Alibaba Qwen3.5-35B-A3B 模型(NVFP4 量化),prefill 速度從 1,154 token/s 提升到 1,810 token/s,decode 速度從 58 token/s 跳到 112 token/s。Ollama 官方還預告,切換到 int4 量化後可達 1,851 token/s prefill 和 134 token/s decode。對跑 OpenClaw 或 Claude Code 的開發者來說,這意味著本地推理終於從「堪用」進入「實用」階段。

為什麼 MLX 對本地推理很重要

MLX 是 Apple 在 2023 年底開源的陣列運算框架,專門針對 Apple Silicon 的統一記憶體架構設計。傳統 GPU 運算需要在 CPU 記憶體和 GPU VRAM 之間來回搬資料,MLX 直接省掉這一步。CPU 和 GPU 共用同一個記憶體池,資料不用複製就能在不同運算單元之間切換。

Apple 官方研究頁面的說法是:MLX 允許運算在 CPU 或 GPU 上執行,不需要搬移記憶體。這句話聽起來平淡,但對本地 LLM 推理的影響很大。M5 晶片的記憶體頻寬達到 153 GB/s,比 M4 的 120 GB/s 高了 28%。加上 M5 系列新增的 GPU Neural Accelerators(透過 Metal 4 的 TensorOps 支援),矩陣乘法運算有專用硬體加速。

Ollama 之前是基於 llama.cpp 的 GGML 後端。0.19 版在 Apple Silicon 上改用 MLX,等於從通用方案換成了原生方案。根據 2025 年 11 月 ArXiv 上一篇比較研究,MLX 在 Apple Silicon 上的持續生成吞吐量大約 230 token/s,比 llama.cpp 高 20-30%。

實測數據:到底快了多少

Ollama 官方的基準測試在 2026 年 3 月 29 日進行,硬體是 M5 Max,模型是 Qwen3.5-35B-A3B。

| 指標 | Ollama 0.18(Q4_K_M) | Ollama 0.19(NVFP4) | 提升幅度 |

|---|---|---|---|

| Prefill 速度 | 1,154 token/s | 1,810 token/s | +57% |

| Decode 速度 | 58 token/s | 112 token/s | +93% |

| Prefill(int4,預告值) | — | 1,851 token/s | — |

| Decode(int4,預告值) | — | 134 token/s | — |

MacRumors 整理的用語更直觀:prefill 快了約 1.6 倍,decode 接近 2 倍。M5 系列晶片因為有 Neural Accelerators,改善幅度最大。舊款 Apple Silicon(M1 到 M4)也能受益於 MLX 的統一記憶體優化,但幅度沒這麼誇張。

實際使用者的回饋值得參考。一位 MacRumors 論壇使用者在 Mac mini M2 Pro(32GB)上測試,回報模型本身佔了約 20 GB 記憶體,剩下約 12 GB 給 KV cache。短對話沒問題,但長上下文會開始用到 swap。他的結論是:互動式聊天很流暢,但要當 OpenClaw 這類 agentic 框架的後端,32 GB 還是吃緊。

NVFP4:NVIDIA 的量化格式為什麼跑到 Mac 上了

NVFP4 是 NVIDIA 開發的 4-bit 浮點量化格式,原本用在 NVIDIA GPU 的推理場景。Ollama 0.19 把它帶進了 Apple Silicon。

這背後有個商業邏輯:越來越多雲端推理服務用 NVFP4 格式部署模型。如果本地跑的也是同一種量化格式,輸出結果就能跟生產環境保持一致。對開發者來說,這代表本地測試和雲端部署的行為差異會更小。

跟 Ollama 之前用的 Q4_K_M(GGML 格式)比,NVFP4 在精度上稍有優勢,記憶體佔用也更低。但要注意的是,這個預覽版目前只支援 Qwen3.5-35B-A3B 一個模型。Ollama 團隊表示正在擴充支援的模型架構。

快取機制升級:agentic 場景的關鍵

0.19 版的快取改進對 Claude Code 這類編碼代理影響特別大。改了三件事:

跨對話快取複用。以前每次新對話都要重新載入,現在共用系統 prompt 的對話可以複用快取。Claude Code 和 OpenClaw 都大量使用系統 prompt 加上工具定義,這塊的效率提升很明顯。

智慧檢查點。Ollama 會在 prompt 的關鍵位置存快取快照,減少重複的 prompt 處理。對多輪工具呼叫的場景,省下的時間很可觀。

更聰明的清除策略。舊的對話分支被丟棄時,共用前綴可以活更久。這對 Claude Code 這種經常分支的工作流特別有用。

硬體門檻:32 GB 是起步線

Ollama 官方明確要求 32 GB 以上的統一記憶體。這個門檻把入門款 MacBook Air(8 GB 或 16 GB)排除在外。

根據 byteiota 的分析,不同記憶體配置能跑的模型範圍大致如下:

| 統一記憶體 | 可跑模型 | 備註 |

|---|---|---|

| 16 GB | 8B(BF16)或 14B(int4) | 可跑小模型,但不支援本次主打的 Qwen3.5-35B |

| 24 GB | 14B(BF16)或 30B MoE(量化) | M5 MacBook Pro 基礎配置 |

| 32 GB | 34B 模型(量化) | 勉強夠用,長上下文會進 swap |

| 36 GB+ | 34B(舒適運行) | M5 Pro 配置 |

| 64 GB+ | 70B 模型 | M5 Max 配置 |

換算成購買成本,32 GB 的 MacBook Pro M5 在台灣售價約 NTD 65,000 起跳。如果要 64 GB 的 M5 Max,至少 NTD 120,000 以上。跟租用雲端 GPU(A100 每小時約 USD 2-3,約 NTD 64-96)比,要跑到幾百小時以上才能回本。但雲端有 API 限速和隱私顧慮,本地推理的吸引力不只在成本。

OpenClaw 和 Claude Code:本地推理的兩大應用場景

Ollama 官方特別點名兩類應用:個人助理(OpenClaw)和編碼代理(Claude Code、OpenCode、Codex)。

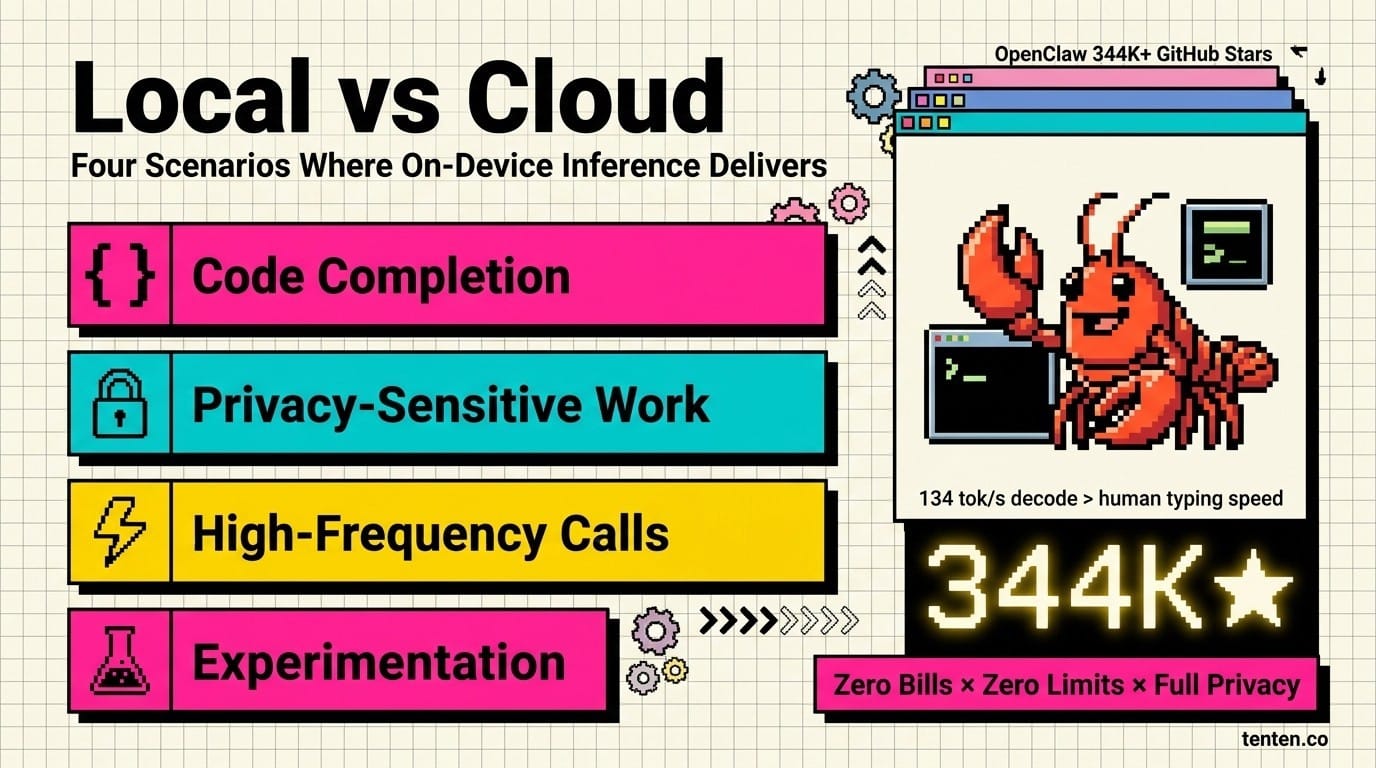

OpenClaw 是 2026 年初爆紅的開源 AI 代理,由前 PSPDFKit 創辦人 Peter Steinberger 開發。截至 2026 年 3 月底,GitHub 星數超過 344,000,是史上成長最快的開源專案之一。它的核心功能是透過 WhatsApp、Telegram、Slack 等聊天平台下達指令,讓 AI 代理在本地機器上執行實際任務(跑 shell 指令、控制瀏覽器、管理檔案)。

OpenClaw 透過 Ollama 整合本地模型,讓使用者可以用開源模型取代 Claude 或 GPT 的 API。Ollama 0.19 的速度提升,直接讓 OpenClaw 的回應時間縮短。但根據前面提到的 32 GB 使用者回饋,agentic 場景(多輪工具呼叫、長上下文)的記憶體壓力仍然是瓶頸。

Claude Code 是 Anthropic 的 AI 編碼代理,主要透過 API 運作。但部分工作流允許用本地模型做輔助推理或快速補全。Ollama 的 ollama launch claude 指令就是為這個場景設計的。

跟雲端推理比,本地到底差多遠

直說了:差距還是很大,但在特定場景下已經夠用。

GPT-4o 或 Claude Opus 的回應速度和品質,靠消費級硬體沒辦法追上。這些是超過一兆參數的模型,跑在幾千張 GPU 上。本地跑的 Qwen3.5-35B-A3B 是 35B 參數、3B 活躍參數的 MoE 模型,複雜推理能力差了一個量級。

但對幾種場景來說,本地推理已經實用了:

程式碼補全和簡單重構。不需要頂級推理能力,速度和低延遲更重要。134 token/s 的 decode 速度已經比打字快得多。

隱私敏感的工作。內部程式碼、客戶資料、財務文件不想上傳到雲端。本地推理是唯一選項。

高頻呼叫場景。Claude Code MAX 方案月費 USD 200(約 NTD 6,400),重度使用者一天可能燒掉 USD 10-20 的 API 費用。本地跑不用擔心用量限制和帳單。

實驗和微調。試不同模型、不同 prompt 策略,雲端 API 的延遲和費用都是阻力。

這次更新的限制

先潑冷水。0.19 是預覽版(preview),目前只加速 Qwen3.5-35B-A3B 一個模型。想跑 Llama、DeepSeek 或其他模型的話,MLX 加速還沒到位。Ollama 說正在擴充支援的架構,但沒給時間表。正式版預計 2026 年 Q2 推出。

32 GB 的硬體門檻把大量 Mac 使用者擋在外面。根據 Apple 的銷售數據,出貨量最大的 MacBook Air 和 MacBook Pro 基礎款都是 8 GB 或 16 GB。要受惠於這次更新,至少得升級到 32 GB 版本。

模型能力上限也不能忽略。35B 參數的 MoE 模型,跟雲端的頂級模型有明顯差距。把它當「取代 Claude 或 GPT」來用,很快就會碰壁。定位應該是「特定場景的本地替代方案」。

MacRumors 討論區有使用者講得很直白:100B 以下參數的本地模型,玩一陣子就會覺得不夠用。模型越大越好,但記憶體和頻寬才是瓶頸。不過這是針對通用對話場景的評價。對程式碼補全和特定任務,35B MoE 模型的表現其實夠用了。

Ollama 0.19 需要什麼硬體才能跑?

最低需求是 Apple Silicon Mac(M1 或更新),32 GB 以上的統一記憶體。M5 系列晶片效果最好,因為有 GPU Neural Accelerators 加速。16 GB 的 Mac 可以跑較小的模型(8B-14B),但跑不了本次主打的 Qwen3.5-35B-A3B。

MLX 跟 llama.cpp 有什麼差別?

llama.cpp 是跨平台的 LLM 推理方案,MLX 是 Apple 專門為 Apple Silicon 設計的框架。MLX 利用統一記憶體架構省掉 CPU-GPU 資料搬移,在 Apple Silicon 上的持續吞吐量比 llama.cpp 高 20-30%。Ollama 0.19 在 Mac 上改用 MLX 後端,其他平台仍用 llama.cpp。

NVFP4 量化格式的精度損失大嗎?

NVFP4 是 NVIDIA 設計的 4-bit 浮點格式,目標是在大幅降低記憶體佔用的同時維持接近原始精度。跟 Ollama 之前用的 Q4_K_M 格式相比,NVFP4 在精度保持上稍有優勢。更重要的是,NVFP4 跟雲端推理服務用的是同一個格式,本地和雲端的輸出結果一致性更高。

OpenClaw 搭配 Ollama 0.19 實際跑起來如何?

短對話場景下回應速度明顯改善。但 32 GB 記憶體配置下,OpenClaw 的 agentic 任務(多輪工具呼叫、長上下文)會快速消耗 KV cache,容易碰到記憶體上限。64 GB 以上配置會舒適得多。

這次更新值得為了它升級 Mac 嗎?

如果你目前的 Mac 是 16 GB 以下,單純為了跑本地 AI 升級可能不划算。如果本來就要換機,選 32 GB 以上的配置可以同時享受這個福利。已經有 32 GB+ Mac 的開發者,裝 Ollama 0.19 預覽版試試看是零成本的事。

來源

關於作者

Ollama 0.19 的 MLX 整合我們第一天就裝了,實際跑在 Mac Studio M5 Max(128 GB)上,給 OpenClaw 當後端。初步觀察是:日常任務的回應確實快了不少,但碰到需要長上下文的代碼審查任務,記憶體管理還是會遇到瓶頸。我的判斷是,這次更新把本地推理從「實驗品」推進到「輔助工具」的階段,但要完全取代雲端 API 還需要兩三代硬體的迭代。

如果你也在評估本地 AI 推理的導入策略,或是想了解 OpenClaw、Claude Code 在企業場景怎麼搭配使用,歡迎跟 Tenten 團隊預約諮詢。