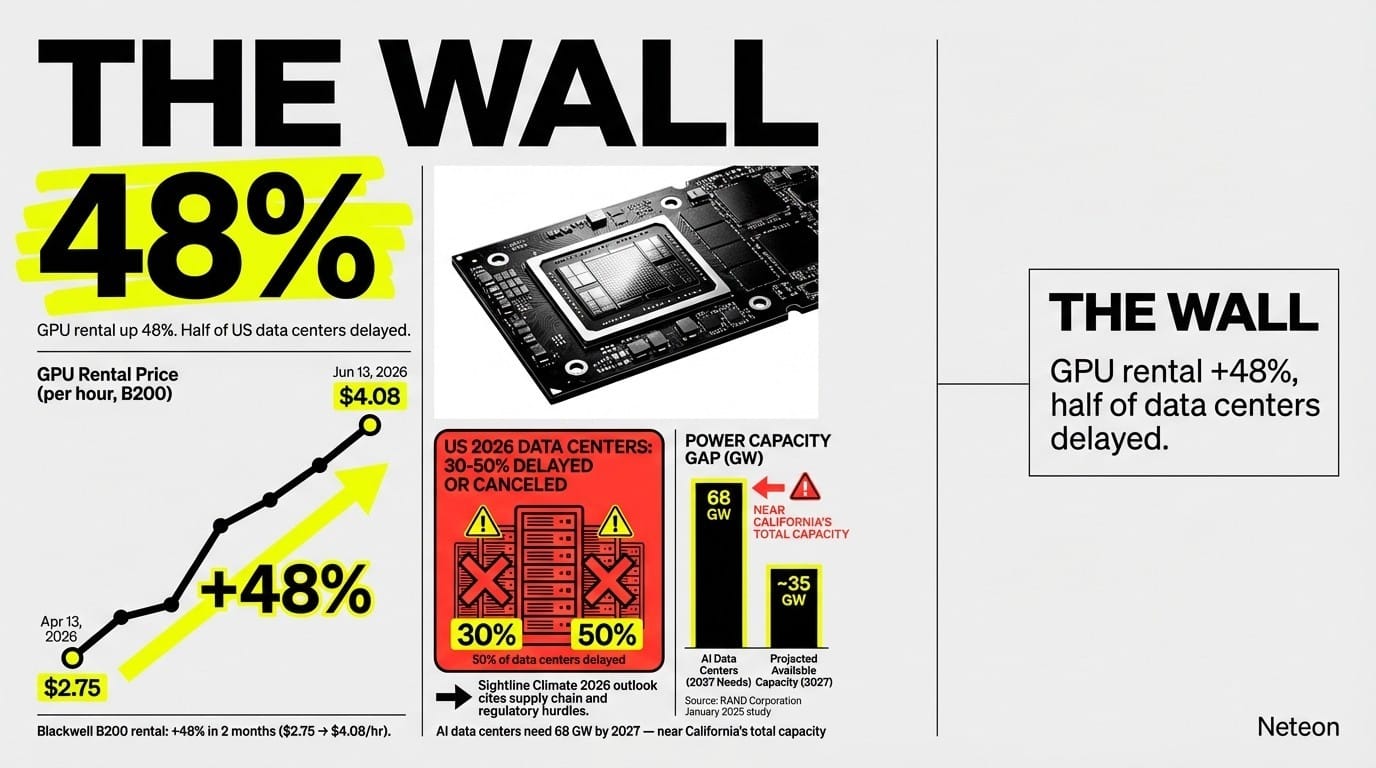

AI 算力短缺已經從理論警告變成營運現實。 2026 年 4 月,Ornn Compute Price Index 資料顯示,NVIDIA Blackwell 系列 GPU 的雲端租金在兩個月內從每小時 USD 2.75 漲到 USD 4.08,漲幅 48%。OpenAI 在 3 月 24 日關閉了 Sora 影片生成 App 來釋放 GPU 資源,Anthropic 則開始在尖峰時段壓縮 Claude 訂閱用戶的使用配額。三件事加在一起,畫面很清楚:AI 產業的需求成長速度已經超過基礎設施的擴建能力。

這篇文章拆解這場危機的四個層面:需求端暴增的數字、供給端的物理限制、各家公司的應對策略差異,以及對企業和開發者的實際影響。

需求端:API 用量翻倍,Agent 工作流程吃掉更多算力

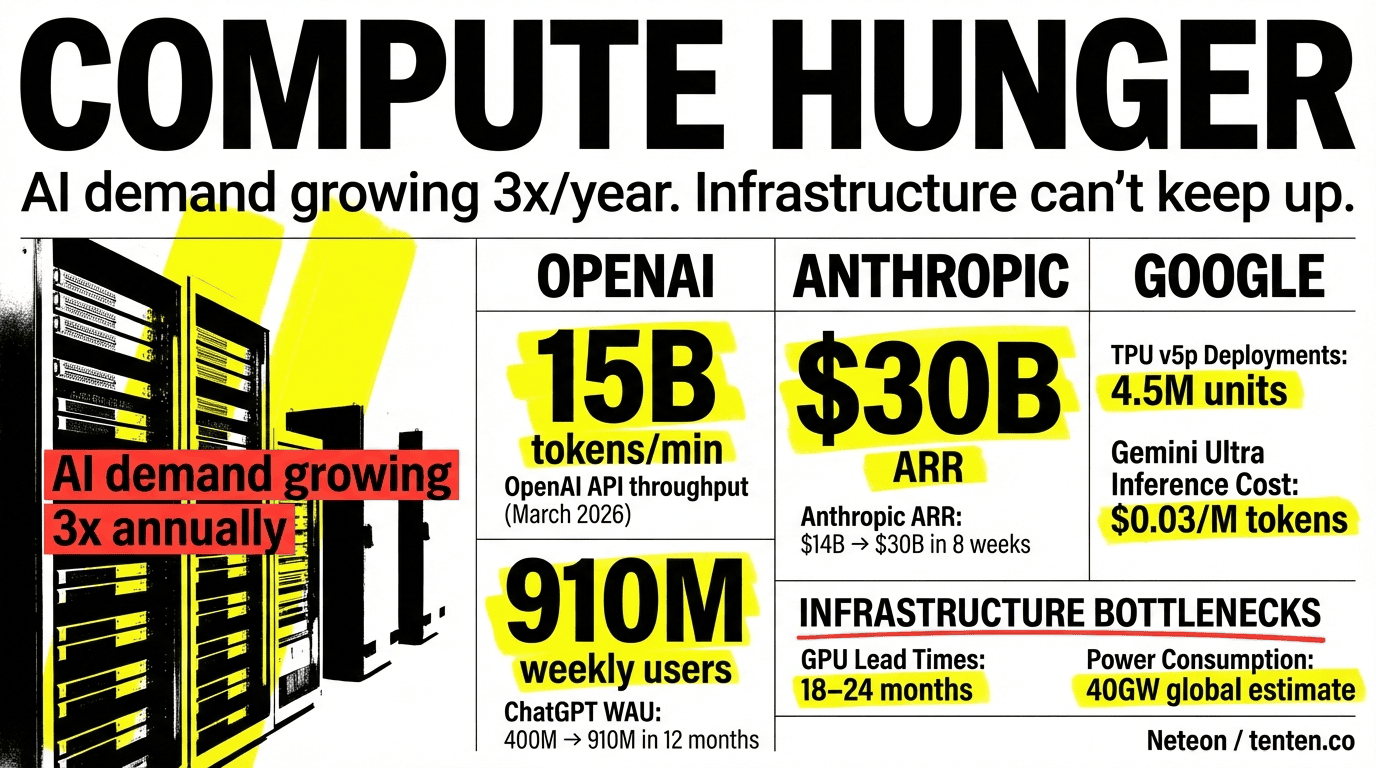

OpenAI 自己的數據最能說明問題。根據 2026 年 4 月公開的投資說明書,公司的 API 吞吐量在 2026 年 3 月達到每分鐘 150 億 token,推理 token 的年增幅達到 320 倍。ChatGPT 週活躍用戶從 2025 年 2 月的 4 億成長到 2026 年 3 月的 9.1 億,付費企業用戶超過 900 萬。推論成本從 2025 年的 USD 84 億預計上升到 2026 年的 USD 141 億。

Anthropic 的成長更誇張。年化營收在 2026 年 3 月衝到 USD 190 億,SaaStr 的分析指出 Anthropic 的營收在 8 週內從 USD 140 億跳到 USD 300 億。Claude Code 從 2025 年 5 月公開發布到 2026 年 2 月,年化營收就達到 USD 25 億,而且還在加速。Meritech Capital 分析師 Alex Clayton 研究了超過 200 家軟體公司的 IPO 軌跡後指出,他從未見過這種成長速度。

用量暴增的驅動力不是更多人打字聊天。是 AI Agent。Agent 工作流程跟傳統聊天介面的算力消耗完全不同等級。一次 Claude Code 的對話不是單一 prompt 加單一回應,而是多輪互動,包含系統提示、累積的對話紀錄、被拉進上下文的檔案內容、以及工具呼叫產生的 token。一個中型程式碼庫的重構任務,單次請求的 input token 就可能打到 TPM(每分鐘 token)上限。OpenAI 的 Codex 在三個月內週活躍用戶成長 5 倍,月增率 70%。這些 Agent 工具每一次執行都在消耗數倍於普通對話的 GPU 時間。

供給端:蓋不夠快的資料中心,買不到的電

需求端的數字再驚人,如果供給能跟上就不會是危機。問題出在供給端受到物理限制。

Sightline Climate 的 2026 年資料中心展望報告指出,美國 2026 年原定上線的資料中心容量約 16 GW,但預計有 30%–50% 會延遲或取消。原因分三類:電力基礎設施不足(25% 的專案甚至還沒公布供電方案)、社區反對,以及電網設備短缺。實際動工的只有約 5 GW。

數字放到更大的框架裡看更嚴重。RAND Corporation 2025 年 1 月的研究估算,全球 AI 資料中心到 2027 年需要 68 GW 的電力容量,接近加州 2022 年的總電力容量 86 GW。Gartner 預測到 2027 年,40% 的 AI 資料中心會因為電力供應不足而受到營運限制。IEA 預估資料中心在 2026 年的耗電量會達到 1,000 TWh,相當於日本全國的用電量。

四大雲端巨頭(Alphabet、Amazon、Meta、Microsoft)2026 年的資本支出預計超過 USD 6,500 億,但錢花不出去。變壓器、配電盤、電池這些電力基礎設施的零組件,交期拉長到 18–36 個月。電網本身還要同時應付電動車和電氣化暖氣系統的負載增長。Tom's Hardware 4 月初的報導直接點名:「AI 建設潮把斷路器跳掉了。」

OpenAI 在投資說明書裡也承認這個現實:公司的算力從 2023 年的 0.2 GW 成長到 2024 年的 0.6 GW 再到 2025 年的約 1.9 GW,每年 3 倍。營收跟著同樣的曲線走。但文件裡也寫了一句值得注意的話:「有時候產能跑在用量前面,有時候用量跑在產能前面。」2026 年 Q1 的狀況明顯是後者。

GPU 租金的價格訊號:Blackwell 漲 48%,H100 也在漲

NVIDIA Blackwell B200 GPU 的雲端租金價格是整場危機最直接的溫度計。

| 指標 | 數據 |

|---|---|

| B200 平均雲端租金(2026 年 4 月) | USD 4.75/hr(約 NTD 152/hr) |

| B200 租金最低價(36 個月預留) | USD 2.25/hr(約 NTD 72/hr) |

| Blackwell 租金指數(SDB200RT)3 月漲幅 | +24%,3 月 25 日峰值達 6.11 |

| Ornn 指數兩個月漲幅 | +48%(USD 2.75 → USD 4.08) |

| B200 單顆製造成本(Epoch AI 估算) | 約 USD 6,400(約 NTD 205,000) |

| B200 售價 | USD 35,000–40,000(約 NTD 1,120,000–1,280,000) |

| NVIDIA 毛利率 | 84% |

| 雲端供應商數量 | 22 家以上 |

Silicon Data 追蹤的 B200 租金指數在 3 月單月漲了 24%。Ornn 的資料顯示從 2 月到 4 月漲了 48%。漲價的直接原因是 agentic AI 的需求:Agent 系統執行時間更長、產生更多工具呼叫、迭代次數更多,每個使用者消耗的 GPU 時數倍增。H100 的租金也在回漲,Silicon Data 記錄到 4 週內漲了 10%。

Epoch AI 的分析進一步拆解了 B200 的成本結構:192 GB HBM3E 記憶體(單價 USD 14–17/GB)和先進封裝佔了製造成本的三分之二。NVIDIA 即使在製造成本比 H100 高 93% 的情況下,仍然維持 84% 的毛利率。這代表 GPU 短期內不會降價,因為 NVIDIA 沒有降價的經濟壓力。

三家公司,三種應對策略

同一場危機,OpenAI、Anthropic 和 Google 的反應截然不同,反映的是各自商業模式和產品組合的差異。

OpenAI:砍產品線、集中算力

OpenAI 在 2026 年 3 月 24 日關閉 Sora,理由直白:影片生成的算力消耗遠超營收貢獻。根據 TechCrunch 引用的 Wall Street Journal 調查,Sora 的全球用戶從高峰的 100 萬跌到不足 50 萬,但每天的推論成本約 USD 100 萬。更精確的估算來自 Forbes:每 10 秒影片的生成成本約 USD 1.30,尖峰時段換算成年化成本達 USD 54 億,而 Sora 的終身營收只有約 USD 210 萬。

Sora 被砍的同時,Disney 一筆 USD 10 億的合作案也跟著泡湯。Disney 在公告前不到一小時才被通知。OpenAI 應用執行長 Fidji Simo 告訴員工,公司「不能再負擔支線任務」。空出來的算力被重新導向 ChatGPT Enterprise、API 服務和編碼工具。OpenAI 在 2026 年 4 月的月營收已經突破 USD 20 億,年化約 USD 240 億,企業營收佔比超過 40%。

Anthropic:壓縮尖峰時段配額

Anthropic 的處境不同:它沒有低效的產品線可以砍,因為營收高度集中在企業 API 和 Claude 訂閱。2026 年 3 月 QuitGPT 運動期間,大量用戶從 ChatGPT 轉向 Claude,Claude 在美國 App Store 首次登頂,網站流量月增超過 30%。用戶暴增直接撞上有限的 GPU 基礎設施。

Anthropic 技術團隊成員 Thariq Shihipar 在 3 月 26 日公開宣布:週一到週五的 5am–11am PT 時段,5 小時 session 配額的消耗速度會加快。他估計約 7% 的用戶會受影響。InfoWorld 引述分析師 Pareekh Jain 的話說,企業用戶通常透過 API 存取而不受影響,但企業內部的進階用戶在做實驗和概念驗證時也會碰到限制。

同時期還有一個技術問題加劇了用戶的痛感:Claude Code v2.1.69(約 3 月 4 日發布)有 prompt caching 的 bug,把正常 97%–99% 的快取命中率壓到只剩 4.3%,單則訊息的成本從 USD 0.02 跳到 USD 0.35。這個 bug 橫跨了約 20 個版本、持續 28 天才開始修復。同一個月 Claude 平台發生了 5 次重大中斷。一位 Max 20x 用戶(月費 USD 200)報告他的配額在約 90 分鐘內就耗盡。

Google:用自家晶片吸收壓力

Google 在這場危機中相對安靜,原因是它的 TPU(Tensor Processing Unit)自主供應鏈提供了緩衝。Gemini 的服務雖然也有零星的配額抱怨,但沒有出現 Claude 或 ChatGPT 等級的公開危機。Google 的 2026 年資本支出也在 USD 600 億以上,但它同時在擴建自有晶片產能和購買 NVIDIA GPU。這個雙軌策略讓 Google 的算力供給不完全受制於 NVIDIA 的交期。

對企業和開發者的實際影響

這場算力危機不是科技新聞裡的抽象議題,而是直接影響成本和生產力的營運問題。

首先是成本。B200 租金 48% 的漲幅直接轉嫁到使用 AI Agent 的企業。一個中型開發團隊如果每天用 8 小時的 B200 實例,月成本從 USD 660 跳到 USD 979(約 NTD 21,000 → NTD 31,000)。更大規模的 AI 訓練任務,成本衝擊更顯著。

其次是可靠性。Claude 的尖峰時段限速和 5 次月度中斷、OpenAI 的 API token 處理量翻倍帶來的延遲,都在影響依賴 AI 服務的工作流程。多家分析師指出,所有主要供應商都在引入或即將引入類似的限制措施,換平台解決不了問題。

第三是策略調整。OpenClaw 這類本地端開源 AI Agent 方案開始受到更多關注,因為它不依賴雲端 GPU。同時,多模型 failover 架構(在一家 API 限速時自動切換到另一家)從可選變成必要。企業也在重新評估哪些工作流程真正需要 Opus 等級的推理能力,哪些可以降級到 Haiku 或 Sonnet 來節省配額。

常見問題

AI 算力危機會持續多久?

分析師預期 2029 年之前供需失衡不會根本改善。Sightline Climate 資料顯示 2027 年已公告的 21.5 GW 資料中心容量中,只有 6.3 GW 實際動工。電力基礎設施的建設週期是 3–5 年,遠長於需求成長的速度。短期內(6–12 個月),B300 晶片進入市場和更多 B200 庫存上線可能緩解租金漲幅,但不會根本解決電力和冷卻的瓶頸。

NVIDIA Blackwell GPU 雲端租金多少錢?

截至 2026 年 4 月,B200 的雲端租金從 USD 2.25/hr(36 個月預留合約)到 USD 16/hr(按需使用),平均約 USD 4.75/hr。Ornn Compute Price Index 追蹤的均價從 2 月的 USD 2.75 漲到 4 月的 USD 4.08,漲幅 48%。預留合約可以鎖定較低價格,但需要長期承諾。

OpenAI 為什麼關閉 Sora?

OpenAI 在 2026 年 3 月 24 日宣布關閉 Sora,App 版 4 月 26 日下線,API 版 9 月 24 日關閉。根據 Wall Street Journal 調查,主要原因是 Sora 的影片生成每天消耗約 USD 100 萬的推論成本,而用戶數已經從高峰的 100 萬跌到不足 50 萬。OpenAI 選擇釋放這些 GPU 資源到營收貢獻更高的企業和開發者產品。

Claude 訂閱用戶的使用限制變了嗎?

是的。Anthropic 在 2026 年 3 月 26 日宣布,週一到週五 5am–11am PT 的尖峰時段,Pro 和 Max 訂閱的 5 小時 session 配額消耗速度會加快。週總配額不變,但尖峰時段的有效使用量減少。約 7% 的用戶受影響。API 計費用戶不受此限制。

企業怎麼應對 AI 算力短缺?

三個方向:一、建立多供應商 failover 機制,在一家 API 限速時自動切換。二、根據任務複雜度分流模型,簡單任務用 Haiku/Sonnet,複雜推理才用 Opus。三、評估本地端方案如 OpenClaw 和自建推論基礎設施,降低對雲端 GPU 的依賴。長期則關注 NVIDIA Rubin 世代和 AMD MI400 系列的價格效能比變化。

引用來源

- Tom's Hardware — Half of planned US data center builds have been delayed or canceled

- TechCrunch — Why OpenAI really shut down Sora

- RAND Corporation — AI's Power Requirements Under Exponential Growth

- InfoWorld — Anthropic throttles Claude subscriptions to meet capacity

Author Insight

我們團隊在過去半年密集使用 Claude Code 和 OpenClaw 做客戶專案的開發和內容自動化,算力限制對日常工作流程的衝擊是第一手體驗。3 月那波限速期間,我們的內容生產管線被迫拆成更小的批次,避開 PT 時區的上午尖峰。同時也開始把部分推論需求分流到本地端的 OpenClaw 實例,用 Llama 4 處理不需要 Opus 級別推理的任務。

從顧問的角度觀察,多數企業客戶對算力危機的認知還停留在「偶爾 API 比較慢」的層次,還沒有把它當作需要架構性因應的長期問題。但 Gartner 預測的 2027 年 40% 資料中心受限和 Sightline 顯示的 50% 專案延遲,代表這件事不會在一兩季內解決。現在開始建立多模型 failover、本地端推論能力和算力預算管理機制的企業,在接下來兩年的競爭中會有明顯優勢。

如果你的團隊正在評估 AI Agent 工作流程的基礎設施策略,或是想了解怎麼在算力受限的環境下維持生產力,歡迎跟 Tenten 團隊預約諮詢。