Anthropic 於 2026 年 3 月 9 日推出 Claude Code Review,一套以多代理架構為核心的程式碼審查系統,目前以 Research Preview 形態開放給 Team 與 Enterprise 方案用���。這套系統直接沿用 Anthropic 內部運作數月的審查流程,在導入前僅 16% 的 Pull Request 獲得實質性審查意見,導入後這個數字躍升至 54%。每次審查平均耗時約 20 分鐘,費用依 token 用量計費,一般介於 USD 15–25(約 NTD 480–800)之間。

AI 寫程式速度暴增,審查成了新瓶頸

Anthropic 工程師的程式碼產出量在過去一年成長了 200%。Claude Code 的年化營收已突破 USD 25 億(約 NTD 800 億),自 2026 年初以來企業訂閱數翻了四倍。Anthropic 產品負責人 Cat Wu 在接受 TechCrunch 採訪時直言,企業客戶每週都在反映同一個問題:Claude Code 大量產出 Pull Request,但審查速度跟不上。

這並非 Anthropic 獨有的困境。根據產業數據,AI 輔助編碼推動 PR 量年增 29%,但人工審查的吞吐量並未同步提升。多數 PR 只獲得「掃描式」閱讀——工程師快速瀏覽 diff 就按下核准,而非逐行深入檢視。結果是 bug 進入生產環境的機率上升,尤其是那些隱藏在一行改動中的邏輯錯誤。

Anthropic 對此的回應分為兩個層級。輕量級方案是既有的 Claude Code GitHub Action,屬於開源工具,適合基礎檢查。Code Review 則是深度方案:更徹底、更昂貴,專為抓出人類審查者容易遺漏的 bug 而設計。

多代理架構:如何運作

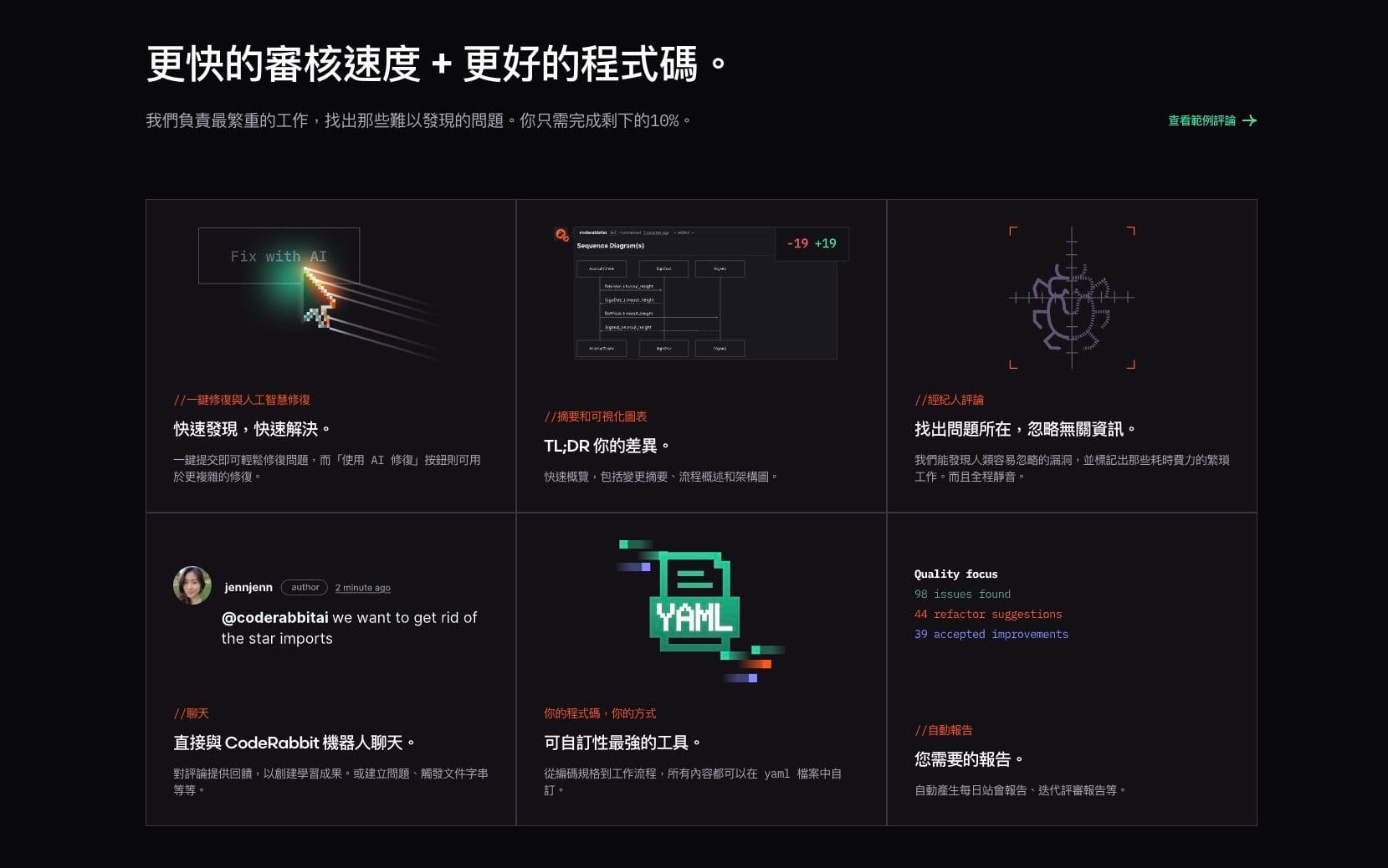

Code Review 的技術架構與傳統的 diff-level 審查工具有根本性差異。當一個 PR 開啟時,系統派出一組專門化的代理團隊,各自負責不同類別的檢查——CLAUDE.md 合規性、bug 偵測、git 歷史脈絡分析、先前 PR 評論回顧、以及程式碼註解驗證。這些代理平行運作,各自產出發現後,再經過一道驗證步驟過濾誤報,最終將結果去重、依嚴重度排序,以行內評論形式標註在 PR 的具體程式碼行上。

這個設計的關鍵在於「全 codebase 脈絡感知」。GitHub Copilot 的 PR Review 功能僅分析 diff 本身,無法察覺新程式碼與既有程式碼庫中其他檔案的模式是否一致。CodeRabbit 雖然提供更深入的 AST 分析,但同樣受限於單一 repository 的範圍。Claude Code Review 的代理則能讀取完整的 codebase,理解既有的架構模式,並在新程式碼偏離這些模式時發出警告。

審查強度會隨 PR 規模動態調整。大型或複雜的變更會分配更多代理進行更深層的分析;瑣碎的修改則接受輕量級檢查。系統不會核准或封鎖 PR,審查結果以建議形式呈現,最終決定權保留在人類手上。

實戰數據:Anthropic 內部與早期客戶

Anthropic 公開了在內部運作數月後的統計數據,這些數字值得仔細解讀:

| PR 規模 | 獲得發現的比例 | 平均問題數 |

|---|---|---|

| 大型 PR(>1,000 行變更) | 84% | 7.5 個 |

| 小型 PR(<50 行變更) | 31% | 0.5 個 |

| 被工程師標記為錯誤的發現 | <1% | — |

不到 1% 的誤判率是一個值得注意的指標。作為對比,一項針對 30 個 PR 的獨立測試顯示,CodeRabbit 的可操作評論率約為 58%,GitHub Copilot 約為 64%,而全 codebase 感知型代理可達 84%。

Anthropic 分享的一個內部案例具有代表性:一行程式碼變更看起來是例行修改,正常情況下會快速通過審查。Code Review 將其標記為「重大」——這行修改會破壞該服務的身份驗證機制,一種在 diff 中容易被忽略但一旦被指出就很明顯的失敗模式。工程師事後承認,如果沒有這套系統,自己不會發現這個問題。

早期客戶 TrueNAS 提供了另一個案例。在一個 ZFS 加密重構的 PR 中,Code Review 在相鄰程式碼中發現了一個既存的 bug:一個型別不匹配問題導致加密金鑰快取在每次同步時被靜默清除。這是潛伏在 PR 觸及的程式碼中的問題,不是 diff 本身的一部分,一般掃描式審查不會主動去挖掘。

費用結構與競品比較

Code Review 的定價模式與市面上主流 AI 程式碼審查工具截然不同。多數工具採用固定月費——GitHub Copilot 包含在 USD 10–39/月的訂閱中,CodeRabbit 約 USD 24–30/月/人。Code Review 則按 token 用量計費,每次審查平均 USD 15–25(約 NTD 480–800),隨 PR 規模與複雜度浮動。

| 工具 | 定價模式 | 單次審查成本(估) | 全 Codebase 感知 | 多 Repo 支援 |

|---|---|---|---|---|

| Claude Code Review | 按 token 計費 | USD 15–25 | ✓ | — |

| GitHub Copilot PR Review | 月訂閱含 | USD 0(含在 $10–39/月) | ✗(僅 diff) | ✗ |

| CodeRabbit | 月訂閱 | USD 0(含在 $24–30/月/人) | 部分(AST 分析) | ✗ |

| Qodo Merge | 客製報價 | 視方案而定 | ✓ | ✓ |

| Cursor BugBot | 含在 Cursor 訂閱 | USD 0(含在訂閱) | ✗ | ✗ |

這意味著一個每月處理 100 個 PR 的團隊,Code Review 的月費可能落在 USD 1,500–2,500(約 NTD 48,000–80,000)。對於年營收規模在數十億以上的企業客戶而言,這個數字相對於一個重大生產事故的成本幾乎可以忽略。但對於中小型團隊,這個定價結構需要與 CodeRabbit 或 Copilot 的固定月費模式仔細比較。

管理者可透過月度組織上限、Repository 層級控制、以及分析儀表板來管控成本。

資料安全與企業風險考量

Code Review 必然需要讀取企業的專有原始碼來執行分析。Anthropic 發言人明確表示,Anthropic 不會使用客戶資料來訓練模型,並引用 Novo Nordisk 與 Intuit 等高度監管產業客戶作為信任佐證。

需要注意的限制:啟用 Zero Data Retention(零資料保留)的組織無法使用 Code Review。這個限制對於處理高度敏感原始碼的金融或國防相關企業可能構成障礙。系統目前僅支援 GitHub 整合,使用 GitLab 或 Bitbucket 的團隊暫時無法採用。

另一個企業買家需要評估的風險來自地緣政治。Code Review 發布的同一天(2026 年 3 月 9 日),Anthropic 對美國國防部提起兩項訴訟,挑戰將其列為「供應鏈風險」的決定。這個供應鏈風險認定不僅影響政府合約——國防承包商需要證明在五角大樓相關工作中未使用 Claude。不過,同一天 Anthropic 的三大雲端分銷夥伴(AWS、Google Cloud、Azure Foundry)同步擴大了與 Anthropic 的合作承諾,市場對 Claude 技術價值與該法律風險持久性的評估顯然偏向樂觀。

導入流程與配置

啟用 Code Review 的步驟相對簡單。管理員在 claude.ai/admin-settings/claude-code 的 Code Review 區段中啟用功能,安裝 Claude GitHub App,並選擇要啟用審查的 Repository。開發者端不需要任何配置——一旦啟用,新 PR 開啟時審查會自動執行。

團隊可透過在 Repository 中加入 CLAUDE.md 或 REVIEW.md 檔案來調整 Claude 的檢查重點。預設情況下,Code Review 聚焦於正確性檢查——會破壞生產環境的 bug,而非格式偏好或測試覆蓋率。透過引導檔案可以擴展檢查範圍。

對於偏好在 PR 開啟前先進行本地審查的團隊,Claude Code 的 /code-review 指令提供了終端機內的審查功能,輸出結果到終端或以 --comment 參數直接發布為 PR 評論。

Claude Code Review 適合哪些團隊?

Code Review 針對的是 Anthropic 的大型企業客戶——Uber、Salesforce、Accenture 等已在使用 Claude Code 的企業。Cat Wu 指出,這些企業的核心痛點是 Claude Code 協助產出的 PR 數量暴增,現有審查流程無法消化。對於團隊規模在 5 人以下、每月 PR 量低於 30 個的小型團隊,GitHub Copilot 或 CodeRabbit 的固定月費方案在成本效益上更為合理。

Code Review 與既有的 Claude Code GitHub Action 有什麼差異?

兩者的定位不同。GitHub Action 是開源的輕量級工具,適合基礎的 CI/CD 流程整合,成本較低。Code Review 是托管服務,派出多代理團隊進行深度審查,具備全 codebase 脈絡感知能力,但每次審查費用在 USD 15–25 之間。兩者可以並存——Action 處理日常基礎檢查,Code Review 用於重要的 PR。

Claude Code Review 能否取代人類程式碼審查者?

不能,Anthropic 在設計上刻意避免這個定位。Code Review 不會核准或封鎖 PR,最終的合併決定仍由人類做出。系統的角色是縮小人類審查者需要關注的範圍——從「每行程式碼都要看」縮減到「針對 Code Review 標記的問題進行深度檢視」。Anthropic 內部的實踐顯示,這個模式將獲得實質性審查意見的 PR 比例從 16% 提升到 54%。

啟用 Zero Data Retention 的組織可以使用嗎?

不可以。目前 Code Review 不支援啟用 Zero Data Retention 的組織。對於處理高度敏感原始碼的企業,這是一個需要與 Anthropic 直接確認資料處理細節的環節。

Code Review 是否支援 GitHub 以外的平台?

截至 2026 年 3 月,Code Review 僅支援 GitHub。使用 GitLab 或 Bitbucket 的團隊如需 AI 程式碼審查,可評估 CodeRabbit(支援 GitHub、GitLab、Bitbucket、Azure DevOps)或 Qodo Merge(同樣支援多平台)。

引用來源

- Anthropic — Bringing Code Review to Claude Code

- TechCrunch — Anthropic launches code review tool to check flood of AI-generated code

- VentureBeat — Anthropic rolls out Code Review for Claude Code

- Claude Code Docs — Code Review

- The New Stack — Anthropic launches a multi-agent code review tool

關於作者

Ewan — Tenten Tech Lead

在過去六個月中,我們團隊協助超過 15 家企業客戶導入 Claude Code 工作流程,涵蓋金融、醫療與電商產業。一個反覆出現的模式是:導入 Claude Code 後的前三個月,團隊的 PR 產出量通常成長 2–3 倍,但審查速度並未同步提升,導致合併延遲與品質風險。Code Review 的推出正好填補了這個缺口。

值得觀察的是 Anthropic 選擇按 token 計費而非固定月費的策略意涵。這個模式讓大型企業能精確控制成本,但也意味著 Anthropic 將審查深度(更多代理、更多 token)與收入直接掛鉤。對企業客戶而言,建議在前兩週密切監控每個 Repository 的審查費用,找出成本效益的甜蜜點。

若您正在評估 Claude Code 或 AI 程式碼審查工具的導入策略,我們近期已為多家企業完成 Claude Code vs. GitHub Copilot 的比較評估與試點規劃。歡迎與 Tenten 團隊預約諮詢,討論最適合您團隊的技術選型。

延伸閱讀: