去年底當我在關注 AI 基礎設施的發展時,一個消息引起了我的注意:某家大型雲端客戶考慮大規模採用 Google 的 TPU 晶片,結果 Nvidia 的股價當天就下跌了 4-7%。這讓我開始深入研究 Google 最新推出的第七代 TPU「Ironwood」,以及它對整個 AI 晶片市場可能帶來的影響。

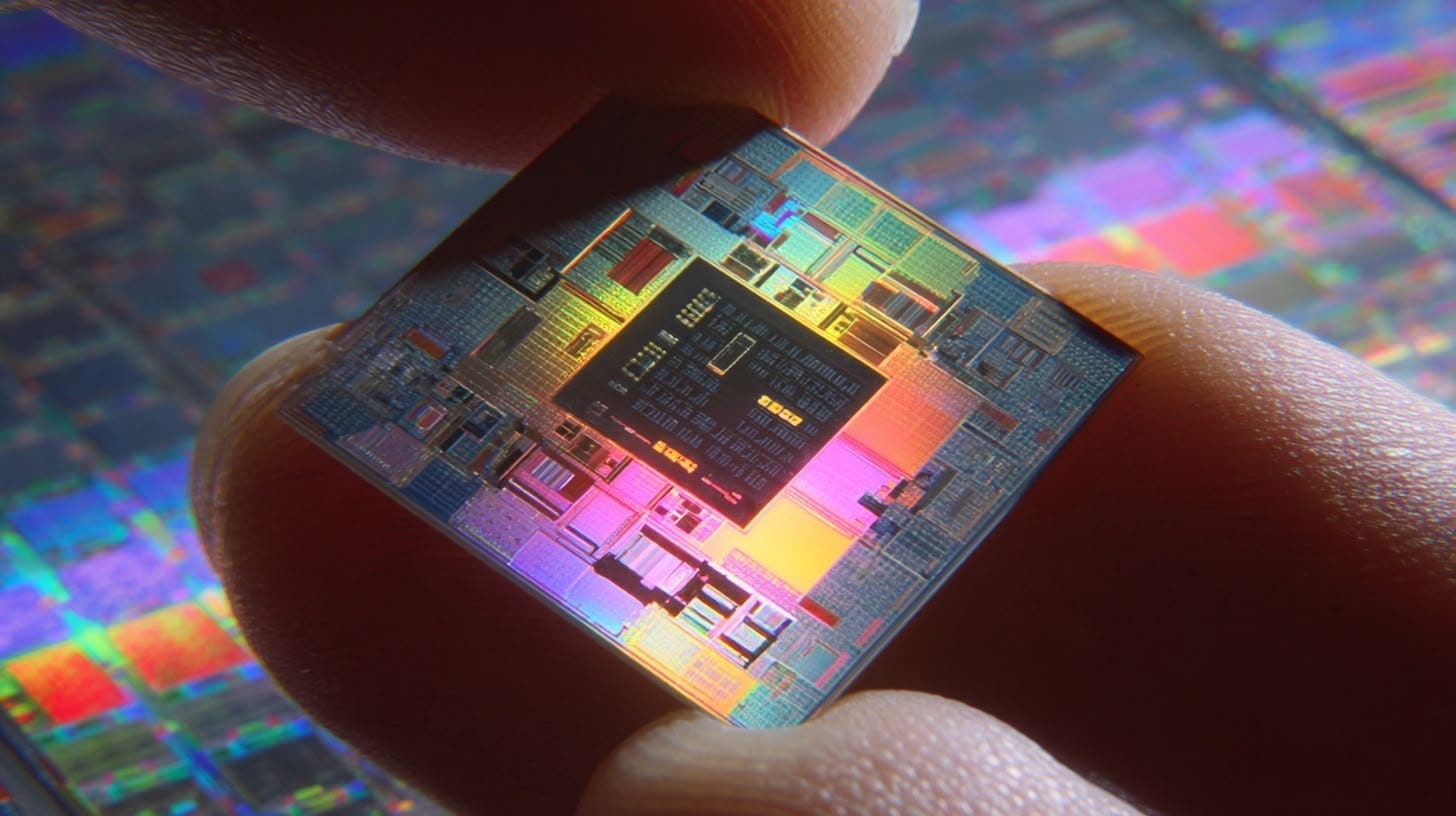

Google 的 TPU v7「Ironwood」是一款專為 AI 推論時代量身打造的第七代張量處理器,單顆晶片提供 4,614 FP8 TFLOPs 的運算能力、192 GB HBM3E 記憶體與 7.38 TB/s 的驚人頻寬。它採用創新的雙晶粒架構設計,可大幅降低延遲並提升擴展性。在 Google Cloud 中,Ironwood 可以擴展至 9,216 顆晶片組成的超大規模 Pod 叢集,專門針對大型語言模型解碼、混合專家模型(MoE)以及高併發推論需求進行優化。

重點摘要

這款晶片最讓我印象深刻的幾個特點:

首先是針對推論場景的極致優化。每顆晶片配備 4,614 FP8 TFLOPs 運算力、192 GB HBM3E 記憶體、7.38 TB/s 頻寬,雙晶粒透過高速 D2D(Die-to-Die)連接,在軟體框架中被視為兩個獨立裝置,這種設計特別有利於高效解碼與任務分工。

其次是驚人的可擴展性。Ironwood Pod 支援 256 或 9,216 顆晶片的配置,最高規格可達 42.5 ExaFLOPS 等級的運算能力,足以承載超大型 LLM 和 MoE 模型的訓練與推論需求。

功耗效率方面的提升更是顯著。相比前一代 Trillium(v6e),Ironwood 的每瓦效能提升約 2 倍,HBM 容量與頻寬都大幅增加(192 GB、7.37 TB/s),晶片間互連(ICI)達到雙向 1.2 TB/s。

在雲端部署方面,目前透過 GKE(Google Kubernetes Engine)使用,TPU7x VM 配置 4 顆晶片,提供 224 vCPU 與 960 GB RAM,並可透過 TPU Cluster Director 進行容量與拓樸管理。

市場影響不容小覷。有報導指出 Ironwood 的性能已經逼近同世代頂級 GPU 的水準,使得推論成本效能比極具競爭力,對現有供應商形成實質壓力。

從股價角度來看,當大型客戶考慮採用 Google TPU 的消息傳出後,Nvidia 股價出現短線回檔,顯示市場對市佔率可能轉移的高度敏感。

Ironwood 的核心規格與創新設計

TPU7x(Ironwood)最大的技術創新在於其雙晶粒架構。每顆晶片內含兩個 TensorCore 與四個 SparseCore,並將每個晶粒視為獨立裝置,透過六倍於單條 ICI 的 D2D 連線降低延遲。這個設計讓我想起最近在研究加速運算時看到的趨勢 —— 專用運算架構正在取代通用處理器。

每顆 Ironwood 配備 192 GB HBM3E 記憶體、7.38 TB/s 頻寬,FP8 峰值運算達 4,614 TFLOPs。ICI 提升至每顆雙向 1.2 TB/s,並支援 3D 網格拓樸,可構成從 64 到數千顆晶片的彈性切片。在雲端產品層面,提供 256 與 9,216 晶片兩種 Pod 規模,分別對應推論與超大規模訓練場景。

| 規格項目 | 詳細數據 |

|---|---|

| 運算能力 | 4,614 FP8 TFLOPs |

| 記憶體 | 192 GB HBM3E |

| 記憶體頻寬 | 7.38 TB/s |

| 晶片間互連 | 雙向 1.2 TB/s |

| Pod 規模 | 256 或 9,216 顆晶片 |

| 最大運算力 | 42.5 ExaFLOPS |

推論場景的實際優勢為何重要

Ironwood 明確鎖定「推論時代」的需求。大幅增加的 HBM 容量與頻寬,配合雙晶粒佈局與更快的 ICI,可以顯著降低資料搬移與解碼延遲。這對於 LLM 解碼密集與 MoE 的高併發服務場景特別重要。推論成本往往是訓練成本的數倍,因為推論需要 24/7 持續運行。Ironwood 升級版的 SparseCore 對大型嵌入與推薦系統更友善,使傳統雲端服務、搜尋與排序類型任務也能受惠於 TPU 加速。

軟體生態與可用性

在 Google Cloud 上,TPU7x 需要透過 GKE 使用,並可搭配 TPU Cluster Director 取得完整容量與拓樸可視性。單個 VM 綁定 4 顆晶片,提供 224 vCPU 與 960 GB RAM 的高規格主機配置,以支援高速資料供給與處理。

軟體層面可透過 Pathways 進行大規模分散式調度。JAX 等框架會將每顆 Ironwood 暴露為兩個裝置,方便模型以最小修改適配雙晶粒設計。Google 表示 Ironwood 將在今年內陸續供應雲端客戶使用。

如果你正在評估不同的推論解決方案,建議參考我們之前撰寫的 RAG 與 Fine-tuning 如何選擇以及 Nvidia NIM 全面指南,可以幫助你更全面地理解推論部署的最佳實務。

Google TPU 生態 vs. Nvidia GPU 生態:一場改變遊戲規則的對決

先講重點:Google 的 AI TPU 生態正在從「自家內用」走向對外開放,主打雲端推論時代的高性價比與垂直整合。Nvidia 則仍是整個 AI GPU 生態的核心,靠 CUDA、豐富框架支援與開發者社群,把「所有雲」和大多數 AI 新創都綁在自家平台上。

華爾街的共識是:TPU 會搶走部分推論與雲端預算、壓縮 Nvidia 定價與毛利,但這是一個「所有人都能賺錢」的超大市場,而不是簡單的零和遊戲。

Google TPU 生態:為推論時代打造的垂直整合

Google TPU 生態的核心,是一條從自家設計的 Tensor Processing Unit 晶片、到 Pathways、JAX、Gemini、再到 Google Cloud 服務的完整垂直堆疊,目標是把自家與客戶的推論成本壓到最低。

第七代「Ironwood」在雲端可一次串到 9,216 顆晶片,主打大語言模型與推薦系統的高併發推論,並宣稱相較前代效能與效率都有數倍提升。從生態角度看,Google TPU 比較像一個「半封閉俱樂部」:你得進到 Google Cloud,才能用到 TPU Pod、GKE 加上 TPU Cluster Director 這一整套工具。

有研究與媒體估算,在標準 9,000 顆晶片的機櫃規模下,TPU 方案的總成本可能比同級 Nvidia GPU 便宜約 2 倍,甚至在特定推論工作上達到 4 倍以上的性價比。這也是為什麼像 Anthropic、部分影像生成服務願意把大量推論搬上 TPU。

想了解更深入的架構與應用差異,推薦閱讀我們的Google TPU 與 GPU 的對決專文。

Nvidia AI GPU 生態:CUDA 王國與完整工具鏈

反過來看 Nvidia 生態,它的真正護城河不是單一顆 GPU,而是從 CUDA、cuDNN、TensorRT、再到 Omniverse、NIM、各種 SDK 與 reference stack 所堆出來的完整工具鏈。幾乎所有主流雲端與 AI 平台都先支援 Nvidia 再談其他。

在硬體路線上,Nvidia 正用 Blackwell 世代(如 GB200、GB300 與 NVL72)試圖把訓練與推論的效能功耗比再推高,同時透過 NVLink 與 NVSwitch 把多 GPU 當成一台「巨型 GPU」來用,對於訓練最新一代 LLM、VLM 仍然是首選平台。

這讓我想起AMD 挑戰 Nvidia 的市場競爭文章中提到的觀點 —— 在這個生態系統的競爭中,軟體護城河往往比硬體規格更重要。

生態差異對照表

| 面向 | Google TPU 生態 | Nvidia GPU 生態 |

|---|---|---|

| 硬體特性 | 針對矩陣運算優化的 ASIC,最新 v7 主打推論與大規模串接 | 通用 GPU,可同時處理訓練、推論與各式 GPGPU 工作 |

| 主要應用場景 | Google Cloud 內的 LLM 推論、推薦系統、搜尋,也能訓練大模型 | 全雲端與本地環境的大多數 AI 訓練與推論、科研與高效能運算 |

| 生態系統與工具 | 深度綁定 Google Cloud、Pathways、JAX,生態相對封閉 | CUDA、廣泛框架支援(PyTorch、TensorFlow 等)、最龐大的開發者社群 |

| 成本效能(推論) | 多份報告指在大量推論下可比同級 GPU 便宜 2-4 倍 | 在訓練與混合工作負載上仍具優勢,推論成本壓力開始出現 |

| 客戶鎖定程度 | 鎖在 Google Cloud 與 TPU 平台,遷移成本較高 | 跨多家雲端供應商,鎖定的是 CUDA 與整個工具生態 |

對 Nvidia 股價的潛在影響

短期來看,當大型買家傳出考慮採用 Google TPU 時,市場已出現情緒與持倉調整,曾令 Nvidia 股價在消息日走弱,顯示資金對雲端推論市佔率變動的高度敏感。

中期影響取決於幾個關鍵因素:Ironwood 的實際性價比與交付節奏、Google 生態(如 Pathways/JAX、雲端整合)的滲透速度,以及開發者對既有 CUDA 軟體堆疊的黏性。

華爾街怎麼看這場競爭

從「股市溫度計」來看,最近幾次有關 TPU 擴張的新聞(例如大型雲端客戶考慮 2027 年起導入 Google TPU、Anthropic 簽約最多可用到百萬級 TPU v7、或是 TPU 標準機櫃成本約為同級 Nvidia GPU 的一半),都曾引發 Nvidia 股價 4-7% 的短線回檔,AMD 也會一併受影響,而 Alphabet 股價則往往同步走強。

主流財經評論認為,即便 TPU 追上硬體指標,Nvidia 仍以完整軟體生態佔優勢,TPU 難以在短期全面取代,但對推論定價與市場結構將形成持續壓力。像美國銀行的分析師就提醒投資人,Nvidia 的 GPU 幾乎出現在每一朵雲、參與了幾乎所有主流 LLM 專案,在「最快上市時間」與「整體效能功耗比」上仍有優勢。

Futurum Group 等研究機構則直接批評「把 GPU vs TPU 看成零和競爭是愚蠢的」,因為 AI 基礎設施市場規模預期會上看數兆美元,足夠容納多家供應商同時獲利。也有多家媒體與研究報告提醒:就算 TPU 真的搶到類似傳聞中「10% Nvidia 年營收」的市佔率,對 Nvidia 長期地位比較像是「降溫與去泡沫」,而不是立刻翻轉霸主地位。

對於想深入了解晶片產業競爭格局的讀者,建議參考:

- 降低 NVIDIA 依賴!全球科技巨頭 AI 晶片發展現況分析 —— 探討各家雲端如何降低對單一供應商的依賴

- Hot Chips 2025:晶片產業七大技術突破深度解析 —— 了解未來幾代 GPU/TPU/ASIC 的技術路線

- Nvidia 投資 10 億美元於 50 家 AI 新創 —— 從投資版圖理解 Nvidia 生態擴張策略

我對這場競爭的個人觀察

從實務角度來看,我認為這不是一場 TPU「取代」GPU 的戰爭,而是 AI 基礎設施市場走向多元化與專業化的必然趨勢。就像我們在協助客戶規劃 AI 基礎設施時常說的:選擇 TPU 還是 GPU,關鍵不在於誰比較「強」,而在於你的工作負載特性、團隊技術棧,以及長期的成本結構規劃。

對於以推論為主的大規模部署,特別是已經深度整合 Google Cloud 生態的團隊,Ironwood 提供了一個極具吸引力的選項。但對於需要靈活性、跨雲端部署,或者有大量訓練需求的團隊,Nvidia 的 GPU 生態系統仍然是更穩妥的選擇。

最讓我興奮的,其實是這種競爭帶來的良性循環 —— 它推動了整個產業在效能、功耗、成本上的快速進步,最終受益的是所有 AI 應用的開發者與使用者。

讓 Tenten 協助你制定 AI 基礎設施策略

在這個 AI 基礎設施快速演進的時代,選擇正確的技術棧和部署策略至關重要。無論你是正在評估 TPU 與 GPU 的取捨,規劃大規模推論系統的架構,還是思考如何在成本與效能間取得最佳平衡,Tenten 的專業團隊都能提供實戰經驗與策略建議。

我們協助過多家企業從概念驗證到生產環境的完整 AI 基礎設施建置,深諳不同晶片架構的優劣勢與適用場景。立即預約諮詢,讓我們一起為你的 AI 專案找到最適合的解決方案。

參考資料

- Google Cloud - Cloud TPU 官方架構與性能 | Google Cloud - Cloud TPU Architecture & Performance

- Nvidia 投資者關係 - 財務與產品路線圖 | Nvidia Investor Relations - Financials & Roadmaps

- SemiAnalysis - 半導體產業深度分析 (Substack) | SemiAnalysis - Deep Dive Semiconductor Analysis