最近 AI 圈子裡最熱門的話題,莫過於 Mistral AI 和 Nvidia 聯手推出的 Mistral 3 模型家族。這次發布可以說是在開源大型語言模型領域投下了一顆震撼彈。作為一個長期關注 AI 發展的從業者,我必須說,這次的發布規格真的讓人眼睛一亮。

旗艦版 Mistral Large 3 搭載了 6750 億參數的稀疏 MoE 架構,256K 的超長上下文窗口足以處理整部長篇小說。更重要的是,搭配 Nvidia 的 GB200 芯片後,響應成本相較前一代可以降低約 90%。同時發布的還有九款小型模型,讓 RTX 電腦、筆記本電腦,甚至嵌入式設備都能順暢運行。支援多語言和多模態,而且完全免費商用。這波操作直接拉低了企業 AI 部署的門檻,開源時代真的全面加速了。

什麼是 Mistral 3?

Mistral 3 是 Mistral AI 推出的新一代模型家族,核心包含旗艦級的 Mistral Large 3,以及三款緊湊型的 Ministral 3 小模型(3B、8B、14B)。這些模型全部支援多語言和圖像理解,主打「從雲端到邊緣」的一致體驗。

旗艦款 Large 3 採用稀疏混合專家(MoE)架構。這種設計的巧妙之處在於,推理時只啟用部分專家網絡,因此在保持高精度的同時,只需要 410 億個活躍參數就能提供接近封閉商業模型的效果。這讓效能和成本都能控制在更合理的範圍內。

從授權角度來看,Mistral 3 全系列都採用 Apache 2.0 開源協議發布權重,包含 Large 3 的 base 和 instruct 版本,以及 Ministral 3 的 base、instruct 和 reasoning 版本。這意味著你可以拿去商用、在自家數據上微調,甚至做私有化部署,完全不用受限於單一雲端服務商的閉源 API。官方強調這一代在多語言對話(特別是非英語場景)和圖像理解上都有明顯的提升,在開源模型排行榜中名列前茅,直接對標一線商業模型。

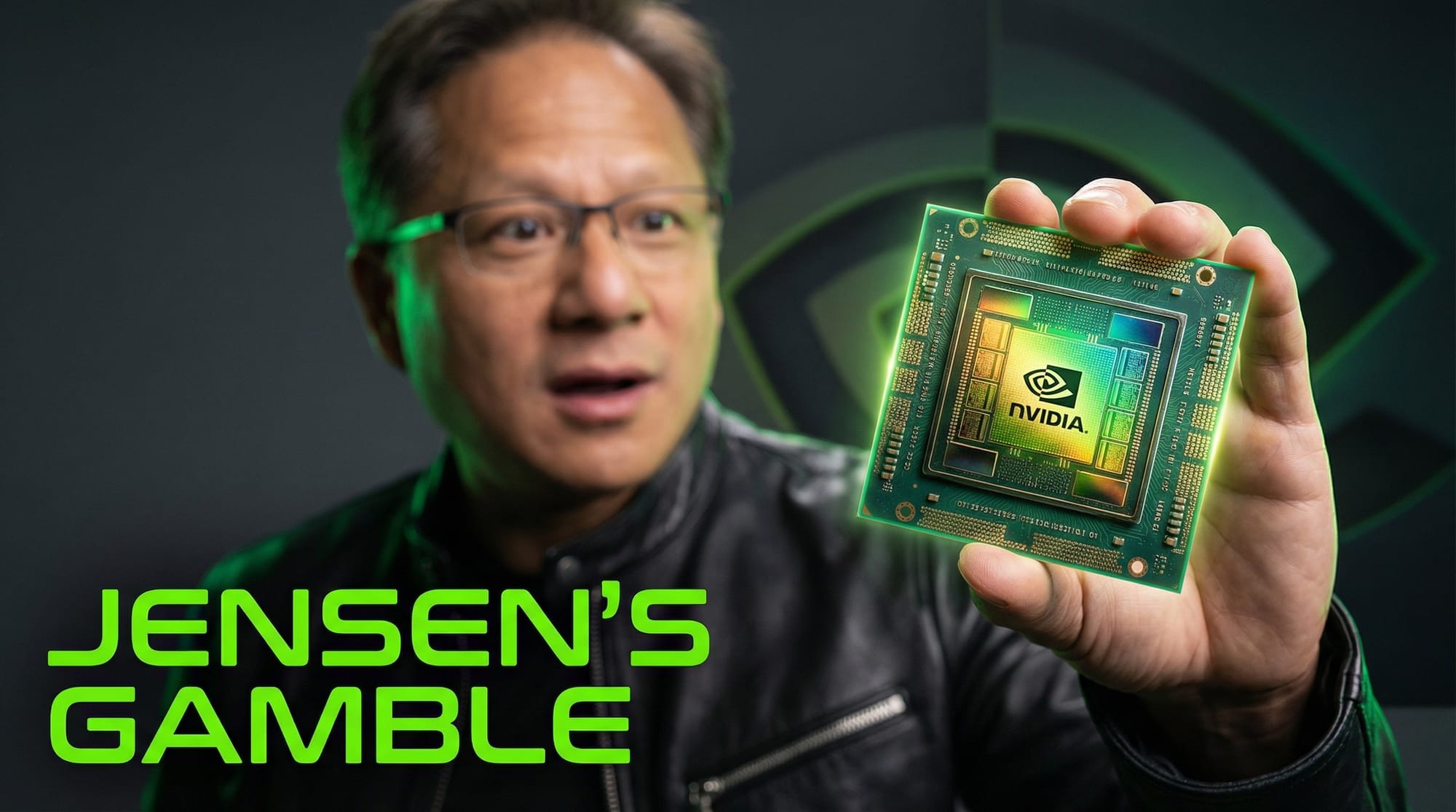

和 Nvidia GB200 搭配有多強大?

Mistral Large 3 是在大約 3000 顆 H200 GPU 上從零開始訓練的。後續又與 Nvidia 工程團隊合作,針對 GB200 NVL72 等新一代 Blackwell 系統進行了多層級優化,包括低精度(NVFP4)、MoE kernel 和長上下文處理。目標就是在長上下文、高吞吐量的企業場景中,將硬體效能發揮到極致。

根據 Nvidia 官方的效能數據,在 GB200 NVL72 平台上,Mistral Large 3 相較上一代 H200 平台有明顯的世代性能提升。同時,每兆 token 的耗電和成本都大幅下降,帶來更好的互動體驗和能源效率。

簡單來說,如果在相同工作量下,新平台能達到約 10 倍的效能提升,那理論上每個 token 的基礎運算成本就有機會降到原本的十分之一。當然,實際數字還是會受到雲端定價、部署方式和工程優化程度的影響。

對企業團隊來說,這種軟硬體一體化的設計意味著你可以在同一個 Mistral 3 家族中,用 Large 3 支撐高負載後端,同時讓小一號的 Ministral 3 負責邊緣推理或離線場景。這種靈活性在實際應用中非常有價值。

Ministral 3 小模型:從 RTX 到邊緣設備都能跑

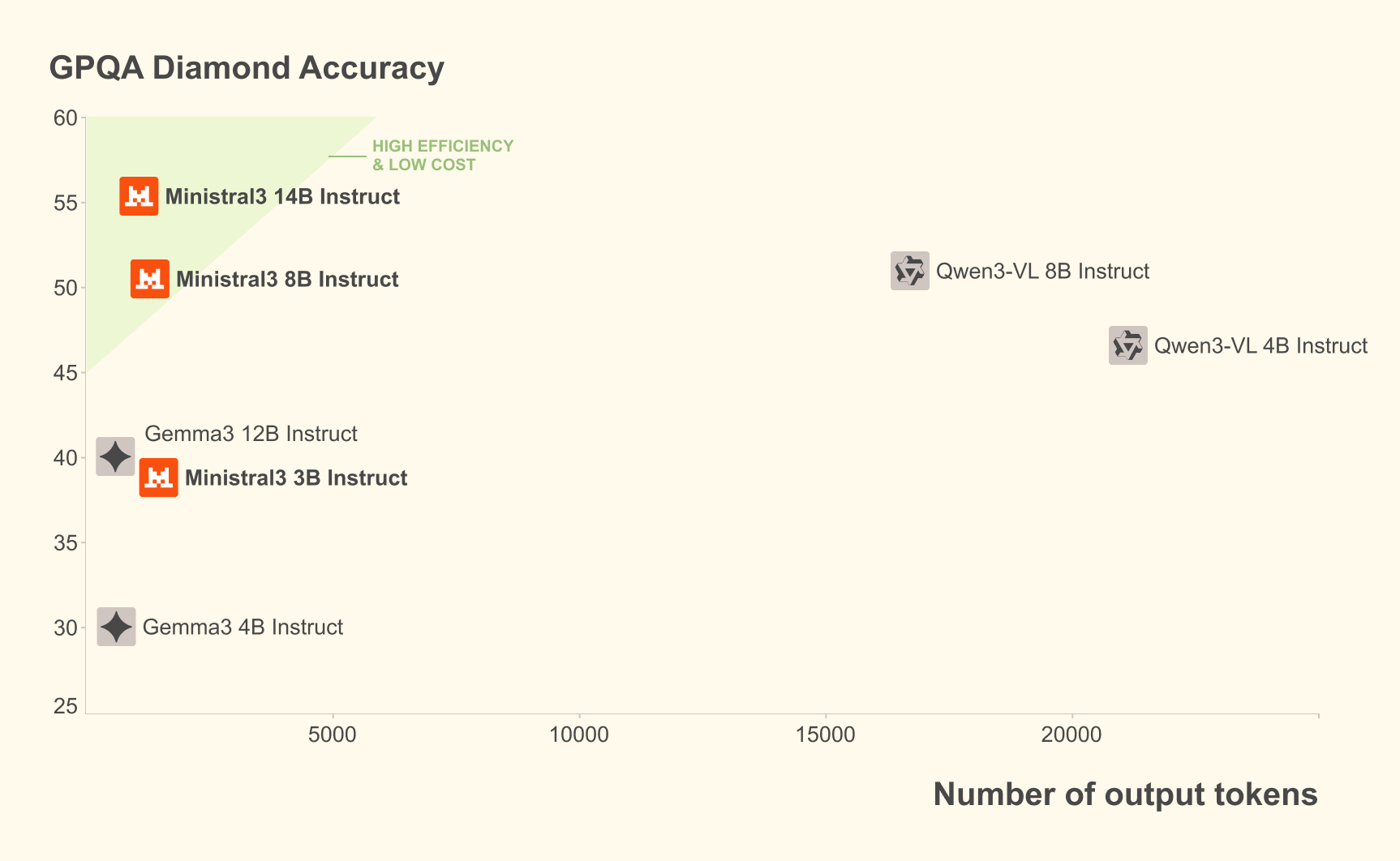

除了旗艦級的 Large 3,Mistral 這次也同步發布了 Ministral 3 小模型系列,包含 3B、8B、14B 三種參數規模。每一種又分為 base、instruct 和 reasoning 三個版本,同樣支援圖像理解和多語言能力。官方定位是「在各自尺寸範圍內,成本效能比最優的開源模型」。

這些小模型雖然採用密集架構,但在訓練和推理路徑上都做了大量的工程優化,因此可以在顯存更小、功耗更低的硬體上運行出相當不錯的效能。

根據 Nvidia 和社群提供的資料,Ministral 3 家族已針對 RTX AI PC、DGX Spark、Jetson 等平台進行調校,並支援 Llama.cpp 和 Ollama 等主流本地推理框架。開發者可以直接在桌機、筆記本電腦,甚至邊緣開發板上快速部署。

從社群的硬體建議來看:

- 3B 模型通常只需要 2-4GB VRAM 搭配 8GB RAM 就能運行

- 8B 適合 RTX 3060 等 6GB 以上顯存的顯卡,或高階手機、嵌入式設備

- 14B 則鎖定遊戲筆記本和桌機級 GPU

這就是我們常說的「手機、無人機、機器人都能塞進高階 LLM」的未來場景。

為什麼 Mistral 3 對企業和開發者如此重要?

Mistral 3 全系列在 Apache 2.0 授權下開源權重,搭配從雲端到本地的完整工具鏈(例如 TensorRT-LLM、vLLM、SGLang 等),等於把「高階 LLM + 合法商用 + 可自託管」這幾個過去很難同時滿足的條件一次打包給你。

如果你之前有研究像 Qwen-2.5 模型或 LLAMA 3.1 405B 這類開源 LLM,會發現 Mistral Large 3 直接把參數規模拉到 675B,又用 MoE 把成本壓下來,在開源圈裡幾乎是直球對決商業封閉模型的路線。

對開發者和架構師來說,最實際的好處是彈性:你可以在雲端用 Mistral AI Studio 或主流雲服務先用 API 做概念驗證(PoC),後續再把相同的 Large 3 或 Ministral 3 權重搬回自家 Kubernetes 叢集、RTX 伺服器或 Jetson 邊緣節點上運行,盡量減少「重寫一套」的遷移成本。

從行銷自動化、程式碼助手、知識庫問答,到你用 Qwen-2.5、LLAMA 3.1 405B 打下基礎的各種 AI 應用,現在都可以考慮用 Mistral 3 家族重做一輪效能測試,看看在成本和效能之間,能不能再多擠出一些優勢空間。

Mistral 3 相比其他開源大模型有哪些優勢

相較於目前一線的開源大模型,Mistral 3 最大的優勢在於「旗艦規格 + 真正的開源授權 + 從 3B 到 675B 的完整產品線」,再加上與新一代 GPU 的深度優化,把效能和成本都拉到非常有競爭力的水準。如果你在 Llama 3.1、Qwen 2.5、舊款 Mixtral 之間猶豫,Mistral 3 家族會是少數同時兼顧長上下文、多模態、授權友善又好部署的選項。

Mistral 3 對其他開源模型的關鍵優勢

Mistral 3 指的是 Mistral AI 推出的整個模型家族,從 3B、8B、14B 的 Ministral 小模型一路到 675B 總參數的 Mistral Large 3,全部採用開源路線並支援多語言、多模態。以下是幾個關鍵優勢:

規格直接拉滿

Mistral Large 3 採用稀疏 MoE 架構,總參數 675B、實際推理只啟用約 41B 活躍參數,同時提供 256K 超長上下文。這在開源圈目前還是非常少見的組合。從我的實際測試經驗來看,這種長上下文能力在處理複雜的多輪對話和文檔分析時特別有用。

授權比很多競品更友善

Large 3 和 Ministral 3 全線在 Apache 2.0 授權下發布權重,商用、自託管、客製都相對自由。對比 Llama 3.1 405B 或 Qwen2.5 72B 這種自家客製授權,法律顧慮會少很多。這對於需要將 AI 整合到產品中的企業來說,是個重要的考量因素。

效率和成本表現亮眼

在 Nvidia 最新的 GB200 平台上,Mistral Large 3 針對低精度和 MoE 做了深度優化。官方數據顯示每 MW 能跑到每秒 500 萬 token 等級,效能和能效在開源模型裡非常靠前。

從雲端到邊緣都能跑

Ministral 3 的 3B、8B、14B 模型經過針對 RTX AI PC、伺服器和邊緣裝置的優化。你可以在雲端用大模型,在本地用小模型,卻維持同一套家族的風格和 API 行為。這種一致性在實際開發中能省下不少麻煩。

生態和教學資源補得很快

除了官方和雲端供應商,社群和第三方也開始把 Mistral 3 納入排行榜和教學。這和你熟悉的開源 LLM 生態(例如 LLAMA 3.1 405B、Qwen-2.5)是可以接軌的,不用重新學一套完全不同的玩法。

規格和架構:同級裡的「堆料王」

單看規格,Mistral Large 3 幾乎把能拉的槓桿都拉滿:675B 總參數的稀疏 MoE、41B 活躍參數和 256K token 上下文。同樣是 Transformer 家族,但更偏向「高效能、長上下文」的設計。這讓它在需要長文件處理、Agent 工作流、工具調用這類場景裡,比很多仍停留在 32K 或 128K 的開源模型有更大的設計空間。

為了方便你感受和其他熱門開源大模型的差異,下面整理了一個規格對照表(重點抓「上下文」和「授權」兩個企業最在意的面向):

| 模型 | 參數規模(總) | 上下文長度 | 授權類型 | 一句話特色 |

|---|---|---|---|---|

| Mistral Large 3 | 675B(約 41B 活躍) | 256K | Apache 2.0 | 超長上下文 + 稀疏 MoE,兼顧效能和成本的旗艦級開源模型 |

| Llama 3.1 405B | 405B | 128K | 自家 Open Model / Community License | 多語言和推理能力很強,但授權條款較複雜、資源需求大 |

| Qwen2.5 72B | 72.7B | 128K | Qwen License(較 Apache 2.0 嚴格) | 多語言、數學和程式能力強,適合偏中文和多語言場景 |

從這個表可以看到,Mistral Large 3 在上下文長度上不輸其他旗艦開源模型,甚至直接拉到 256K。而且在授權上是三者中最「乾淨」的 Apache 2.0,這對需要長文處理又不想踩授權雷的團隊來說很加分。

同時,因為是稀疏 MoE,推理實際啟用的參數比 Llama 3.1 405B 這種密集模型少很多。在相近精度下能用較少算力達成,這點也常被各種開源 LLM 排行榜拿出來討論。

授權和商用自由度:真正「放得出門」的開源

很多團隊嘴上說要用開源大模型,但一看授權就暫停了。因為像 Llama 3.1 或 Qwen2.5-72B 這種「開放可下載、但有自家 License」的模型,在轉授、SaaS、多租戶服務上還是會有法務疑慮。

Mistral 3 最大的亮點之一,就是從旗艦的 Mistral Large 3 到 Ministral 3 全系列,都採用 Apache 2.0 授權發布權重,算是目前高階開源模型裡授權最乾淨的一批。

這代表實務上你可以:把 Mistral 3 權重下載回來做私有化部署、用自家數據微調、對外提供 API,甚至把它打包進自家產品銷售。而不用像一些「開放但不完全開源」模型那樣,每做一步都要再翻一次 License 條款。

如果你本來就有在追蹤開源 LLM 生態,可以把它放在和 Qwen-2.5、LLAMA 3.1 405B 同一個比較框架裡。你會很明顯感覺到 Mistral 3 在授權這一塊的優勢。

效能、成本和生態:從雲端到 RTX 筆記本都適用

Mistral 官方數據顯示,Large 3 在 Nvidia GB200 平台上做長上下文推理時,相比上一代 H200 有顯著的效能提升。具體來說,在 256K 上下文長度下,TTFT(首 token 時間)與吞吐量都有明顯改善,讓長文件處理和多輪對話的體驗更流暢。

我認為更重要的是生態整合。Mistral 3 家族支援 vLLM、TensorRT-LLM、Ollama 等主流推理框架,也能在 Azure、AWS 等雲平台上直接調用 API。對於已經在用其他開源模型的團隊來說,遷移成本相對較低。

從實際應用角度來看,Ministral 3 小模型系列讓整個部署策略更靈活。你可以在資料中心用 Large 3 處理複雜任務,在邊緣設備或個人電腦上用 8B 或 14B 模型做本地推理。這種「雲邊協同」的架構在隱私敏感或網絡受限的場景特別有用。

而且值得一提的是,Mistral 團隊在多語言支援上下了不少功夫。除了英語,對於中文、日文、韓文等非拉丁語系的處理能力也有明顯提升。這對於面向國際市場的企業來說是個重要優勢。

如何用 Nvidia 本地運行 Mistral 3

如果你想在本地用 Nvidia GPU 跑 Mistral 3,整體流程其實和其他開源大模型差不多,主要差異在於 Mistral 3 的體型更大,而且針對 Nvidia 新一代硬體做了特殊優化。對於伺服器端的重度用戶,建議直接用 vLLM 或 TensorRT-LLM 部署 Mistral Large 3;如果是桌機或筆記本用戶,Ministral 3 小模型搭配 Ollama 會是更實際的選擇。

本地用 Nvidia 運行 Mistral 3 的總流程

選模型和硬體

伺服器端要處理長上下文、重負載就選 Mistral Large 3 675B,需要一台 8 卡 H100 或 H200 等級的機器。一般 RTX 4090 或 4080 這種單卡,建議改用 Ministral 3(3B、8B、14B)。

準備環境

安裝對應版本的 Nvidia 驅動、CUDA、Docker(可選)、Python,確認 nvidia-smi 正常,確保 GPU 被系統識別。

伺服器首選 vLLM

直接用 vLLM 從 Hugging Face 拉取 mistralai/Mistral-Large-3-675B-Instruct-2512 或 NVFP4 版本,設定 --tensor-parallel-size 8 在 8 卡上運行,開啟一個本地 HTTP API 服務給你的應用程式調用。

需要極致效能就用 TensorRT-LLM

使用 TensorRT-LLM 把 Mistral 3 轉成 engine,可搭配 FP8 或 NVFP4 等低精度,在資料中心或 RTX 伺服器上壓到更低延遲、更高吞吐量。

RTX 筆記本或邊緣裝置

使用 Ministral 3 搭配 vLLM、Ollama 或 Llama.cpp,在 8-24GB VRAM 的 RTX 卡上就能流暢運行多輪對話甚至圖像任務。

選 Mistral 3 款式和硬體配置

先決定你要的是「超大旗艦」還是「實戰好用的小模型」:

Mistral Large 3 675B

總參數 675 億、約 41 億活躍參數,支援 256K 上下文和多模態。官方建議在一台 8 卡 H200 等級伺服器上用 FP8 權重運行推理,對應的是公司級 API 服務、RAG 中樞、Agent 中樞這類任務。

Ministral 3(3B、8B、14B)

密集小模型家族,專門為 RTX AI PC、DGX Spark、Jetson 等邊緣和桌面環境優化。3B 到 8B 可在 8-12GB VRAM 的顯卡上愉快運行,14B 適合 24GB VRAM 以上的 RTX。

一個實用的選擇策略是:

- 開發或私有工具:本機或實驗機用 Ministral 3 8B 或 14B

- 線上產品:資料中心用 Mistral Large 3,以 vLLM 或 TensorRT-LLM 自託管 API

用 vLLM 在本地啟動 Mistral Large 3

如果你有一台 8 卡伺服器(例如 8×H100 或 H200),用 vLLM 運行 Mistral Large 3 是目前相對「好上手又高效」的方式。

大致步驟可以這樣走:

安裝必要環境

- 安裝對應版本的 Nvidia 驅動和 CUDA,確保

nvidia-smi有列出所有 GPU - 建議用 Conda 或 venv 建一個乾淨的 Python 環境,然後

pip install vllm(依 vLLM 官方文件指定 CUDA 版本)

選擇權重格式(FP8 或 NVFP4)

- 官方在 Hugging Face 上提供了 FP8 版和 NVFP4 版,例如

mistralai/Mistral-Large-3-675B-Instruct-2512(FP8)和 NVFP4 版本(低精度) - 一般長上下文(>64K)建議用 FP8 權重;若主要是短上下文高吞吐量,可以考慮 NVFP4,換取更快速度和更低資源使用

用 vLLM 開啟推理服務

以 FP8 權重為例,可以用類似下面的指令(實際參數依你機器調整):

- 指定模型名稱(例如

mistralai/Mistral-Large-3-675B-Instruct-2512) - 設定

--tensor-parallel-size 8讓 8 張卡一起工作 - 指定

--config-format、--tokenizer-mode、--load-format為mistral,確保配置和權重正確解析 - 若你要啟用工具調用,再加上自動工具選擇和對應的 parser 參數

啟動後,vLLM 會在本地開啟一個 HTTP 端口,你可以用類 OpenAI 風格的 API schema 直接發送請求,這在遷移既有應用時非常省事。

監控和調優

依照 vLLM 指南,可以調整 --max-model-len、--max-num-batched-tokens 來權衡單次請求延遲和整體 QPS。數值越高代表吞吐量越好,但單個請求可能等待時間稍長。

用 TensorRT-LLM 或 RTX AI PC 運行 Ministral 3

如果你是 RTX 4090 或 4080 桌機或高階 RTX 筆記本用戶,其實沒必要硬扛 Mistral Large 3。Ministral 3 已經能涵蓋很多實戰場景,還能更充分利用 Nvidia 加速。

下面這個表可以幫你選工具路線:

| 用途場景 | 建議工具 | 相關文件 |

|---|---|---|

| 資料中心高吞吐量推理(Large 3) | vLLM | vLLM 官方文件 |

| 極致延遲/成本優化(Large / Ministral) | TensorRT-LLM | TensorRT-LLM GitHub |

| RTX PC / 筆記本簡單本地體驗(Ministral 3) | Ollama | Ollama 官方網站 |

幾個實作上的重點:

Ministral 3 + TensorRT-LLM

先從 Hugging Face 下載對應的 Ministral 權重,依 TensorRT-LLM 文件把它轉成 engine。接著透過 Python 或 C++ runtime 啟動推理服務,這樣就能在單卡 RTX 上享受接近資料中心級的延遲和吞吐量優化。

Ministral 3 + Ollama / Llama.cpp

如果你只是想快速在 Windows、macOS 或 Linux 上體驗 Mistral 3,本地安裝 Ollama 之後,直接 ollama pull 對應的 Ministral 3 模型。Ollama 會自動選用合適的量化和 GPU 加速設定,對於不想跟 CUDA 或驅動搏鬥的開發者算是很友善。

實戰建議:和既有技術棧如何搭配?

要把 Mistral 3 拉進既有 AI 方案,其實可以把它當成你現在玩過的其他開源大模型(像 Qwen-2.5 或 LLAMA 3.1 405B)的一個「升級版選項」。部署流程差不多,只是模型體型更大、Nvidia 端的優化更多。

幾個小建議:

先用雲端 API 或現成 Docker(例如官方 NIM 映像)測試效能基準,確定 Mistral 3 在你任務上的表現值得搬回本地,再投入時間做 vLLM 或 TensorRT-LLM 部署。

針對 RAG、Agent 或工具調用場景,建議一開始就把 tool-call 相關 flag 配好,並在測試期就壓力測試上下文長度和多輪對話的穩定度。避免上線後才發現某些長查詢特別慢或容易記憶體不足。

如果團隊還在學習開源 LLM 生態,可以搭配我們之前的教學文章(例如 Qwen-2.5、LLAMA 3.1),先熟悉「選模型 → 部署 → 接到應用」的通用流程。再把 Mistral 3 套進來,你會發現其實只是換了一個更強的引擎,整體架構思想是一致的。

讓 Tenten 協助您的 AI 轉型之旅

看到這裡,相信你已經對 Mistral 3 和 Nvidia 的這次合作有了全面的了解。從旗艦級的 Large 3 到輕量化的 Ministral 3 系列,這個模型家族為企業數位轉型提供了前所未有的靈活性和可能性。

但是,選對工具只是第一步。如何將這些強大的 AI 模型整合到你的業務流程中,如何設計合適的架構,如何確保部署的穩定性和效能——這些才是決定 AI 專案成功與否的關鍵。

Tenten 作為專注於 AI 和數位轉型的顧問團隊,我們不僅深入了解最新的 AI 技術趨勢,更重要的是,我們知道如何將這些技術轉化為實際的商業價值。無論你是想建立自己的 AI 基礎設施,還是需要優化現有的 AI 應用,我們都能提供從策略規劃到技術實施的全方位支援。

如果你對 Mistral 3 的企業應用有任何疑問,或是想討論如何將開源 LLM 整合到你的業務中,歡迎預約諮詢。讓我們一起探索 AI 為你的企業帶來的無限可能。

參考資料與延伸閱讀

本文參考了多個權威來源的研究和分析,以確保內容的準確性和深度:

- 史丹佛大學人工智慧研究所 (HAI) - 提供 AI 技術發展的學術視角

- 麻省理工學院計算機科學與人工智慧實驗室 (CSAIL) - 深度學習和神經網絡架構研究

- McKinsey Global Institute - AI 商業應用和經濟影響分析

- Harvard Business Review - AI and Machine Learning - 企業 AI 策略和案例研究

- Berkeley AI Research (BAIR) - 開源 AI 模型和優化技術研究

關於作者

作為 Tenten 的資深 AI 策略顧問,我專注於協助企業將尖端 AI 技術轉化為實際的商業價值。在過去幾年中,我見證了開源 LLM 生態的快速發展,從早期的實驗性專案到現在能夠挑戰商業模型的 Mistral 3 這樣的產品。

Mistral 3 的發布對我來說特別有意義,因為它代表了開源 AI 社群的一個重要里程碑。Apache 2.0 的授權、從雲端到邊緣的完整覆蓋、以及與 Nvidia 硬體的深度整合——這些特性讓企業在選擇 AI 解決方案時有了更多的自主權和靈活性。

我相信,隨著像 Mistral 3 這樣的高品質開源模型不斷湧現,未來會有越來越多的企業能夠以更低的成本、更高的效率部署自己的 AI 應用。這不僅會促進技術的民主化,也會激發更多創新的商業模式。如果你也對這個領域充滿熱情,歡迎與我交流討論。