還記得那個只有 Nvidia 獨霸 AI 晶片市場的年代嗎?那個時代可能即將過去。Google 剛剛放出了一顆震撼彈——第七代張量處理單元 Ironwood,而且已經開始對外供應。更讓人驚訝的是,Anthropic 這家開發 Claude AI 的公司竟然一口氣訂了 100 萬顆。這不只是一筆訂單那麼簡單,而是整個 AI 基礎建設競爭格局正在重新洗牌的信號。

作為長期觀察科技產業的從業者,我必須說,這次 Google 是玩真的了。

Anthropic 與 Google Cloud 擴大合作:以超過一吉瓦的 TPU 算力驅動下一代 Claude 模型

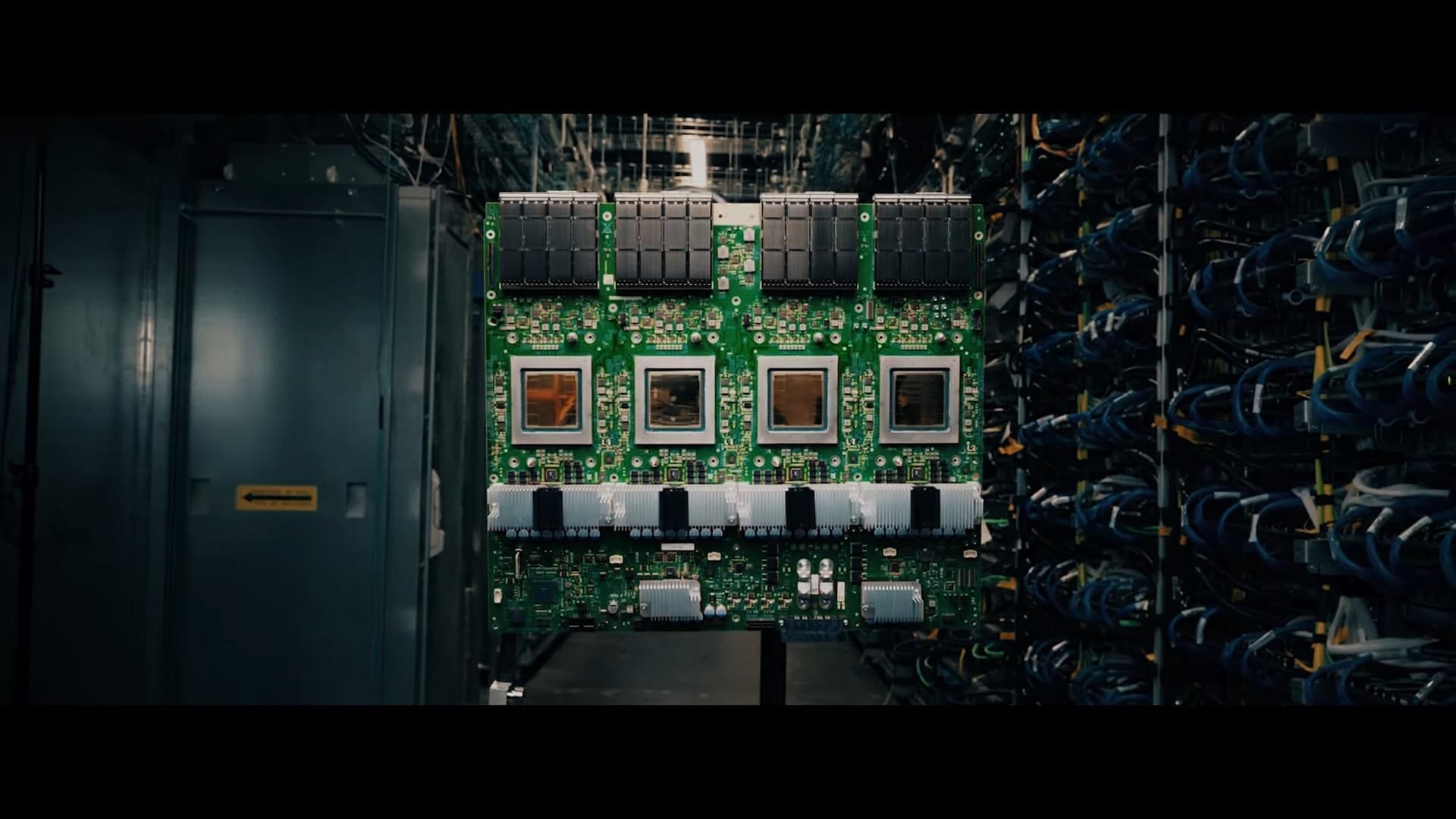

Ironwood 的硬實力:不只是數字遊戲

讓我直接說重點:Ironwood 的效能提升幅度大到有點誇張。相比前一代 TPU v6e(代號 Trillium),單晶片效能直接翻了 4 倍以上,而跟 TPU v5p 比起來,峰值效能更是暴增 10 倍。每顆 Ironwood 可以提供 4,614 TFLOPS 的 FP8 運算能力,搭配 192GB 的 HBM3E 記憶體——這個容量是 Trillium 的 6 倍。

但這些數字對實際應用意味著什麼?讓我用更直白的方式說明:當你在訓練大型語言模型時,記憶體容量就像你的工作桌面積,越大越能同時處理更多參數。而運算能力就像處理速度,決定了你多快能完成一個訓練週期。Ironwood 把這兩個關鍵指標都推到了新高度。

Ironwood 核心規格一覽

| 規格項目 | Ironwood (TPU v7) | Trillium (TPU v6e) | 提升幅度 |

|---|---|---|---|

| 單晶片運算效能 | 4,614 TFLOPS | ~1,100 TFLOPS | 4.2x |

| 記憶體容量 | 192 GB HBM3E | 32 GB | 6x |

| 記憶體頻寬 | 7.37 TB/s | - | - |

| 晶片互連速度 | 9.6 Tb/s | - | - |

| 單 Superpod 晶片數 | 9,216 顆 | - | - |

| Superpod 總算力 | 42.5 exaflops | - | - |

更讓人印象深刻的是 Ironwood 的液冷技術。在處理超大型 AI 模型訓練任務時,液冷方案能提供比傳統氣冷高出近 2 倍的持續效能。這不是噱頭,而是實實在在影響訓練時間和成本的關鍵因素。

從 AlphaGo 到 Ironwood:Google 的十年佈局

2016 年,當 AlphaGo 擊敗李世乭時,很多人才第一次聽說 TPU。那時候的 TPU 還只是 Google 內部使用的專用加速器。十年過去了,TPU 已經演進到第七代,從一個實驗性專案變成了能夠挑戰 GPU 霸主地位的商業產品。

這種演進不是偶然的。Google 從 2015 年就開始投資 TPU 技術,避開了所謂的「晶片稅」——也就是對外部供應商的依賴成本。根據分析師估計,Google 使用自家 TPU 的運營成本比依賴外部 GPU 的公司低約 20%。在 AI 運算這種動輒數億美元規模的投資中,20% 的成本差異足以改變整個遊戲規則。

Anthropic 的百萬晶片豪賭

當 Anthropic 宣布要使用多達 100 萬顆 TPU 時,我的第一反應是:這家公司是認真要打持久戰了。這批運算資源預計在 2026 年上線,總算力將超過 1GW(gigawatt)——這是什麼概念?大約等於一座中型發電廠的輸出功率。

Anthropic 的財務長 Krishna Rao 說得很清楚:「我們的客戶——從財富 500 強企業到 AI 原生新創公司——都仰賴 Claude 處理最重要的工作」。這不是空話。Claude 現在要同時服務企業級客戶和消費市場,而且還要保持在技術前沿,沒有強大的運算基礎設施根本玩不轉。

有趣的是,Anthropic 採取的是多雲策略。他們的 Claude 模型同時運行在 Google Cloud TPU、Amazon Trainium 晶片及 GPU 上。這種策略很聰明:不把雞蛋放在同一個籃子裡,同時根據不同的工作負載特性選擇最適合的硬體平台。

為什麼 TPU 有機會挑戰 GPU 霸主?

讓我們面對現實:目前 AI 產業確實高度依賴某家晶片大廠的 GPU。但這種局面正在改變,原因有三個:

1. 專用設計帶來的效率優勢

TPU 是專門為 AI 工作負載量身打造的 ASIC(應用特定積體電路)。它不需要像通用型 GPU 那樣兼顧遊戲、影片渲染等各種任務,可以全力優化機器學習運算。根據報告,在深度學習應用中,TPU 的處理速度比 GPU 快 15 到 30 倍,每瓦效能更是高出 30 到 80 倍。

2. 成本結構的根本差異

當你使用 Google Cloud 上的 TPU 時,你付的是服務費用,不是硬體採購成本。但更重要的是,Google 自己生產 TPU,沒有中間商賺差價。這種垂直整合的優勢在大規模部署時特別明顯。

3. 生態系統的逐步成熟

Google 的 Pathways 架構讓數千顆 TPU 能夠像單一系統一樣協同工作。當你把 9,216 顆 Ironwood 串聯成一個 Superpod 時,整個系統透過 9.6 Tb/s 的光纖互連網路緊密協作,徹底消除了資料瓶頸問題。這種規模化設計是 Google 多年來在資料中心基礎建設上的累積成果。

Ironwood 對比 Nvidia GPU 效能分析

| 比較項目 | Google Ironwood TPU | Nvidia Blackwell GB300 |

|---|---|---|

| 單晶片效能 | 4,614 TFLOPS | - |

| Pod 級總算力 | 42.5 exaflops(9,216 晶片) | 0.36 exaflops(NVL72 系統) |

| 記憶體頻寬 | 7.37 TB/s | 較低(依型號而異) |

| 能源效率 | 比前代高 2 倍,比 v1 高 30 倍 | 需要優化電源使用 |

| 成本優勢 | 運營成本低約 20% | 採購和運營成本較高 |

| 軟體生態系統 | 優化於 TensorFlow 和 Google AI 堆疊 | 最廣泛的 CUDA 生態系統支援 |

| 目標工作負載 | AI 推理和大型模型訓練(ASIC 專用設計) | 通用 AI 訓練和推理 |

| 冷卻技術 | 先進液冷 | 標準與液冷選項 |

技術亮點:SparseCore 與 Pathways

如果你關心技術細節,Ironwood 有兩個特別值得注意的創新。

第一個是增強版的 SparseCore——這是一種專門處理超大規模嵌入運算的加速器。在推薦系統和排序演算法中,嵌入層往往佔據了大量運算資源。SparseCore 能夠高效處理這類稀疏矩陣運算,這對於電商平台、社交媒體等需要即時推薦的應用特別重要。

第二個是 Pathways 架構。這是 Google DeepMind 開發的機器學習執行階段系統,讓多個 TPU 之間能夠實現高效的分散式運算。想像一下,如果你有 9,216 顆晶片,如何確保它們不會互相等待、造成資源閒置?Pathways 就是解決這個問題的關鍵,它像一個超級協調者,確保每顆晶片都在做最有價值的工作。

對企業決策者的啟示

如果你正在規劃公司的 AI 基礎設施策略,Ironwood 的推出應該讓你重新思考幾個問題:

供應商多元化的重要性:過度依賴單一硬體供應商是有風險的。Anthropic 的多雲策略值得參考——根據不同的工作負載特性,在 TPU、Trainium 和 GPU 之間靈活切換。

總持有成本的計算方式:不要只看硬體採購價格,要算運營成本、能源消耗、散熱需求等全生命週期成本。TPU 在這方面的優勢可能比表面上看起來更大。

工作負載的適配性:如果你的主要需求是訓練和部署大型語言模型,TPU 可能是更合適的選擇。但如果你需要支援各種不同類型的 AI 應用,GPU 的通用性仍然有優勢。

這場競爭對產業意味著什麼?

從更宏觀的角度來看,Ironwood 的推出標誌著 AI 基礎建設競賽進入了新階段。當 Google 的加速器效能已經能夠與最新一代的高階 GPU 相提並論時,市場的選擇將不再是「有沒有替代方案」,而是「哪個方案更適合我的需求」。

這種競爭對整個產業是好事。它會推動技術創新,降低運算成本,最終讓更多公司能夠負擔得起 AI 應用的開發和部署。Google 的 Gemini、Veo、Imagen,以及 Anthropic 的 Claude,都已經在 TPU 上進行訓練和服務。這些成功案例會鼓勵更多公司嘗試 TPU 這個選項。

不過,我們也要保持理性。GPU 在 AI 開發工具生態系統的優勢不是一朝一夕就能超越的。CUDA 多年來累積的開發者社群、工具鏈、優化經驗,這些軟實力仍然是 TPU 需要努力趕上的地方。

我的觀察與建議

作為一個持續關注 AI 產業發展的從業者,我認為 Ironwood 的推出是一個重要的里程碑,但它不會一夜之間改變整個產業格局。真正的改變會是漸進式的、多面向的。

對於正在評估 AI 基礎設施的企業,我的建議是:

- 不要盲目跟風:Anthropic 訂購 100 萬顆 TPU 是因為它符合他們的特定需求和規模,不代表每家公司都應該這樣做。

- 從小規模試驗開始:可以先在 Google Cloud 上租用一些 TPU 資源,實際測試你的工作負載在 TPU 上的表現,再做長期決策。

- 關注總體成本:除了硬體成本,還要考慮團隊的學習曲線、工具鏈的成熟度、技術支援的可得性等因素。

- 保持技術中立:最好的策略往往是混合策略——根據不同的應用場景,選擇最適合的硬體平台,而不是把所有寶都押在一種技術上。

未來展望

AI 運算的未來肯定不會是一家獨大。我們會看到更多專用加速器的出現,每種都在特定領域有其優勢。Google 的 TPU、Amazon 的 Trainium、以及其他正在研發中的 AI 晶片,都會在這個生態系統中找到自己的位置。

對於像我們這樣的 AI轉型顧問來說,這意味著我們需要持續學習,了解不同硬體平台的特性,才能為客戶提供最適合的建議。AI 基礎建設的選擇不只是技術問題,更是商業策略問題。選對了平台,可以為企業節省大量成本,加快產品上市時間;選錯了,可能會陷入技術債務的泥沼。

Ironwood 的故事還在繼續寫。接下來幾個月,當更多公司開始使用這款晶片,我們會看到更多真實世界的效能數據和應用案例。那時候,我們才能更準確地評估 TPU 在 AI 基礎建設競賽中的真實位置。

準備好擁抱 AI 驅動的未來了嗎?

無論你是想要優化現有的 AI 工作流程,還是從零開始建立 AI 能力,我們都能提供從策略規劃到技術實施的全方位支援。立即預約諮詢,讓我們一起探討如何讓 AI 成為你企業成長的加速器。

參考資料與延伸閱讀

本文參考了以下權威來源的研究與分析:

- Ironwood TPUs and new Axion-based VMs for your AI workloads | Google Cloud Blog

- Stanford University - AI Index Report: 提供全球 AI 發展趨勢的年度綜合分析

- MIT Technology Review - AI Hardware: 深入報導 AI 硬體技術的最新發展

- McKinsey & Company - AI Infrastructure Analysis: 從商業角度分析 AI 基礎設施投資策略

- BCG - AI Business Strategy: 提供 AI 商業策略的專業洞察

關於作者

作為一位深耕科技產業超過十年的分析師,我專注於 AI 技術發展與商業應用的交會點。從早期的雲端運算革命,到現在的 AI 基礎建設競賽,我始終相信:真正改變產業的不是技術本身,而是如何將技術轉化為可衡量的商業價值。

在 Tenten,我們團隊服務過的客戶從新創公司到上市企業都有,幫助他們評估 AI 技術選項、規劃實施策略、並確保投資能夠產生實質回報。我相信 AI 的未來不是取代人類,而是增強人類的能力——這也是我們在每個專案中努力實現的目標。

當我不在分析 AI 晶片效能數據時,你可能會發現我在研究最新的開源 AI 模型,或是與客戶討論如何用 AI 解決他們最頭痛的業務挑戰。如果你對 AI 基礎建設、數位轉型或技術策略有任何想法,歡迎隨時與我交流。