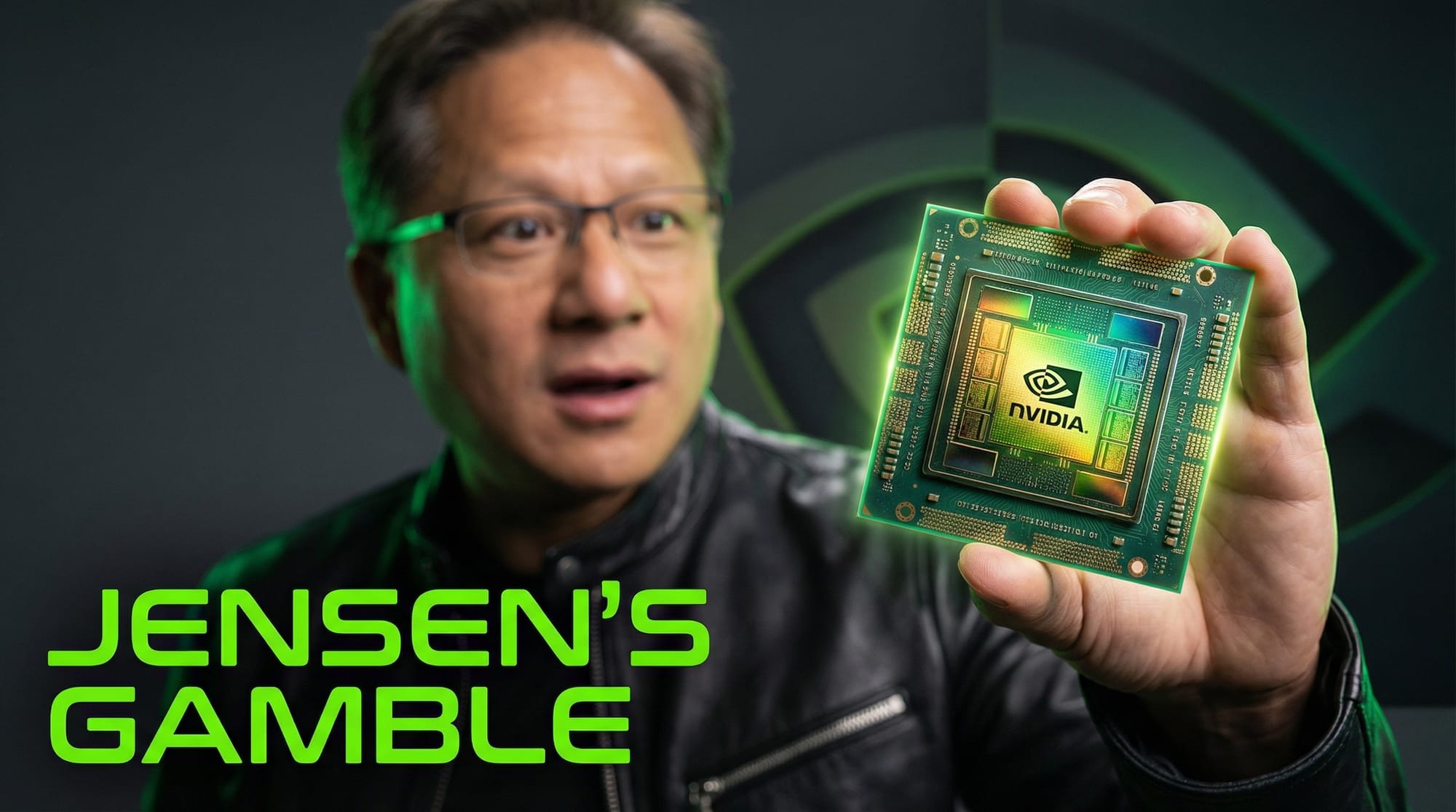

Nvidia 於 2024 年 12 月 24 日宣布以 200 億美元現金收購 AI 推論晶片新創 Groq,這筆交易金額是 Groq 三個月前 69 億美元估值的三倍。這筆交易的結構值得關注:Nvidia 並非傳統收購 Groq 公司本身,而是透過「非獨家授權協議」取得 Groq 的推論技術,同時延攬創辦人 Jonathan Ross 與總裁 Sunny Madra 等核心團隊。Groq 將在新任執行長 Simon Edwards 領導下繼續獨立營運。

這筆交易的戰略意義遠超過數字本身。要理解 Nvidia 為何願意支付如此高額溢價,必須先釐清當前 AI 產業正在發生的結構性轉變。

AI 運算重心的轉移:從訓練到推論

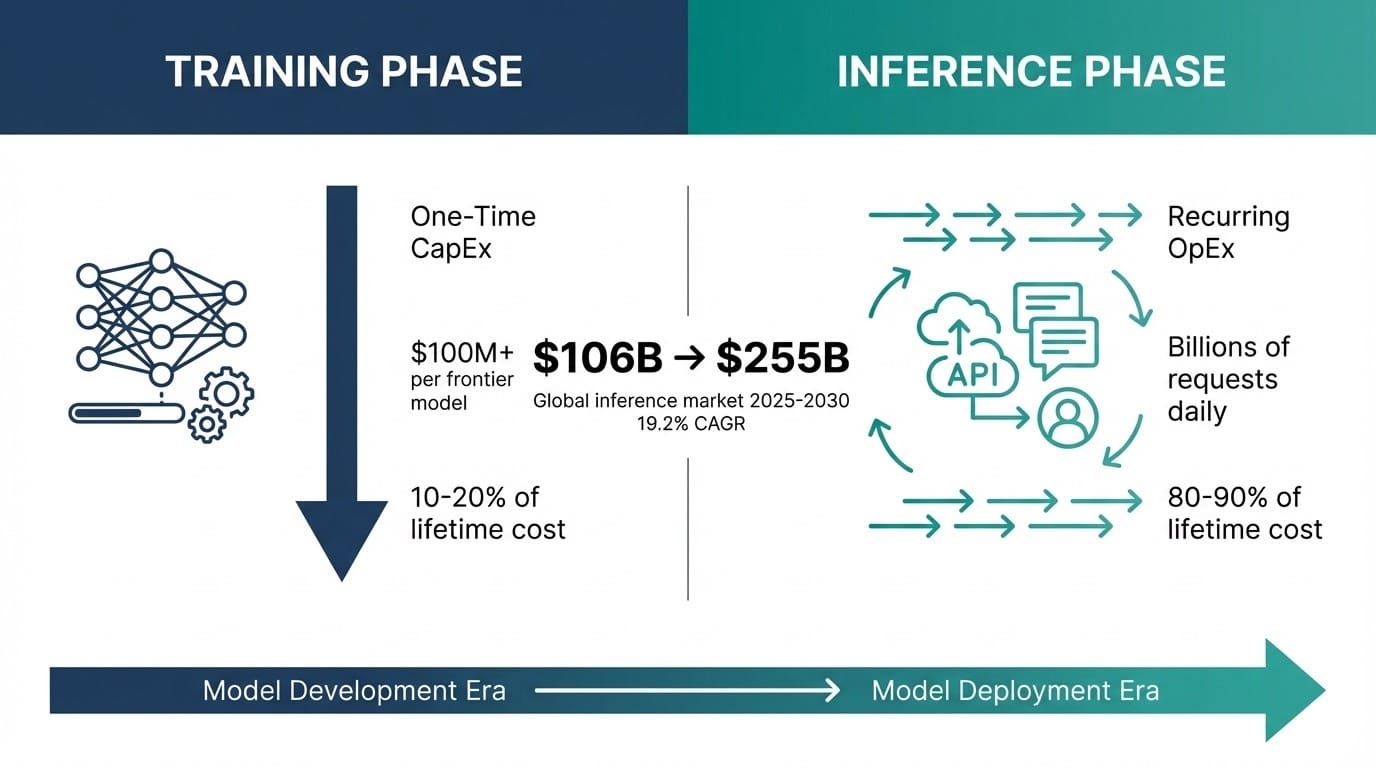

AI 產業正經歷從「訓練導向」到「推論導向」的根本性轉變。訓練階段是一次性的資本支出,用於建構和優化大型語言模型。推論階段則是模型實際運作、回應使用者請求的階段,屬於持續性的營運支出,且隨使用量增長。

根據 MarketsandMarkets 的研究報告,全球 AI 推論市場預計從 2025 年的 1,061 億美元成長至 2030 年的 2,550 億美元,年複合成長率達 19.2%。產業分析師估計,推論成本佔 AI 應用生命週期總成本的 80% 至 90%。McKinsey 近期分析指出,訓練成本屬於一次性資本支出,難以直接連結商業回報;推論成本則是經常性支出,與營收生成直接掛鉤。

| 比較面向 | 訓練階段 | 推論階段 |

|---|---|---|

| 成本類型 | 一次性資本支出 | 持續性營運支出 |

| 運算特性 | 高度平行化 | 即時、低延遲 |

| 成長動能 | 新模型開發 | 使用量成長 |

| 成本佔比 | 10-20% | 80-90% |

這意味著真正的商業價值正在從「建構模型」轉向「運行模型」。Nvidia 的 GPU 在訓練市場佔據超過 80% 的市場份額,但推論市場的競爭格局更為複雜,專用架構可能具備顯著優勢。

Jonathan Ross 與 LPU 架構的技術突破

Jonathan Ross 是 Google 張量處理器(TPU)的共同發明人。他在 Google 的工作證明了「GPU 或無」的敘事並不成立,當超大型雲端供應商成功開發客製化矽晶片時,每個精明的買家都會開始計算「是否應該自行開發」。這直接削弱了 Nvidia 的潛在市場規模。

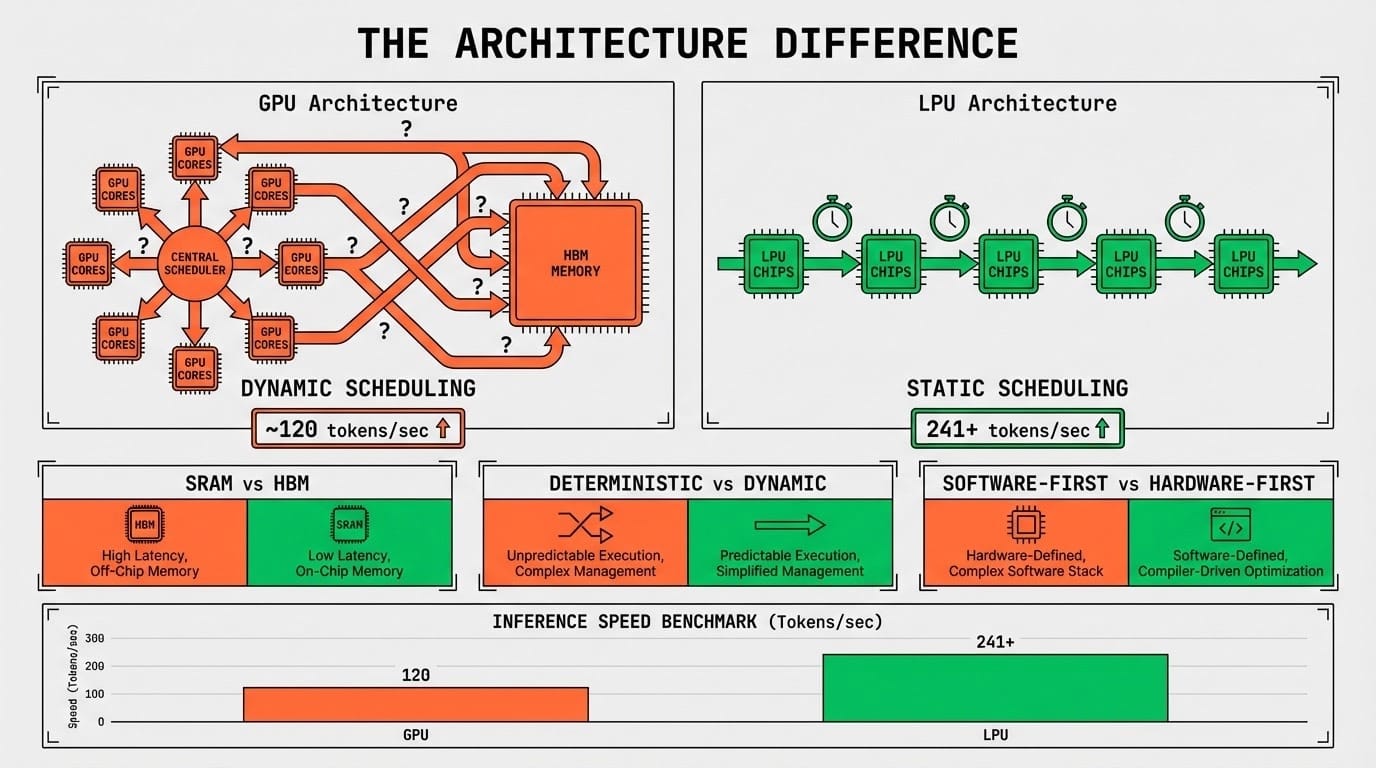

Ross 於 2016 年創立 Groq,開發了語言處理單元(LPU)架構,專門針對推論工作負載進行優化。GPU 是為訓練階段的高度平行化運算設計的通用處理器,在推論階段實際上是過度設計。LPU 架構的核心創新包括:

- 確定性執行:採用軟體優先設計原則,編譯器在晶片設計之前就已完成架構規劃。所有執行路徑在編譯階段預先計算,消除了動態排程帶來的不可預測延遲。

- SRAM 為主的記憶體架構:每顆晶片整合數百 MB 的 SRAM 作為主要權重儲存空間,而非快取。這種設計大幅降低存取延遲,使運算單元能以最高速度提取模型權重。

- 可程式化流水線:資料如同輸送帶般在晶片間流動,無需複雜的路由器或控制器。多顆 LPU 可無縫串連,實現線性擴展。

根據 ArtificialAnalysis.ai 的基準測試,Groq LPU 在運行 Meta 的 Llama 2-70b 模型時達到每秒 241 個 token 的吞吐量,是競爭方案的兩倍以上。在處理 Mixtral 8x7b 模型時,速度可達每秒 420 個 token。

交易結構的戰略考量

Bank of America 分析師 Vivek Arya 指出,這筆交易「暗示 Nvidia 認知到,雖然 GPU 主導了 AI 訓練,但推論的快速轉變可能需要更專用的晶片」。他將 Nvidia 的 GPU 描述為通用平台,而 Groq 的 LPU 則是針對快速、高度可預測 AI 推論優化的專用晶片。

交易採用非獨家授權而非傳統收購的結構,有幾個可能的考量:

反壟斷風險管理:Nvidia 的市值達 4.6 兆美元,現金餘額 610 億美元。Bernstein 分析師 Stacy Rasgon 評論,這種結構「可能維持競爭存在的表象」。傳統收購幾乎肯定會面臨多國監管機構的嚴格審查,2020 年 Nvidia 試圖以 400 億美元收購 Arm 的交易就因監管壓力而告吹。

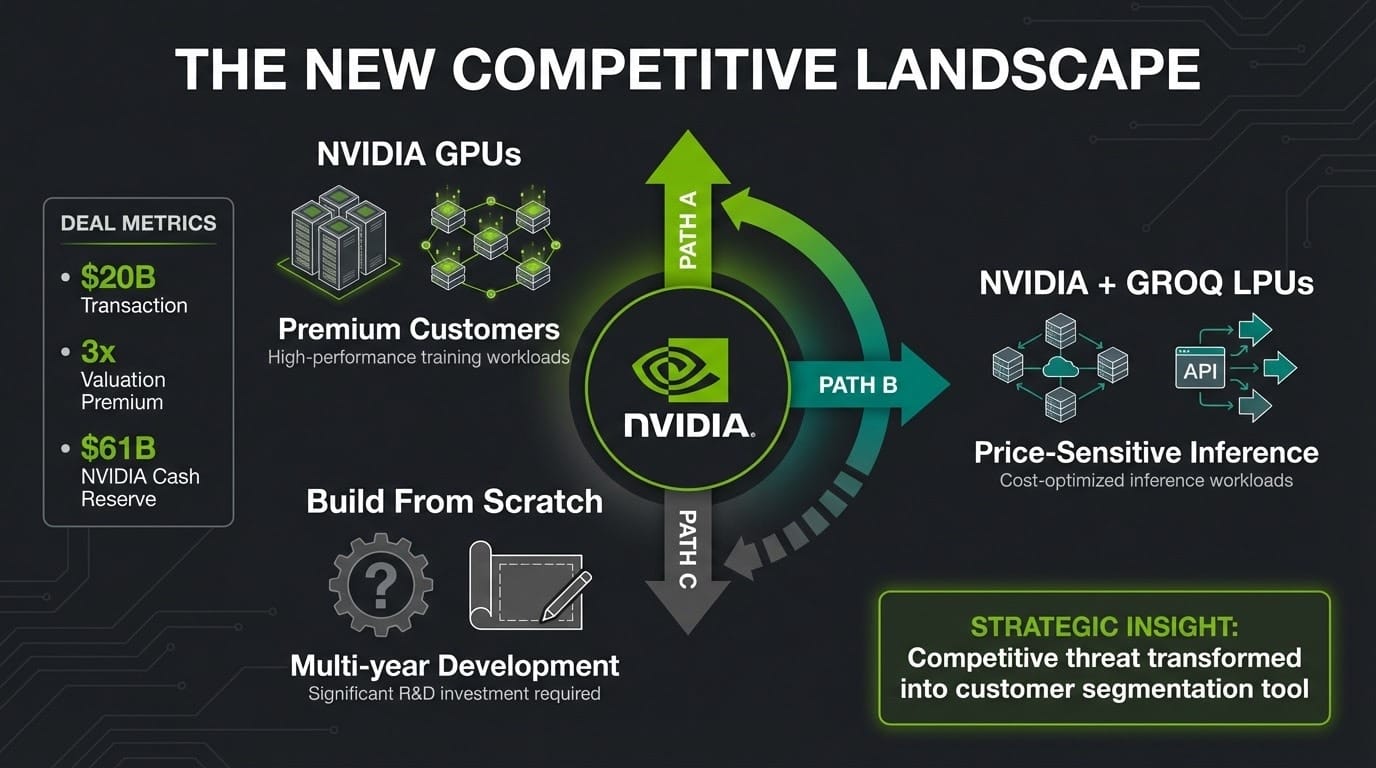

雙重佈局策略:交易完成後,任何評估「自建、採購或替代供應商」的 AI 實驗室都將面對以下選項:Nvidia GPU(選項 A)、Nvidia-Groq LPU(選項 B)、或從零開始(選項 C)。這將競爭威脅轉化為客戶區隔工具,實現差異化定價:高端客戶支付 GPU 溢價,對價格敏感的推論需求則導向 LPU。

Baird 分析師 Tristan Gerra 認為,儘管 Nvidia 的 GPU 到 2030 年仍將佔據 AI 處理器市場多數份額,但客製化 ASIC 長期可能擴大 Nvidia 的整體市場規模。Bank of America 更進一步類比,這筆交易的長期戰略意義可能類似於 2020 年 Nvidia 收購 Mellanox 的交易,後者現已成為 Nvidia 網路與 AI 擴展護城河的基礎。

對競爭生態系統的影響

這筆交易對 AI 晶片新創生態系統造成深遠影響。Cerebras Systems、SambaNova 等替代架構開發商原本的主要退出路徑是被大型科技公司收購。Nvidia 的先發制人行動不僅移除了市場上最具威脅性的競爭者,還可能使其他新創公司的估值過高,讓除了最大型科技巨頭之外的任何買家都難以承受。

超大型雲端供應商(Google、Amazon、Microsoft)近年來積極投資自研晶片,部分原因正是降低對 Nvidia 的依賴。Amazon 的 Trainium 和 Inferentia 晶片、Google 的 TPU、Microsoft 的 Maia 都代表了這種趨勢。然而,這些自研方案主要服務內部需求,難以形成開放的替代生態系統。

Groq 原本有潛力成為第三方推論基礎設施的核心供應商,使雲端供應商能夠白牌其架構。這筆交易有效阻止了這種可能性。

整合路徑的關鍵指標

Nvidia 執行長黃仁勳在聲明中表示:「我們計劃將 Groq 的低延遲處理器整合至 Nvidia AI 工廠架構,擴展平台以服務更廣泛的 AI 推論與即時工作負載。」這段話暗示了實際技術整合的意圖。

Bank of America 的 Arya 預期未來 Nvidia 系統中 GPU 與 LPU 將在同一機架內共存,透過 NVLink 連接。這種架構將實現「訓練用 GPU、推論用 LPU」的組合方案,讓 Nvidia 在兩個市場都能保持領先地位。

觀察這筆交易是純粹的防禦性佈局還是具備進攻性整合意圖,可關注以下指標:

| 觀察指標 | 防禦性信號 | 進攻性信號 |

|---|---|---|

| 產品整合 | 維持獨立產品線 | GPU+LPU 組合方案 |

| 技術路線圖 | LPU 技術凍結 | 下一代 LPU 開發 |

| 客戶策略 | 僅針對特定客戶 | 全面推廣 |

| 定價模式 | 高溢價 | 競爭性定價 |

收購 Groq:Nvidia 的戰略核武與推論市場的未來

讓我們來算一算。Nvidia 支付了 Groq 9 月估值的三倍來完成這筆收購。

這不是普通的併購,這是戰略上的「核武級」行動。過去,每一家 AI 實驗室都極度依賴 GPU,這產生了巨大的集中化風險。直到 Google 透過內部使用的 TPU 突圍,證明了「非 Nvidia 即無物」的敘事是錯誤的。

這不僅僅是技術可行性的展示,它揭露了 Nvidia 的護城河可能比市場想像的要淺。當一個超大規模雲端服務商成功打造出客製化晶片時,每個精明的買家都會開始計算:「我們是否應該建立自己的晶片?」這直接削減了 Nvidia 的潛在市場規模 (TAM)。

數字背後的邏輯

Jonathan Ross(Groq 的創辦人)是 TPU 的發明者。他深諳讓非 GPU 的 AI 加速器成形的架構原則。他的 LPU (Language Processing Unit) 架構精準鎖定了推論(Inference)工作負載,而這正是 GPU 效能過剩(Over-engineered)的地方。

這之所以重要,是因為從長期來看,推論才是真正的獲利所在。訓練(Training)是單次的大額資本支出 (Capex),但推論是隨著使用量擴張的持續性營運支出 (Opex)。

| 項目 | Nvidia (GPU) | Groq (LPU) | 影響 |

| 技術架構 | 通用型並行計算 | 專為推論優化的 | 效率與成本的權衡 |

| 主要用途 | 模型訓練 ( | 模型推論 (Inference) | 改變 AI 生態的獲利模式 |

| 核心優勢 | 低延遲、高吞吐量 | ||

| 市場定位 | 標準化、高溢價 | 專業化、高效能 |

如果 Groq 證明了 LPU 在推論上能達到極具競爭力的性價比,每個 雲端 (Cloud) 供應商都會想貼牌(white-label)他們的架構。屆時 Nvidia 將被擠壓到「僅限訓練」的角落,同時失去推論市場帶來的年金流。

雙重封鎖:從競爭威脅到客戶分層

可以說,這筆交易是 Nvidia 為了防止 Groq 催生出一個完整的「非 Nvidia」生態系統而買的保險。但更有趣的是其二階效應:客戶鎖定(Customer lock-ins)。

現在,Nvidia 同時擁有工業標準(CUDA + GPU)和最具公信力的替代架構(LPUs)。這簡直是微軟收購 GitHub 等級的戰略手筆。任何正在評估「自建 vs. 購買 vs. 替代方案」的 AI 實驗室,現在面臨的是:

- 選項 A:Nvidia GPUs

- 選項 B:Nvidia <> Groq LPUs

- 選項 C:從零開始自建

透過將競爭威脅轉化為客戶分層工具,Jensen Huang 是真正的交易大師。他們現在可以進行價格歧視:頂級客戶支付高價購買 GPU,對價格敏感的推論需求則被導向 LPUs,而 Nvidia 則雙龍取水,兩頭獲利。

結語

這筆 200 億美元的交易反映了 AI 產業一個更深層的真理:在科技領域,最昂貴的代價往往不是建構未來,而是阻止別人在沒有你的情況下建構未來。Nvidia 選擇支付這筆看似高昂的費用,正是因為讓 Groq 的 LPU 技術落入競爭對手手中的潛在成本更高。

對於企業決策者而言,這筆交易確認了幾個關鍵趨勢:推論成本將成為 AI 應用經濟學的核心變數;專用架構在特定工作負載上的效率優勢真實存在;AI 基礎設施的競爭將從單純的硬體規格轉向整合解決方案。隨著 AI 從實驗階段進入大規模部署,選擇正確的基礎設施合作夥伴將成為企業競爭力的關鍵因素。

參考資料來源

- CNBC: Nvidia buying AI chip startup Groq's assets for about $20 billion

- MarketsandMarkets: AI Inference Market Report

- McKinsey: The next big shifts in AI workloads and hyperscaler strategies

- Nvidia 官方網站投資者關係 - Nvidia Investor Relations | Nvidia

- Groq 官方網站 - Groq Official Website | Groq

- Groq 的 LPU 技術解析 - Understanding Groq’s LPU Technology | IEEE Spectrum

- 矽谷晶片戰爭 - The Silicon Valley Chip War | The New York Times

作者資訊

Tenten Research Team

Tenten 是專注於 AI 與數位轉型的策略顧問機構。我們的研究團隊持續追蹤全球科技產業的重大發展,為企業決策者提供具備深度與實用價值的產業分析。本文作者群具備半導體產業、企業策略與科技投資背景,致力於將複雜的技術發展轉化為可操作的商業洞見。

作者觀點:這筆交易的結構設計展現了 Jensen Huang 團隊的策略深度。透過非獨家授權而非直接收購,Nvidia 既取得了關鍵技術與人才,又保持了監管靈活性。更重要的是,這種安排讓 Nvidia 能夠同時測試 LPU 技術的整合可行性,又無需承擔完全收購帶來的整合風險。這是大型科技併購的新典範,值得其他產業參考。

若您正在評估 AI 基礎設施策略,或希望了解 AI 晶片市場演變對您企業的影響,歡迎與 Tenten 團隊預約諮詢,我們將協助您制定符合長期發展需求的技術佈局方案。